안녕하세요, 오늘은 기존의 제안서 작성을 위한 방향성을 instance-level 6D pose estimation이 아닌 category-level 6D pose estimation으로 가게 되어 이번 논문을 리뷰하게 되었습니다.

(최근에 이승현 연구원님께서 작성한 걸 리뷰를 다 쓰고 나서 확인했네요?)

instance-level은 타겟이 되는 물체에 대한 3D 모델과 일대일 대응이어야 합니다.

즉, cat이라는 클래스에 대한 물체를 타겟으로 한다고 가정하면, 해당 물체에 대응되는 정확한 3D 모델이 있어야 학습/ 평가가 가능합니다.

하지만, category-level 같은 경우 cat이라는 카테고리 안에 여러 인스턴스에 대한 예측을 수행합니다. 즉, 여러 인스턴스라고 하면 학습 때는 다루지 않은 물체들을 다루게 될 것입니다. 주로, NOCS과 같이 다양한 3D 모델들을 학습한 후 특정 카테고리에 대한 인스턴스를 예측하도록 합니다.

category-level을 좀 더 찾아보니 2가지로 나누어집니다. inference할 때 3D 모델을 입력에 대한 여부인데요. 3D 모델을 input으로 줄 경우 추가적인 reference로 사용하게 되므로 성능이 좀 더 향상되는 것을 해당 논문을 통해 확인할 수 있습니다. 이번 논문 같은 경우, 3D 모델을 사용하지 않고 reconstruction 모델에 대한 depth map을 렌더링하여 사용하게 됩니다.

리뷰 시작하겠습니다.

Introduction

오늘날 로봇은 manufacturing, human-robot collaboration 등과 같이 다양한 분야에서 활용되고 있습니다. 이러한 어플리케이션 측면에서 로봇의 주요 임무는 물체에 대한 인지, 조작이 되겠죠. 로봇은 4차 산업혁명의 개념에 따라 이러한 작업을 효율적으로 수행하기 위해 환경과 상호 작용하면서 변화하는 환경에 적응하는 능력을 보여주어야 합니다. 이때, 핵심 요소는 다양한 물체를 파악하는 능력입니다. 임의의 물체를 자율적이며 안정적으로 파악하기 위해서는 물체를 탐지해야 하며, 또한 pose를 추정하는 것이 중요합니다. 하지만, 물체는 크기, 재질에 대한 특성, 질감 등이 다양할 수 있으며 조명 조건이 다른 복잡한 장면에 대해서는 물체가 가려질 수 있기 때문에 어려운 과정이라고 볼 수 있습니다. 또한, 산업 현장에 직접 투입되기 위해서 필수적인 요소 중 하나는 실시간성을 요구하기 마련입니다. 이처럼 많은 연구가 이루어졌음에도 불구하고 여전히 어려운 문제들로 남아있습니다.

이번 i2c-net의 contribution은 다음과 같습니다

- instance-level pose estimation 모델을 활용하여 6D pose를 추정하고 3D reconstruction 모듈을 통해 category-level에 대한 물체의 pose를 추정하는 i2c-net 제안

- 학습을 위해 사용되는 커스텀으로 제작한 Photo-realistic 데이터셋을 활용

- YCB-V 및 REAL275에서 다양한 실험을 진행하였으며 특히 REAL275에서 우수한 성능을 보임을 증명

Methodology

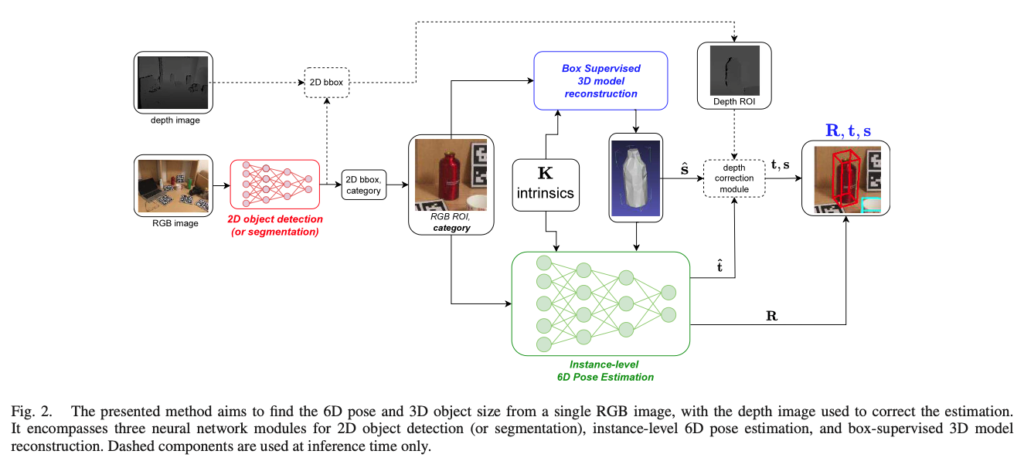

그림(2)와 같이 제안하는 ic2-net은 instance-level의 네트워크로부터 시작하는 6D category-level으로의 pose 추정을 위한 프레임워크를 나타냅니다. 해당 프레임워크의 목표는 성능은 좋지만 일반화하는 부분에 대해서는 약한 모습을 보이는 instance-level의 모델이 category-level에서도 효과가 있음을 입증하는 것이라고 하네요. instance-level에서 일반적으로 사용되는 아키텍처는 detection과 같은 범용적인 기능을 수행할 수 있는 backbone을 포함하고 있습니다. 이처럼 동일한 카테고리의 다양한 인스턴스에 대해 동일한 결과를 얻음으로써, 잠재적인 특징을 추출할 수 있다고 합니다. 즉, 유사한 것들끼리 묶어서 공통된 결과를 얻을 수 있다면 해당 카테고리에 대한 중요한 특징이나 패턴을 파악할 수 있다는 의미로 보이네요. 이를 통해 다른 신경망을 통과하면서 고려해야 하는 대상에 대해 기하학적 정보 및 형태 정보를 같이 얻을 수 있습니다.

아키텍처의 경우, 모듈식으로 설계가 되어 있어서 관련 연구에 대한 성과/결과가 좋은 경우에 따라 구성 요소를 바꿀 수 있도록 설계를 했다고 합니다. 특히나, 파이프라인은 RGB 이미지를 입력으로 받아서 타겟이 되는 물체에 대해 2D bbox를 출력하도록 2D object detection 모듈에서 시작합니다. 그 다음, 3D model reconstruction모듈에서는 앞서 얻은 2D bbox를 기반으로 crop 된 영상을 활용하여 3D mesh를 생성합니다. 마지막으로, instance-level 6D pose estimation 모듈에서는 crop 영상과 3D mesh를 조합하여 rotation과, traslation 벡터를 얻습니다. 마지막 후처리 과정인 depth-correction 모듈에서는 crop된 depth 이미지를 통해 앞서 구한 rotation과 translation을 개선하여 최종 translation \mathbf t와 scale \mathbf s를 얻습니다.

학습할 때는 2D detection 모듈 같은 경우 YOLOv5를 사용하지만, scene이 복잡한 경우 instance-level 6D pose estimation의 결과가 저하될 수 있으므로 inference할 때는 Detectron과 같은 instance segmentation을 사용한다고 합니다. 해당 방법은 occlusion 된 물체를 마스킹 처리 해주므로 단일 뷰에서의 모호함을 제거할 수 있고 관심 물체에 대해 좀 더 집중할 수 있겠네요.

Photo-Realistic Dataset

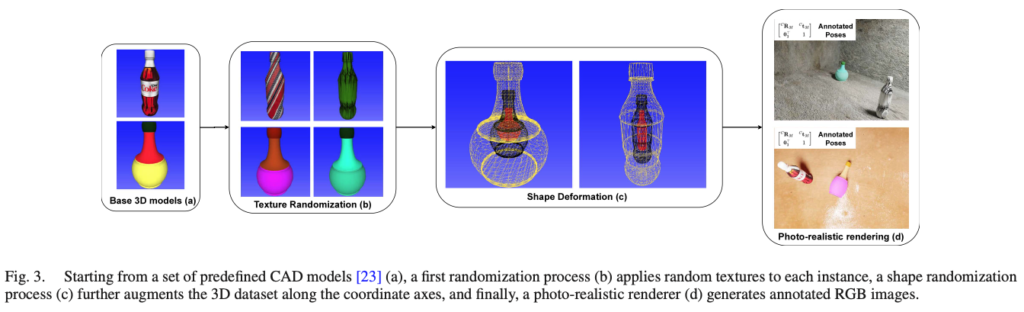

i2c-net을 학습하기 위해 커스텀으로 만든 데이터셋입니다. BlenderProc을 사용하여 물체에 대한 6D pose annotation을 제공할 수 있었으며, 해당 시뮬레이터는 실제 RGB 이미지를 통한 렌더링이 가능한 Blender 기반의 그래픽 엔진 기반의 툴입니다. 데이터셋의 구성은 다양한 카메라의 시점과, 조명 및 배경에 대해 총 9900장이 제공됩니다. 동일한 카테고리 내에서 3D model을 사용할 수 없는 물체의 경우에 대한 네트워크를 일반화하는 것을 목적으로 합니다. 학습으로 사용되는 데이터로 카메라는 15개의 기본 모델(3D 모델)을, 노트북에는 300개의 기본 모델을, 조작 작업과 더 관련이 있는 다른 NOCS의 카테고리(병, 그릇, 캔, 머그컵)에는 100개의 기본 모델을 사용합니다. 이처럼 ShapeNet에서 제공하는 기본 모델을 수집하기 위해 사용하여 데이터셋을 보강하였다고 합니다.

deformation은 필요에 따라 파라미터를 조절하여 bbox에 적용됩니다. 이때 범위는 주어진 범위 내에서 하는 걸 권장하는데요. 큰 범위는 동일한 카테고리에 대한 일반화를 추진하는 데 유용할 수 있지만, 너무 넓은 범위는 카테고리에 대한 shape의 주요 특성을 잃을 수 있으므로 과도하게 설정하지 않는 것이 좋다고 하네요. 다른 category-aware 연구들과 비교했을 때, 제안된 방법은 학습 중에 변형된 3D 모델에 적용된 컬러 텍스처 집합을 통해 합성 RGB 이미지만 사용하여 일반화를 높이고 특정 표면 패턴에 대한 과적합을 줄인다는 점이 가장 큰 혁신이라고 합니다. 이러한 방식으로 신경망 모델은 클래스 내에서 가변성이 발생함에도 불구하고 shape에 더 집중하여 물체의 shape을 reconstruction할 수 있습니다. 따라서, 물체의 카테고리별로 작업을 해야 하는 산업 환경에서는 이러한 다양성에 따라 기본 모델의 수를 줄일 수 있으며, 새로 유입되는 제품에도 대응할 수 있습니다.

그림(3)은 3D 모델에 무작위로 선택된 일부 색상 및 텍스처 속성을 부여할 수 있는 augmentation 파이프라인을 나타내고 있습니다. 이렇게 변형된 mesh는 모델의 무작위 스케일링을 담당하는 BlenderProc에 전달됩니다. 또한 그림(3)의 (c)를 보면 좌표축을 따라 모양 변형의 정도를 정성적으로 보여줍니다. 노란색과 빨간색 와이어프레임은 검은색으로 표시된 기본 모델과 비교하여 주어진 카테고리에서 가능한 최대 및 최소 변형의 윤곽을 보여줍니다. 또한 BlenderProc는 다양한 배경과 조명 조건이 시뮬레이션 되는 photo-realistic한 환경에 물체를 배치합니다. 마지막으로 각 카메라 뷰에 대해 각 물체의 6D pose를 계산합니다. 이 방법의 강점은 모든 데이터 생성 프로세스를 사용자가 완전히 제어할 수 있는 점입니다.

RGB 6D Pose Estimation

해당 모듈은 instance-level 네트워크를 활용하여 RGB 이미지, 관련 3D 모델, \mathbf K(intrinsic parameter)에서 물체에 대한 6D pose를 추출합니다.

instance-level을 다루는 모델은 다양하기 때문에 특정한 모델을 선택하기 위해 정확도, 속도, 유연성 간의 절충을 통해 선택되었다고 합니다. 이번 논문에서는 GDR-Net(Geometry-Guided Direct Regression Network)를 베이스라인으로 잡았습니다. 해당 모델의 아키텍처는 backbone으로 ResNet과 커스텀 decoder를 포함하는 encoder-decoder를 기반으로 하여 보이는 물체에 대한 feature space의 geometry 표현을 내부적으로 reconstruction합니다. 해당 기능은 category-level 시나리오로 확장하기에 적절하다고 판단을 하였으며, instance-aware에서의 세팅과 같이 네트워크가 다양한 카테고리의 몇 가지 인스턴스에 관한 세부 사항에 집중하는 대신 주어진 클래스에 공통된 3D geometry를 학습하도록 하는 아이디어입니다. 또한, encoder-decoder의 end-to-end 학습과 RGB 입력에서 추출된 특징이 주어졌을 때 3D 모델의 6D pose를 찾는 일을 담당하는 PnP(Perspective-n-Point)가 가능하도록 설계되었습니다. 그럼에도 불구하고, 단일 이미지에서 물체의 좌표축을 따라 상대적인 scale, 특히나 절대 scale을 구하는 것은 여전히 instance-level 네트워크의 가능성을 넘어선다고 하네요. 이를 위해 3D reconstruction 모듈은 category-aware 추정을 성공적으로 수행하기 위해 필수적인 과정이라고 볼 수 있습니다.

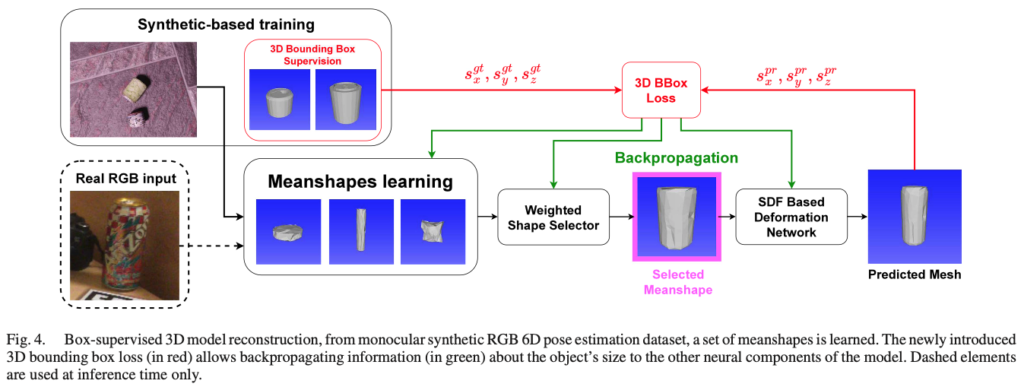

3D Model Reconstruction

i2c-net은 고려 대상 카테고리에 대해 동일한 photo-realistic RGB 이미지를 통해 학습되고, 단일 뷰포인트가 주어졌을 때 unseen instance의 3D mesh를 예측하도록 하는 방법을 학습합니다. 해당 과정은 위 그림(4)와 같이 Multi-Category Mesh Reconstuction(MCMR)을 기반으로 box-supervised 3D model reconstructor를 만들었습니다. 이를 이요아여 3D 모델의 적절한 shape과 scale을 찾기 위해 학습 과정에서 습득하고 3D 모델에 저장된 사전 지식, 즉 meanshapes을 활용하는 것이 유용합니다. meanshape은 학습 과정에 seen 물체의 구조에 대한 뚜렷한 정보를 압축한 latent feature라고 볼 수 있습니다. 여러 개의 meanshape을 학습하고 classifier가 이미지의 feature와 관련하여 가장 적합한 meanshape을 선택하도록 설계를 하였으며, 이러한 접근법은 3D bbox supervision을 통해 다음과 같은 term을 적용하여 loss function으로 사용 되게 됩니다.

\mathcal L_{3Dbbox}=(s_{x}^{pr}-s_{x}^{gt})^{2}+(s_{y}^{pr}-s_{y}^{gt})^{2}+(s_{z}^{pr}-s_{z}^{gt})^{2}해당 loss function은 [1]을 기반으로 합니다. 이때, meanshapes 중 적절한 shape를 고르는 selector를 통해 선택된 meanshape는 SDF(Signed Distance Function) 기반[2]의 네트워크의 역전파가 수행되게 됩니다. 이때, s_{k}는 물체의 예측(pr) 및 GT(gt) 3D bbox의 길이를 의미합니다. 예측 mesh와 GT mesh를 비교하기 위해서는 이러한 3D 모델을 위치 측면에서 align을 맞춰주는 것이 편하겠네요. 따라서, 모든 학습 과정에서 예측된 mesh의 bbox의 중심이 [0,0,0]이 되도록 NOCS 데이터셋에서 적용된 것과 동일하게 옮겨주었다고 합니다. 원칙적으로 실제 절대 스케일 \mathbf s는 알 수 없지만, 3D box supervision 덕분에 그림(3)과 같이 데이터셋 생성 과정에서 고려되는 차원 범위까지 근사치 \mathbf {\hat s}는 구할 수 있게 되었다고 합니다.

[1] A. Simoni, S. Pini, R. Vezzani, and R. Cucchiara, “Multi-category mesh reconstruction from image collections,” in Proc. IEEE Int. Conf. 3D Vis., 2021, pp. 1321–1330.

[2] J. J. Park, P. Florence, J. Straub, R. Newcombe, and S. Lovegrove, “DeepSDF: Learning continuous signed distance functions for shape representation,” in Proc. IEEE Conf. Comput. Vis. Pattern Recognit., 2019, pp. 165–174.

Depth Correction Module

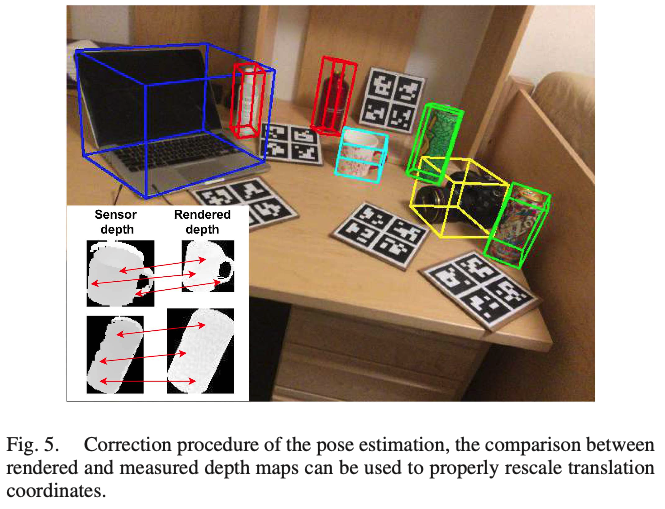

그림(2)에 대해 설명한 것처럼 inference할 때는 3D 모델을 사용할 수 없습니다. 따라서, instance-level 6D pose estimation 네트워크는 이전 섹션에서 언급한 3D reconstruction 모듈을 통해 만들어 내야 하며, 이는 정확한 3D 모델의 상대적인 scale을 고려할 때 적절한 3차원 rotation에 대한 regression을 하기에는 충분합니다. 하지만, 절대 scale로 인한 pose 추정 오류를 보완하기 위해 3차원 translation 변환에 대한 추가적인 과정을 수행하고자 합니다. 이를 위해 instance-level의 출력으로 나온 rotation과 translation을 사용하여 예측된 mesh를 렌더링하여 얻은 렌더링된 depth map을 활용하였다고 합니다.

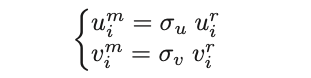

해당 과정은 그림(5)의 좌하단에 나타낸 것과 같이 보정 과정을 진행하는데요. 다음과 같은 과정을 거치게 됩니다.

- 렌더링된 depth map과 센서(measured) depth map 사이의 width \sigma_{u}와 height \sigma_{v} 비율을 구함

- 렌더링된 depth map Z_{r}=\{(u_{1}^r,v_{1}^r), ..., (u_{p}^r,v_{p}^r) \}에서 2D 포인트 p개를 샘플링(8개로 설정)

- measured depth map Z_{m}에서 해당 포인트를 찾는 과정 수행

- 최종 depth ratio를 구함

이로써 3D bbox와 translation이 모두 적절하게 scaling 되어 \mathbf t=\sigma_{z} \mathbf {\hat t}, \mathbf s=\sigma_{z} \mathbf {\hat s}로 변환할 수 있습니다.

해당 방법은 복잡한 scene을 위해 설계된 것은 아니지만, 센서 depth map에는 있지만 렌더링된 depth map에는 없는 점이 존재한다면, 다른 쌍이 샘플링 되므로 2D bbox의 크기가 다른 물체의 영향을 받지 않는 가벼운 occlusion뿐만 아니라 self-occlusion도 해결할 수 있는 효과가 있습니다. 해당 방법의 다른 특징은 3D point cloud에서 ICP(Interative Closest Point)와 같은 다른 보정 방법론에 비해 complexity가 낮다는 점도 있습니다.

Experimental results

제안된 i2c-net의 성능을 평가하기 위해 광범위하게 사용되고 있는 REAL275 벤치마크 데이터셋을 사용합니다. 제안된 아키텍처는 정량적 평가에 사용되는 REAL 데이터셋에서 사용되는 평가용 데이터와 관련이 없는 커스텀으로 제작한 photo-realistic 데이터셋으로 학습을 진행합니다. 또 다른 평가용 데이터로 YCB-V를 사용하는데요. 이는 i2c-net이 NOCS에서 제공하는 데이터셋 이외의 카테고리에서도 작동할 수 있음을 증명하기 위해 사용하였다고 합니다.

해당 실험은 다음과 같은 평가 메트릭을 사용합니다.

- 3D IoU : 예측된 3D bbox와 GT bbox의 교집합과 합집합 사이의 비율에 대한 AP(Average Precision)을 측정

- n cm, n^{\circ}는 해당 n만큼의 미만의 rotation과 translation에 대한 예측과 GT간의 오차 정도에 따라 AP를 측정

실험은 다음과 같은 환경에서 진행하였습니다.

- 프레임워크 : PyTorch

- GPU : NVIDIA RTX 3090(24GB)-학습 / NVIDIA RTX 3080(8GB)-평가

- 센서 : RGB-D Luxonis OAK-D camera

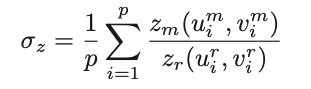

표(1)은 REAL275 데이터셋에서의 category-level의 평가 메트릭을 적용하여 SOTA 방법론들과 비교한 표입니다. 해당 표에 리포팅된 성능은 inference 할 때 depth correction과 같은 보정과 instance segmentation을 모두 활용한 성능을 나타냅니다. i2c-net은 다른 모델들과 비교했을 때 3D IoU의 성능이 월등히 높은 것을 확인할 수 있습니다. 다른 모델들은 학습 중에 실제 annotation에 의존적이기 때문에 NOCS 데이터셋에 포함되지 않는 category로 확장하는 것에 방해가 됨을 보여줍니다. 또한 표1의 모든 category-level 모델은 모두 depth 정보에 의존하고 있습니다.

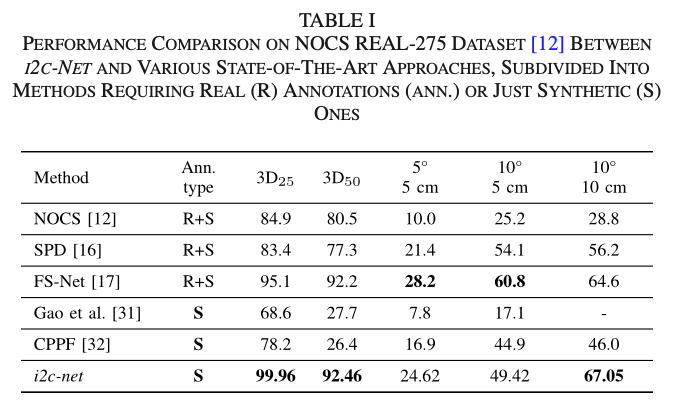

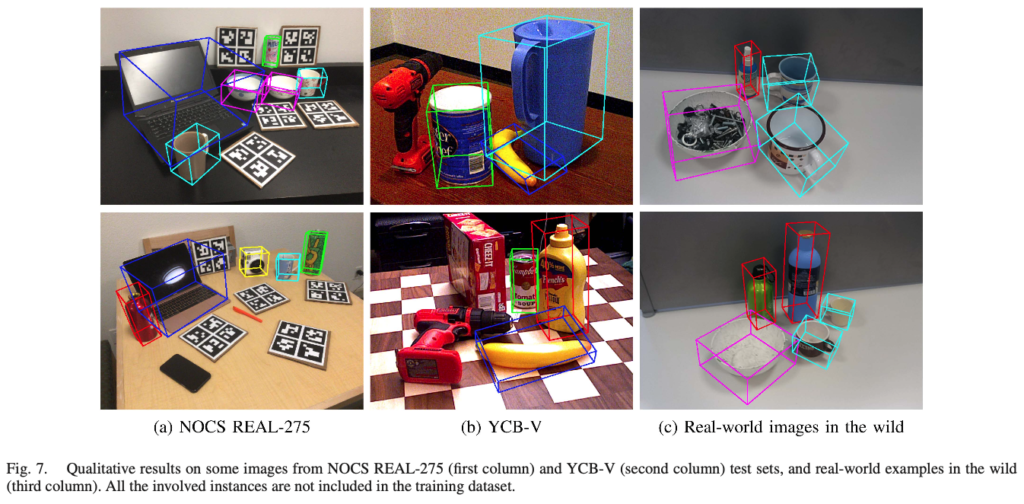

그림(6)은 3D IoU에 대한 AP와, rotation과 translation에 대한 오차 측면에서 다양한 category에 대한 정량적 결과를 그래프로 나타내었습니다. 각 메트릭에 대한 커브를 추출하기 위해 서로 다른 threshold를 사용하였으며, 당연히 AP는 100%에 가까울수록 좋습니다. 또한 그림(7)은 정량적 결과를 기반으로 하는 정성적 결과를 보여주고 있습니다.

다시, 그림(6)에 대해 분석을 해보면 translation error 같은 경우 3D reconstruction 과정에서 RGB 이미지만으로는 빈 공간에 대한 depth를 찾기에는 어렵습니다. 예를 들면 bowl 같은 경우라고 생각하시면 되겠습니다. 이러한 어려움을 겪는 bowl을 제외한 나머지 물체들은 어느정도 일관된 성능을 보여주고 있습니다. 하지만 이러한 모호성을 줄이기 위해서는 pose randomization 기법을 추가로 적용할 수 있습니다.

하지만 bowl, bottle은 대칭축을 따라 서로 다른 예측에 불이익을 주지 않는 rotation error에서는 오히려 평균 이상의 결과를 보여주는 것을 확인할 수 있습니다. 또한 대칭 물체는 적절한 3D shape reconstruction에 필요한 뷰포인트 수가 줄어드는 이점이 있다고 합니다. 따라서, 다른 category에 대한 학습 중에 뷰포인트 수를 늘리면 개선 효과를 얻을 수 있습니다. camera category의 경우 다른 category보다 높은 shape에 대한 가변성으로 인해 rotation error에 대한 성능이 낮게 나타났습니다. 반대로 labtop 클래스는 n cm, n^{\circ}에서는 제대로 작동하지만 3D IoU에서는 성능 드랍이 발생하게 되는데, 이는 물체의 관절 구조(노트북 같은 경우, 화면을 뒤로 젖히는 정도를 조절 – 이를 관절 구조라고 표현한 것 같습니다.)가 reconsturction된 3D 모델과 GT 3D 모델 간의 오버랩이 낮을 수 있기 때문에 pose 추정이 양호함에도 불구하고 성능 드랍이 발생할 수 있습니다.

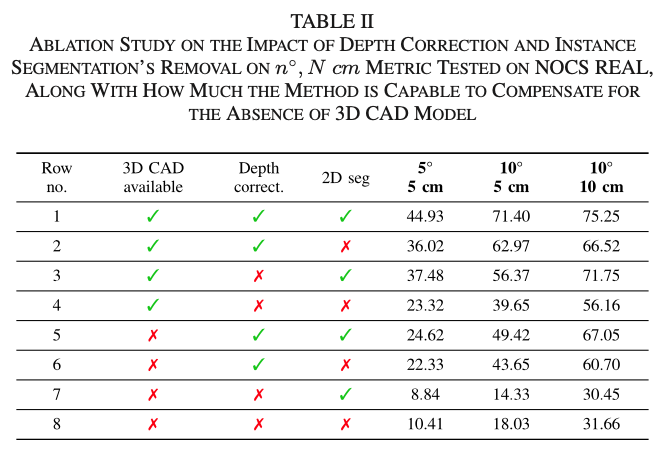

표(2)는 다양한 ablation study에 대한 결과들을 리포팅하고 있습니다. 1-4행은 GT 3D 모델을 사용할 수 있는 경우를 베이스라인으로 제시하여 5-8행은 inference 할 때, 3D 모델의 부재를 얼마나 보완할 수 있는지에 대한 정량적인 평가 결과를 나타내고 있습니다.

6, 8행과 5, 7행을 비교해보았을 때, 3D 모델을 사용할 수 없는 경우에 대해서 depth correction 모듈을 사용 유무에 대한 결과를 나타내고 있습니다. depth correction을 사용하는 것이 성능 향상이 됨을 입증하네요. 또한 occlusion에 대응하기 위한 instance-segmation은 1,3,5행과 2,4,6행을 비교해보았을 때 확실하게 성능이 개선됨을 보여줍니다.

Real-World Experiments

해당 파이프라인이 REAL275에 포함되지 않은 카테고리로 확장된 것을 증명하기 위해 그림 7(b)에는 YCB-V의 물체 중 banana에 대한 결과가 나와 있습니다. 해당 결과는 기존 데이터셋에 포함되지 않는 카테고리도 찾는 다는 것을 보여주는 것 같은데 드릴, 과자박스는 못 찾는데 이걸로 어필하기에는 좀 부족하지 않나 싶네요.

마지막으로 real-time에 대한 실험을 수행하였는데요. 각 pose 추정을 하는데 평균적으로 60.3ms의 시간이 소요되었으며, 이때 1000회 이상의 평가가 이루어졌다고 합니다. YOLOv5(small)을 사용하는 경우 12.8ms, instance-level pose estimation을 수행했을 때 27.7ms, 3D reconsturction은 7.4, depth correction은 12.4ms의 속도를 보여주었습니다. instance-segmentation이 아닌 실시간성 확보를 위해 YOLOv5를 사용하였으므로 성능면에서는 크게 좋지 않았을 것으로 보입니다.

Conclusion

이번 논문에서는 instance-level에서의 pose 추정 네트워크로부터 커스텀으로 제작한 합성 데이터셋을 학습에 활용하여 서로 다른 category에 속하는 여러 물체에 대한 6D pose를 추정하는 i2c-net을 제안합니다. 해당 데이터셋은 known(seen) 물체에 대한 기본 모델을 사용하여 domain randomization 목적으로 실제 텍스처와 같이 다양한 새로운 3D 모델을 제공합니다. instance-level pose estimation 모델로 선택된 네트워크는 이러한 augmentation된 photo-realistic 이미지로 학습할 수 있으며, inference 할 때는 category-level의 기능을 위해 3D mesh reconstruction 네트워크와 함께 사용됩니다. depth 정보는 보정을 위한 후처리에 사용됩니다. REAL275 데이터셋의 물체를 대상으로 실시한 평가한 결과 제안된 방법의 높은 정확도와 우수한 실시간 성능을 확인할 수 있었습니다.

이상으로 리뷰 마치도록 하겠습니다.

감사합니다.

안녕하세요 ! 좋은 리뷰 감사합니다.

방법론에서 유사한것들끼리 묶어서 공통된 결과를 얻을 수 있다면 해당 카테고리에 대한 중요한 특징이나 패턴을 파악할 수 있다고 말씀하셨는데, 6D pose estimtation에서 물체가 대칭/비대칭 물체인지도 중요한 고려사항 중 하나라고 알고 있습니다. 그러면 동일한 카테고리 내에서 서로 다른 종류의 물체가 대칭, 비대칭 특징을 가지고 있다면 이는 고려되는지, 된다면 어떻게 처리되는지 궁금합니다.

그리고 3D model reconstruction 모듈이 단일 뷰포인트가 주어졌을 때 3D mesh를 예측하도록 하는 방법을 학습하는데, 여기서 어떤 정보를 통해 예측 방법을 학습하게 되나요 . . ? 뭔가 싱글 뷰의 이미지만으로 3D reconstruction 예측이 가능한 과정이 잘 그려지지 않아 질문 드립니다.

감사합니다.

안녕하세요, 리뷰 읽어주셔서 감사합니다.

1. 대칭/비대칭 요소도 6D pose estimation task에서 중요한 의미를 가지는 게 맞습니다. 하지만, 이번 category-level에서의 6D pose estimation은 평가 지표도 그렇고 대칭/비대칭 요소까지 고려하는 것 같지는 않는 것 같습니다.

2. 해당 논문을 이해하면서 reconstruction 하는 부분이 이해가 잘 안됐었는데, 선행 연구를 기반으로 하기 때문에 설명이 부족했습니다. 제가 이해한 파이프라인은 다음과 같습니다.

– 물체에 대한 RoI를 추출하고 instance-level의 6D pose estimation 수행

– Meanshape(여러 mesh의 형태들이 있는 사전 지식)을 통해 Mesh를 reconsruction하는 과정 수행

– 예측한 mesh와 GT mesh가 같아지도록 학습함 – (MCMR 방법론 + DeepSDF 관점 -> 예측한 mesh에 대한 3D bbox를 학습)

– MCMR – 수많은 mesh 중 적절한 선택하도록 학습(selector)

– DeepSDF – 3D shape을 표현하는 방법이며 모델의 구조를 학습

– 예측할 때는 depth를 통해 reconstruction된 3D 모델이 입력으로 들어가게 됨

이해하는 데 도움이 되셨으면 합니다.

감사합니다.