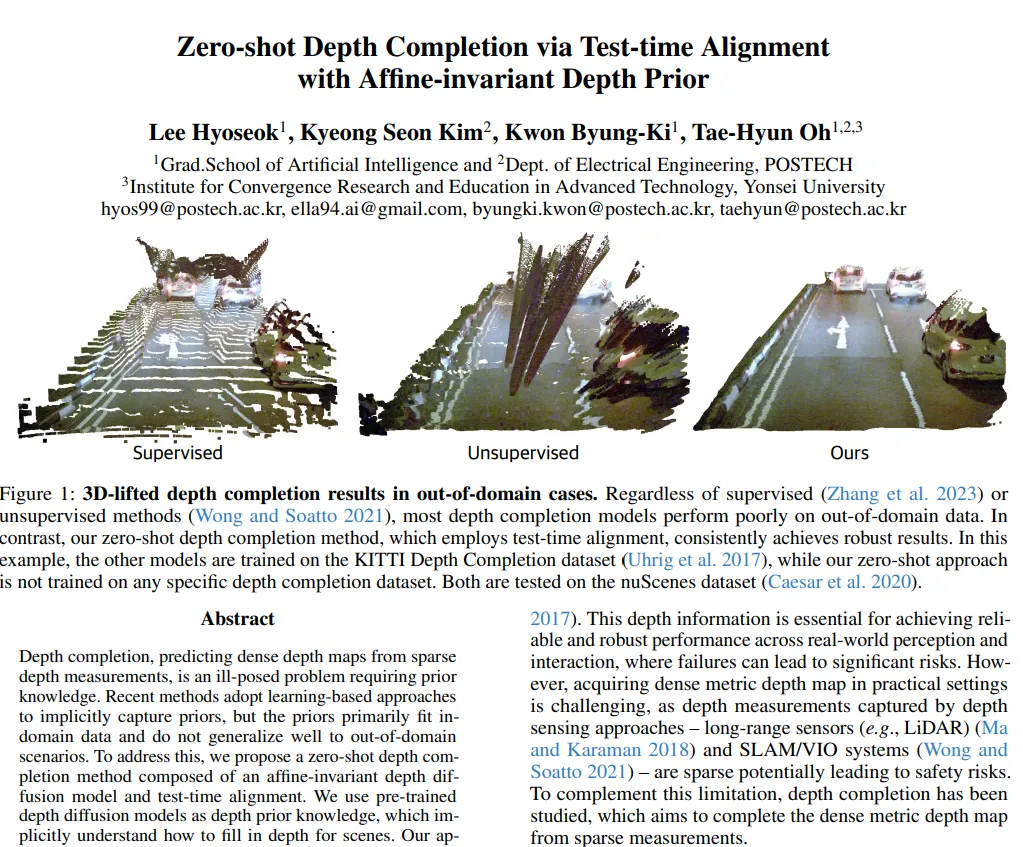

안녕하세요, 56번째 x-review 입니다. 이번 논문은 AAAI 2025년도에 게재된 depth completion 논문으로, 제가 이전에 리뷰한 Marigold를 활용한 방법론 입니다.

그럼 바로 리뷰 시작하겠습니다 !

1. Introduction

metric 스케일의 depth map은 현재의 scene에 대해 정확한 공간 구조를 제공할 수 있기 때문에 자율주행이나 로보틱스 등의 분야에서 중요한 요소 중 하나 입니다. 그러나 실제 depth 센서에서 얻은 depth 값은 대부분 sparse하여 실제 공간에 대한 dense하면서도 metric 단위의 depth map을 얻기는 쉽지 않다고 합니다. 그래서 sparse한 원래 depth map으로도 dense한 depth map을 얻기 위해 depth completion 연구가 진행되고 있었죠.

그런데 depth completion은 RGB 이미지와 같이 추가적인 정보가 필요한데, 이전까지의 연구는 대부분 in-domain 환경에서 RGB-depth pair 데이터를 가지고 depth affinity를 계산하는데 초점을 맞추고 있다고 합니다. 이렇게 되면 OOD 환경에서는 당연하게도 depth affinity를 제대로 파악하지 못하고 성능이 하락하게 됩니다. 이를 해결하기 위해 최근에는 sparse depth를 사용해서 사전학습된 depth completion 모델을 fine tuning하는 test-time adaptation 방식이 제안되기도 했습니다. 그런데 이러한 방식도 베이스 모델의 일반화 성능이 뛰어나지 않기 때문에 OOD에서 그렇게 효과적인 성능을 보여주진 못하였다고 합니다.

이러한 상황에서 현재 Foundation model이 등장한 만큼, FM은 일반화 성능이 뿐만 아니라 여러 prior를 사용해서 다양한 task와 도메인에 적용할 수 있다는 것이 입증되어 있습니다. 그래서 본 논문에서는 FM을 활용하여 모든 도메인에서 사용할 수 있도록 Test-time alignment (TTA)를 통한 제로샷 depth completion 방법론을 제안하고 있습니다. 구체적으로, 사전학습된 monocular depth estimation(MDE)를 위한 diffusion 모델의 결과를 사전 깊이 정보로 사용해서 depth completion이 가능하도록 설계하였습니다. 대부분의 MDE 모델은 affine-invariant한 depth를 예측하게 되는데, 이러한 depth 값은 스케일에 대한 모호성이 생겨 완전히 정확하게 공간의 depth를 추정할 수 없다는 한계가 존재합니다. 반면에 depth completion 모델은 sparse하긴 하나 metric 공간의 depth를 사용하기 때문에 스케일 모호성이 발생하지 않는 반면, 앞서 이야기한 것과 같이 일반화 성능과 MDE 대비 depth map의 퀄리티가 부족하다는 한계가 있습니다. 어떻게 보면 trade-off 관계를 가진 두 task를 가지고 affine-invariant한 depth와 metric depth 사이의 alignment를 inference 과정에서만 맞추어 사전학습된 MDE를 가지고 제로샷 기반의 metric depth completion을 수행할 수 있게 됩니다.

추가적으로 원래 depth completion의 입력인 sparse depth를 강한 제약 조건으로 적용한 최적화 방식을 통한 TTA 방식을 제안합니다. 그리고 측정한 depth map의 퀄리티를 보장하기 위해 사전 depth 정보 기반의 이상치 필터링 방식과 MDE의 사전 정보의 손실 없이 완전히 잘 활용하기 위한 새로운 loss 함수를 설계하였다고 합니다. 이러한 구조를 가진 본 논문의 모델은 다양한 도메인 데이터셋에서 높은 성능을 보이며 일반화 성능을 입증하였다고 합니다.

여기서 본 논문의 main contribution을 정리하면 다음과 같습니다.

- FM을 사용하여 일반화 능력을 갖춘 제로샷 depth completion 방법론 제안

- diffusion 샘플링 과정에서 affine-invariant depth와 metric sparse depth 간의 align을 맞추기 위한 test-time alignment(TTA) 설계

- sprase한 depth 측정값의 신뢰도와 강인성을 향상시키기 위해 사전 정보 기반의 이상치 필터링 알고리즘 설계

2. Method

2.1. Preliminary

Diffusion model and guided sampling

diffusion 모델은 데이터 분포 p(x)를 학습해서 새로운 데이터를 생성하는 모델로, forward 과정과 reverse 과정을 기반으로 동작합니다. forward 과정은 원본 데이터에 점점 노이즈를 추가하게 되고, reverse는 반대로 노이즈에서 원본 데이터로 복원하는 과정을 의미합니다. 모델이 여기서 학습해야 하는 건 노이즈를 제거하는 방식, 즉 데이터 분포 p(x)를 추정하는데, 이를 위해 점수 기반의 생성형 모델을 사용하게 됩니다.

점수 기반의 생성형 모델이라는건, diffusion 모델에서는 score function s_{theta}(x)를 학습하는데 이건 데이터의 로그 확률 밀도 함수의 그래디언트 s_{theta} = \triangledown_x log p(x;\theta) 입니다. 이는 데이터 분포를 보고 노이즈 데이터가 어떤 방향으로 변화해야 하는지를 학습하는 함수 입니다. 이 score function을 이용해서 reverse 과정에서 노이즈를 제거할 수 있습니다.

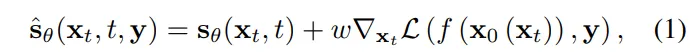

그런데 여기서, 단순한 diffusion 모델은 무작위로 이미지를 생성한다고 하면, Guided sampling으로 특정 조건을 주어서 특정한 스타일의 이미지를 생성할 수 있도록 조절할 수 있습니다. 가령 s_{theta}(xt, t)가 기본적인 score function이라고 해보겠습니다. 여기서 x_t는 t 시점의 노이즈 데이터를 의미를 의미하는데요, 여기에 guided sampling을 주어 식(1)과 같이 변경해보겠습니다.

- w : 가이드의 정도를 조절하는 가중치

- y : 조건 (원하는 이미지 스타일, 텍스트 프롬프트 등을 의미)

- f(x_0(x_t)) : x_0(x_t)를 변환하여 제공하는 조건과 비교할 수 있도록 하는 함수

- \mathcal{L}(f(x_0(x_t)), y) : 조건 y와 비교하는 loss

식(1)을 통해 기존 score function에 조건을 추가하여 원하는 조건의 이미지를 생성하는 방향으로 샘플링을 유도할 수 있습니다. 여기서 x_0(x_t)는 트위디 공식이라고 하는데, 이는 현재 상태 x_t에서 원래 데이터 x_0를 예측하는 방법을 의미합니다. diffusion 모델에서는 트위디 공식을 이용해서 reverse 과정 중에 노이즈가 제거된 데이터의 근사값을 얻을 수 있겠죠.

Inverse problem

앞선 Guided sampling은 특정 조건을 맞추는 방향으로 샘플링을 조정하지만, 확률적인 가이드를 제공할 뿐 측정값과 일치된다는 보장은 없습니다. 그런데 inverse problem에서의 목표는 주어진 데이터 측정값으로부터 알 수 없는 변수를 유추할 수 있어야 하죠. 즉 inverse problem은 단순한 조건부 생성의 문제가 아니라 정확한 측정값을 만족하면서도 원하는 조건의 이미지를 찾을 수 있어야 합니다. 다시 얘기하면, 단순하게 같은 스타일의 이미지가 아니라 원하는 데이터와 일치할 수 있도록 유도하는 과정이 필요하게 됩니다.

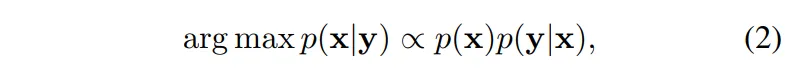

보통 inverse problem은 \mathcal{A}(x) = y로 정의합니다. 여기서 \mathcal{A}는 \mathbb{R}^m → \mathbb{R}^n는 forward 측정 연산이고 y \in \mathbb{R}^n은 측정값, 그리고 x \in \mathbb{R}^m은 저희가 찾고 싶은 알 수 없는 변수를 의미합니다. 만약에 m > n으로 변수가 더 많고 측정값이 적다면 ill-posed 문제가 발생하여 이럴 때 식(2)와 같이 사전 정보를 사용해 베이즈 정리를 이용해서 Maximum a Posetrior (MAP)를 추정하여 해결할 수 있다고 합니다.

- p(x) : 찾고자 하는 x에 대한 사전 정보

- p(y|x) : 주어진 x가 y를 생성할 가능성

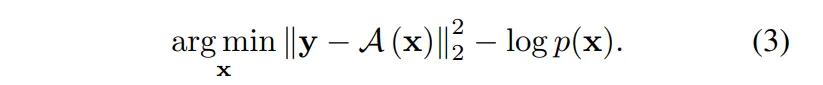

이 식을 로그로 변환하여 식(3)과 같이 최적화 문제로 바꿀 수 있습니다.

첫번째 항은 측정값 y와 모델 \mathcal{A}(x)가 최대한 일치하도록 계산되는 loss 함수이고, 두번째 항은 사전 확률 p(x)를 최대화하여 x가 원하는 특성을 따르도록 유도합니다. 즉, 측정값을 잘 맞추면서도 x가 사전 정보를 따르도록 할 수 있는 것이죠.

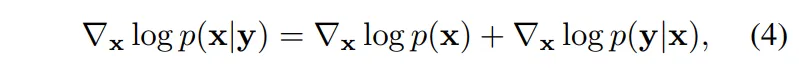

그런데 여기서 사전 확률 -logp(x)은 직접 다루기가 어려운 경우가 많아서 inverse problem을 해결하기 위해 diffusion 모델을 사용해서 p(x)의 정보를 활용하고자 하였습니다. 아까 score function에서 x_{\theta}(x)는 x가 어떤 값을 가져가야 할지의 방향을 알려줄 수 있는데, 바로 그 방향으로 가면 p(x)가 더 높은 값이 된다는 의미를 가지고 있습니다. 그러면 앞선 베이즈 정리에서 MAP 추정의 그래디언트를 살펴보면 식(4)와 같은데요,

첫번째 항이 사전 확률 p(x)의 그래디언트인데 이는 diffusion 모델로부터 얻을 수 있습니다. 두번째 항이 가능성 p(y|x)의 그래디언트로, 측정값과 맞추기 위해 추가되어야 하는 부분 입니다. 이렇게 diffusion 모델을 사용하게 되면 p(x)를 직접 다루지 않고도, score function으로 변환하여 사용할 수 있게 됩니다.

식(1)에서 그럼 단순 guided sampling이 아니라 inverse problem을 해결하기 위해 식(5)와 같이 수정할 수 있습니다.

식(1)과 (5)의 차이는 (1)에서는 y에게 부드럽게 가이드를 해줄 뿐이지만 inverse problem을 해결하기 위해 식(5)로 수정하면 측정값을 강제로 만족해야만 합니다. 오차를 최소화하는 방향으로 diffusion 모델의 샘플링을 조정함으로써 x가 실제 측정값과 최대한 일치하도록 조정하는 과정을 거치게 됩니다.

Problem formulation

앞서 여러 preliminary를 살펴보았는데요, 이번엔 위의 내용들을 기반으로 본 논문이 해결하고자 하는 문제에 대해서 정리해보도록 하겠습니다.

본 논문에서는 sparse한 depth map을 가지고 dense한 depth map을 복원하는 것을 최종 목표로 합니다. preliminary에서의 수식을 이용해서 표현하면, y가 sparse depth이고 x가 지금 예측하고 싶은 dense depth map을 의미하겠죠. 그리고 \mathcal{A}는 sparse depth 값 y가 실제 depth x에서 얻어진 부분을 나타내는 행렬을 의미합니다. [A]_{ij}가 만약에 1이면, x_{ij}의 depth 정보가 y_i에 포함되어 있다는 의미이고 반대로 0이면 y에서 측정되지 않은 영역을 의미합니다. 즉, sparse한 값인 y만 가지고 전체 depth map x를 복원하는 문제가 되는데 이건 위에서 이야기한 ill-posed inverse problem이기 때문에 사전 지식을 필요로 하게 됩니다. 그래서 본 논문에서는 diffusion 모델을 사전 지식으로 사용하는 것이죠.

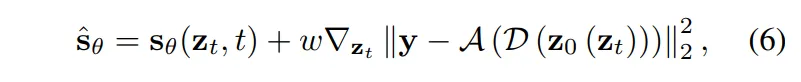

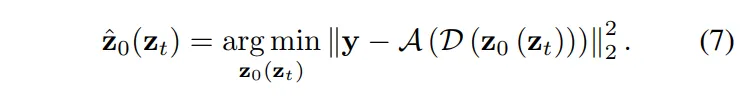

그런데 본 논문에서는 일반 diffusion 모델이 아니라 Latent Diffusion Model (LDM)을 사용하는데요, 이는 이미지를 저차원의 letent 벡터로 z로 변환한 후에 diffusion 과정을 거치고 마지막에 디코더 D를 사용해 원래 이미지로 변환합니다. 수식으로 나타내면 x = D(z)로 나타낼 수 있고, 이를 반영해서 최적화 식을 정의하면 식(6)과 같습니다.

첫번째 항은 기존 LDM의 score function으로 자연스러운 depth map이 되도록 하는 방향을 설계하는 사전 정보 역할을 합니다. 두번째 항이 sparse depth y와 일치하는 방향으로 조정하는 과정을 의미합니다. 결국 LDM을 통해서 자연스러운 depth map을 생성하면서도, y와 일치하도록 하는 과정 둘 다를 포함하고 있는 것이죠. 기존 diffusion 모델 샘플링 방식과 비교했을 때 y를 반영해서 inverse problem을 해결할 수 있도록 개선한 것을 차이점으로 이야기할 수 있습니다.

2.2. Test-time Alignment with Hard Constraints

여기서부터는 이제 본 논문에서 제안하는 방법론에 대한 설명 입니다.

depth 센서로 얻은 데이터는 센서에 노이즈가 존재하고, 균일하지 못한 분포를 가지고 있다는 한계가 있습니다. 그래서 저자는 애초에 y가 완벽하지 않아서 단순히 diffusion 모델을 사용하는 것만으로는 충분하지 않다고 판단합니다. diffusion 모델 자체가 확률적인 과정을 거치기 때문에 같은 입력 z_t에 대해 결과 x가 매번 조금씩 달라질 수 있는 것이죠. 따라서 식(6)과 같이 정의한 diffusion 모델이 항상 sparse depth 값 y와 일치하는 결과를 내놓을 거라고 확신할 수 없습니다. 식(6)은 측정값을 유도하는 과정에 그칠 뿐 강제적으로 일치하지는 않다는 것 입니다. 그래서 추가적인 alignment를 맞추는 과정을 통해, 측정값을 더 강한 제약 조건으로 적용하는 방식을 제안하였습니다.

본 논문에서 제안하는 Test-time alignment 과정은 두 단계로 나뉩니다.

(1) Optimization step

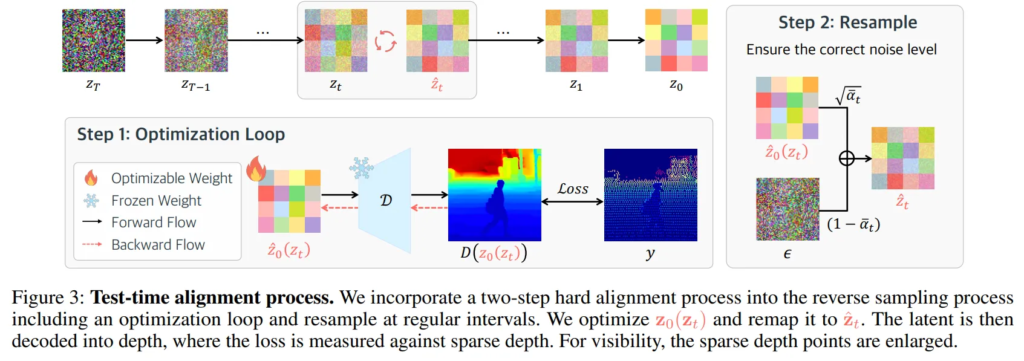

- 여기서 원하는건 z_t가 측정값 y와 잘 맞을 수 있도록 정렬하는 것이죠. 그래서 이를 위해 식(7)과 같이 z_0(z_t)를 최적화하는 과정을 추가하였습니다.

- 기존 diffusion 모델에서는 z_t를 샘플링하는 과정에서 끝났었는데, 식(7)에서는 z_t를 조정해서 측정값 y와 맞는 방향으로 수정하는 과정이 추가됩니다.

- → z_0(z_t)를 직접 최적화해서 측정값과의 차이를 최소화하는 과정

- → 기존 diffusion 모델의 확률적 샘플링에서 발생할 수 있는 오차를 줄이는 과정

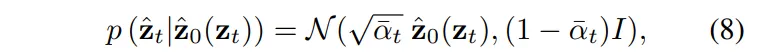

(2) Resampling Step

(1) 과정만 거치는 것이 아니라, diffusion 모델이 특정한 노이즈 스케줄에 따라 동작하기 때문에 조정된 z_0을 다시 diffusion 과정에 맞게 변환해야 합니다. 다시 말해서, diffusion 모델은 원래 특정한 노이즈 레벨에서 샘플링을 해야 하는데, 최적화한 z_0(z_t)는 노이즈 스케줄을 고려하지 않은 상태인 것이죠. 그래서 최적화된 z_0(z_t)를 다시 diffusion 모델의 노이즈 분포에 맞춰주는 과정이 필요한데, 이걸 Resampling 스텝을 의미합니다. 다시 diffusion 모델의 분포에 맞게 변환하기 위해 가우시안 노이즈를 다시 추가하는 과정을 식(8)과 같이 정의하는데,

- \bar{\alpha}_t : diffusion 과정에서 특정 타임 스텝 t에서의 노이즈 가중치

기존의 수식과 다르게 z_0(z_t)를 활용한 alignment 과정이 추가되어 있습니다.

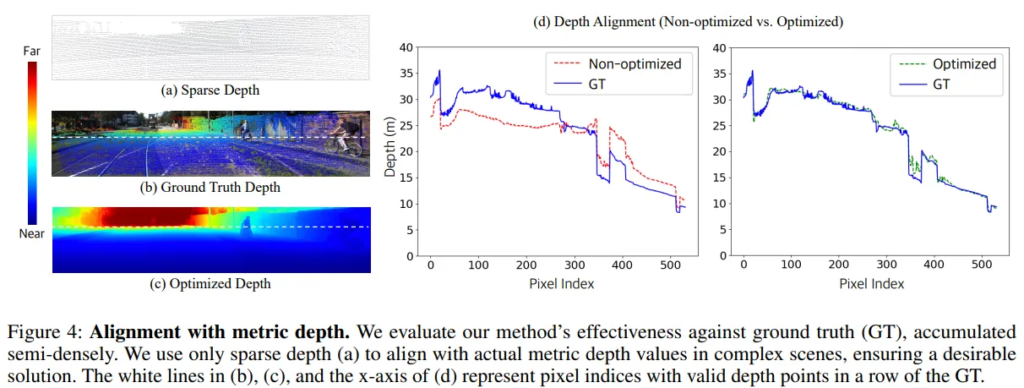

Fig.3은 TTA 과정을 보여주며, Fig.4는 TTA 방식이 sparse 측정값을 affine-invariant depth 사전 정보와 align을 맞추어 dense한 depth 영역을 효과적으로 추정하고 있는지에 대해 보여주고 있습니다.

2.3. Prior-based Outlier Filtering

depth 센서는 종종 RGB 센서와 동기화가 되어 있지 않거나, 유리나 투명한 표면 등을 통과하여 잘못된 값을 가지고 있을 수 있습니다. 이런 이상치 값들이 포함되면 depth completion의 성능이 저하될 수 있겠죠. 많은 depth completion 모델은 sparse depth 데이터를 학습 과정에서 supervision으로 사용하고 있습니다. 하지만 이상치가 포함된 depth 값이 모델 학습에 사용되면 특히나 마지막에 복원된 depth map이 부정확하게 만들어질 수 있겠죠.

본 논문에서 제안한 TTA 역시도 sparse depth 측정값을 supervision으로 사용하기 때문에 align을 맞추는 과정에서 수렴 속도가 느려지거나 아예 발산할 가능성이 생기게 됩니다. 이를 방지하기 위해서 단순히 sparse depth를 직접 사용하는게 아니라 데이터 기반의 depth 사전 정보를 사용합니다. 그러면 RGB 이미지와 depth 데이터 간의 관계를 학습할 수 있기 때문에 더 정확한 alignment를 맞출 수 있기 때문입니다.

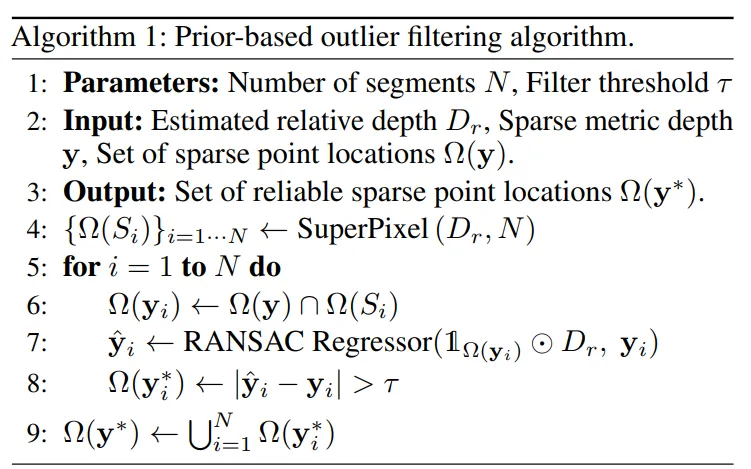

그럼에도 존재하는 이상치를 제거하여 깨끗한 sparse depth 값 y^*를 얻기 위해, devide-and-conquer(dac) 방식을 사용한다고 합니다. dac는 전체 데이터를 한꺼번에 처리하는 대신, 로컬하게 나누어 이상치를 찾고 제거하는 방식으로, depth affinity를 기반으로 로컬한 영역 안에서 비슷한 depth 값을 갖는 영역을 그룹화합니다. 같은 영역 안에서는 depth 값이 서로 유사해야 정상적인 데이터이고, 크게 벗어나는 값을 가지면 이상치로 간주하게 됩니다.

좀 더 구체적으로 보면, Affine-invariant depth map D_r은 로컬한 위치를 고려해서 비슷한 depth를 가질 가능성이 높은 영역인 S_i로 나뉩니다. 이 때의 클러스터링을 위해서는 superpixel 알고리즘을 활용하는데, 이를 통해 유사한 depth 영역을 효과적으로 찾을 수 있습니다. 클러스터링한 각 영역에서 sparse metric depth y_i를 사용하여 affine-invariant depth와 metric depth로 매핑하는 linear least-square fitting을 수행한다고 합니다. 이 과정을 통해 affine-invariant depth와 metric depth 간의 비례 관계를 찾아서 변환하게 되는 것이죠. 그런데 여기서 sparse depth 값에 이상치가 포함되어 있을 수 있기 때문에 RANSAC을 이용해서 이상치를 제거하게 됩니다.

아래의 Algorithm 1이 사전 정보를 이용한 이상치를 필터링 과정을 설명하고 있습니다.

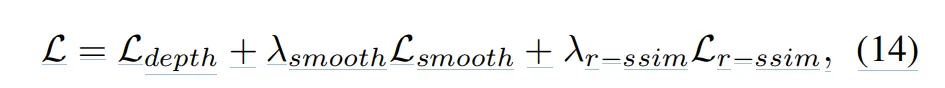

2.4. Losses

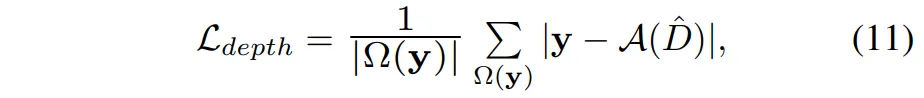

본 논문의 loss는 sparse depth의 일관성을 유지할 수 있는 loss와 정규화에 대한 loss로 이루어져 있습니다. 정규화 loss는 사전 depth 정보를 유지하기 위한 local smmothness loss와 depth 정보의 내재된 구조적인 특성을 유지하기 위한 relative structure similarity loss를 포함하고 있습니다.

sparse deph consistency

먼저 sparse depth consistency loss는 복원된 depth 값이 센서에서 측정한 값과 최대한 일치할 수 있도록 보장해야 합니다. 식(11)과 같이 L_1 loss 사용하여 정의할 수 있습니다.

- \mathcal{A} : depth 측정값이 유효한 픽셀에 대해서만 Hadamard product

- \hat{D} : 복원된 depth map

즉 식(11)과 같이 L1 loss를 적용해서 sparse한 depth 값이 존재하는 위치에서만 loss를 계산하게 됩니다.

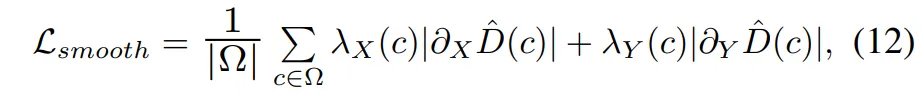

Local smoothness

그러나 위의 sparse depth 측정값만을 활용하면, 사전학습된 diffusion 모델이 가진 local smoothness 특성이 손실될 수 있다고 합니다. 이러한 손실을 막기 위해, depth map의 x, y 방향의 gradient에 대해 식(12)와 같이 L1 loss를 추가하여 급격한 변화가 발생하는 것을 방지하도록 하였습니다. 추가적으로 엣지 근처에서는 가중치를 줄여서 과도한 smoothing이 일어나지 않도록 하였습니다.

- \lambda_X(c), \lambda_Y(c) : 모든 위치의 픽셀 집합

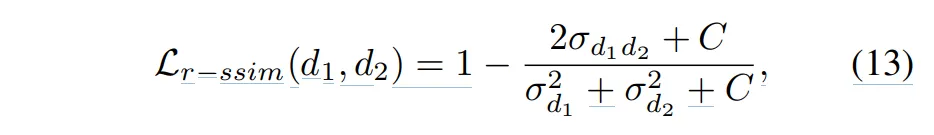

Relative Structure Similarity

smoothness loss만을 추가로 사용하게 되면, 사전학습된 depth diffusion 모델에서 디테일한 구조적인 정보가 약해질 수 있습니다. 너무 smooth하기만 한 depth map이 아니라 원래의 구조적인 정보를 유지할 수 있도록 기존 SSIM loss에서 밝기에 대한 부분을 제거하여 변형한 R-SSIM이라는 loss를 식(13)과 같이 추가적으로 설계하였다고 합니다.

- d_1, d_2 : 서로 다른 도메인의 depth 정보 (relative depth vs metric depth)

- \sigma_{d_1d_2} : 두 depth map 사이의 공분산

위의 세 loss를 모두 합친 본 논문의 최종 loss function은 식(14)와 같습니다.

3. Experiments

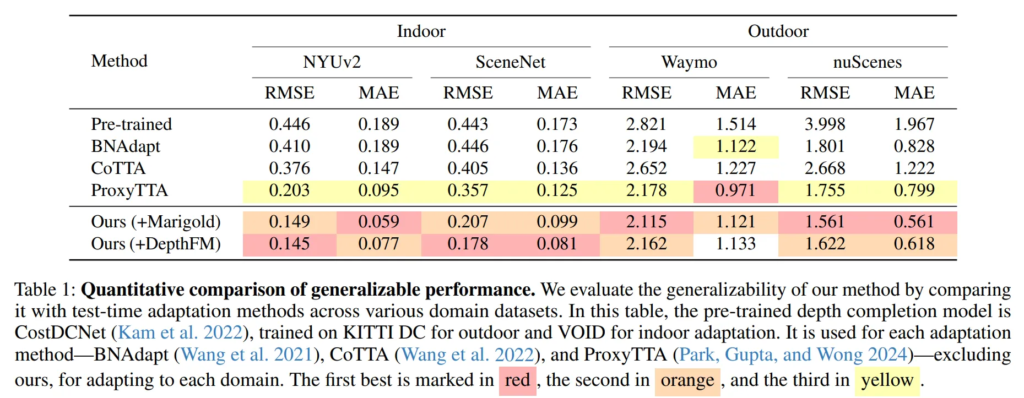

실험에는 indoor 데이터셋인 NYUv2, SceneNet 그리고 VOID와 outdoor 데이터셋인 Waymo, nuScenes, 그리고 KITTI DC를 사용하였다고 합니다.

3.1. Domain Generalization

먼저 Tab.1은 indoor와 outdoor scene에서 이전의 test-time adaptation 방식과 비교했을 때의 DG 성능을 평가하였는데 모든 데이터셋에서 SOTA 혹은 그에 준하는 성능을 달성하였습니다. 이를 통해, metric 공간에서 사전학습된 depth completion 모델에 의존하는 이전 방식들과는 다르게 affine-invariante depth 공간의 결과를 활용하면서도 유사한 성능을 달성할 수 있었습니다. 또한 Marigold와 DepthFM이라는 depth diffusion 모델을 사용함으로써 일반화 성능을 갖추었다는 것을 입증할 수 있다고 하네요.

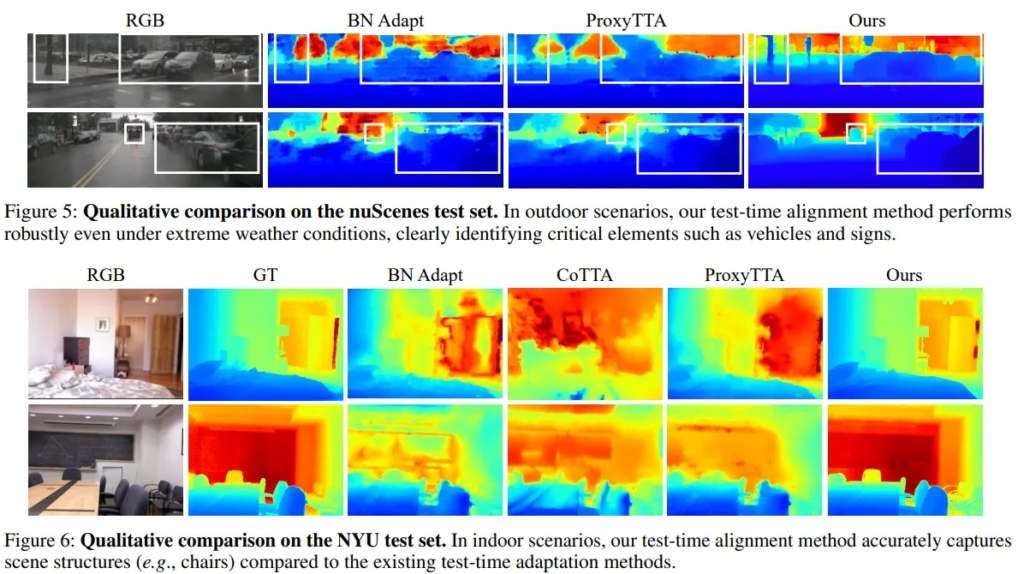

Fig.5와 6은 정성적인 결과로, 주어진 scene 내의 디테일한 영역에 대해서도 표현할 수 있으며 indoor와 outdoor에서 모두 동작하면서 도메인 일반화가 가능하다는 것을 강조하고 있습니다.

3.2. Comparison with Depth-Prior-Based Methods

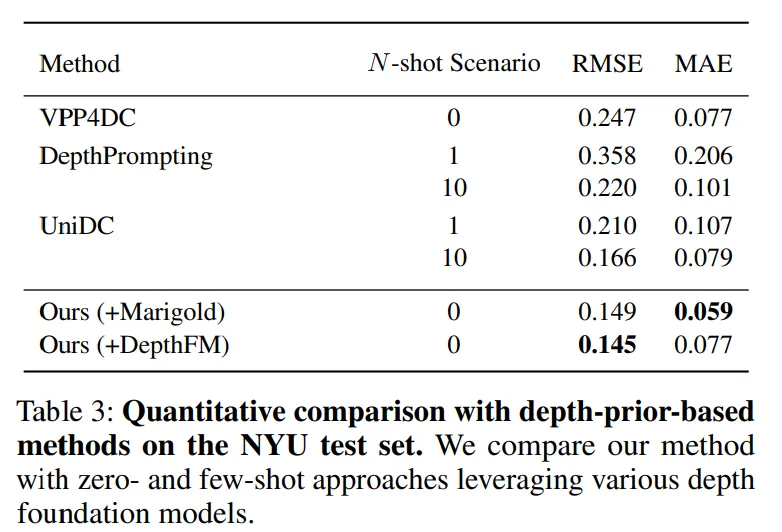

그 다음 Tab.3은 Depth FM을 사용하는 방법론들과의 비교한 실험 결과 입니다. 저는 이 표가 앞의 인트로에서 주장한 것과 같이 사전학습된 depth completion을 위한 모델에 비해 depth diffusion 모델의 affine-invariant depth를 잘 활용한 것을 보여줄 수 있는 중요한 실험 결과라고 생각하였는데요 .. 그저 해당 표가 depth diffusion 모델을 활용하는 것의 효과를 보여준다라고만 표현할 뿐 추가적인 분석이 아예 없어서 굉장히 아쉽습니다. 어쨌든 저자의 주장대로 Depth anything 같은 FM을 사용하는 것보다 MDE를 위해 설계된 depth diffusion 모델을 활용한 본 논문의 모델이 가장 좋은 성능을 보여주고 있긴 합니다.

3.4. Ablation Studies

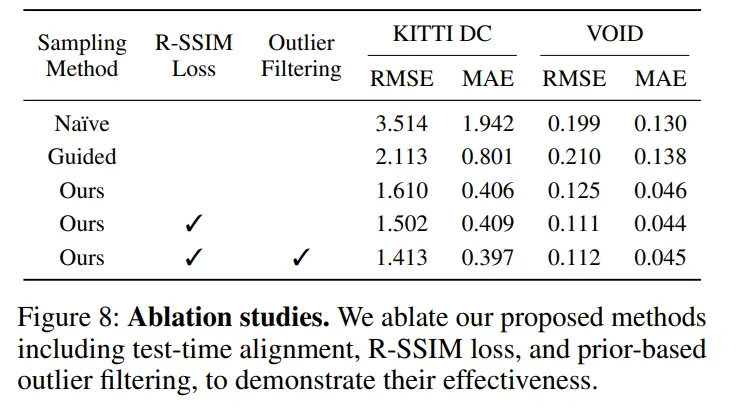

마지막으로 Tab.8은 (캡션은 Fig.8로 들어가있긴 합니다만) TTA, R-SSIM loss, 그리고 이상치 필터링 알고리즘의 효과를 평가한 ablation study 입니다. 가이드가 아예 없는 Naive, 기존이 Guided sampling 방식을 사용하는 Guided와 본 논문의 가이드 방식을 사용하면서 다른 알고리즘을 추가하였을 때의 성능 변화를 보여주고 있습니다. 우선 본 논문의 강한 제약을 주는 가이드 샘플링 방식을 사용했을 때 큰 성능 개선이 나타나는 것을 알 수 있습니다. 추가로 R-SSIM loss는 depth affinity를 보존하면서 성능을 더 개선할 수 있는 것을 확인할 수 있습니다. 마지막으로 이상치 필터링은 indoor보다는 outdoor 데이터셋에서 더 효과적이라는 것을 알 수 있습니다. 이러한 결과를 통해 본 논문에서 제안하는 여러 알고리즘과 모델이 depth completion을 수행하는데 효과적이라는 것을 입증하고 있습니다.

안녕하세요! 좋은 리뷰 감사합니다.

본 논문은 Marigold와 같은 사전학습된 MDE 모델의 결과를 이용해서 depth completion을 수행하였다고 이해하였습니다. 그런데 기존 방식에서의 가이드 샘플링과 강한 제약을 준다는 본 논문의 방식이 sparse depth map이 가지는 metric 공간으로 갈 수 있도록 유도한다는 공통점이 있는데, 그 차이에 대해서 명확하게 구분이 잘 되진 않는 것 같습니다. 조금만 더 자세하게 설명해주실 수 있을까요 ?!

감사합니다.

안녕하세요, 리뷰 읽어주셔서 감사합니다.

기존 가이드 샘플링은 diffusion의 score function에 sparse depth 경향성을 따르도록 유도하는 방식이라면, 본 논문의 강한 제약이 더해지면 아예 diffusion의 denoising 결과를 sparse depth에 맞게 거의 강제로 최적화하는 방식 입니다.

원하는 결과를 얻도록 과정을 유도하는지, 아니면 결과 자체를 원하는 형태로 변형하는 지의 차이라고 이해해주시면 좋을 것 같습니다.

감사합니다.

좋은 리뷰 감사합니다.

Prior-based Outlier Filtering파트에서, dac 방식을 위해 로컬 영역 안에 비슷한 depth를 가지는 영역을 그룹화한다고 하셨는데, 하늘과 같이 큰 영역을 차지하는 경우도 하나로 그룹화가 되는 지 궁금합니다.

또한, 해당 방법론은 데이터 별로 모델을 학습하고 평가하는 방식인지 궁금합니다. 문제정의를 할 때 OOD 이야기를 하여, 조금 더 일반화 가능성에 대해 보이지는 않았는 지 궁금하여 질문드립니다.

안녕하세요, 리뷰 읽어주셔서 감사합니다.

그룹화하는게 suprepixel segmentation이라고 해서 segment 영역이 나눠진다고 적혀있는데, 하늘과 같은 배경의 영역들이 어떻게 나눠지는지는 예시가 없어서 잘 모르겠습니다만 .. 아마도 같은 영역으로 그룹화 될거라고 저는 생각하고 있습니다. 그런데 outdoor scene의 하늘 같은 부분은 sparse depth에서 거의 표현이 되지 않기 때문에 크게 고려했을 지는 의문이긴 합니다.

우선 모델의 평가 방식 같은 경우는, Marigold가 합성 데이터셋으로 학습이 되어 있고 Marigold를 real 데이터로 inference를 해서 relative depth를 먼저 얻습니다. 그 다음에 본 모델로 inference를 하는 것이기 때문에 별도의 학습 과정은 없고 zero shot으로 Marigold 학습 데이터셋 외 여러 데이터셋에서 평가함으로써 일반화 가능성을 보이고 있습니다.

감사합니다.

손견화 연구원님, 좋은 리뷰 감사합니다. 제가 depth completion쪽을 평소에 안 봐서 그런지, 이해하기 쉽지 않네요.. 질문 남기도록 하겠습니다.

1. inverse problem파트의 A(x)=y에서 x의 차원 m이 y의 차원 n보다 클 때 ill-posed 문제가 발생하여 식 (2)의 식으로 사전 정보를 사용해 베이즈 정리를 이용해 추정한다고 했는데, ill-posed 문제가 무엇인지와, 식 (2)의 베이즈 정리로 어떻게 추정하는지 조금만 더 설명해주시면 감사하겠습니다.

2. depth completion 분야에서 metric 공간, depth affinity가 무엇을 의미하는지 궁금합니다.

감사합니다.

안녕하세요, 리뷰 읽어주셔서 감사합니다.

1. ill-posed 문제는 답을 얻기 위한 sparse depth가 정보가 부족하여 원하는 결과물이 항상 동일한 depth map, 그러니까 GT와 최대한 유사한 수준의 depth map을 항상 얻을 수 없음을 의미합니다. 저도 베이즈 정리를 완전히 이해하지는 못하지만 본 논문에서는 sparse depth로는 부족한 정보를 relative depth를 활용하려는 거기 때문에 relative depth라는 단서가 있을 때 sparse depth와 핏이 맞는 depth map을 생성할 가능성을 찾는다고 이해하였습니다.

2. metric 공간은 말 그대로 절대적인 depth 수치를 의미합니다. (의자가 2m depth의 위치해 있다 등등 ..) depth affinity는 모델이 학습을 할 때 보는 scene에서 각 영역 사이의 거리나 기하학적인 관계를 의미합니다.

감사합니다.