안녕하세요 손우진입니다.

이번 리뷰는 제목을 보고 안 읽을수가 없었던 논문을 소개드리고자 합니다. 이번에 소개 드릴 논문은 열화상의 Representation을 잘 표현하는 backbone을 제안한 논문인데요. 열화상 이미지 같은 경우는 데이터셋이 RGB에 비해 너무나도 작은 데이터뿐이라 foundation 모델로 활용하기에는 큰 어려움이 있었습니다.

실제로 RGB 분야는 대규모 데이터를 바탕으로 파운데이션 모델들이 발전했지만, 열화상 데이터는 그런 데이터 셋이 부족하다 보니 모델이 특정 태스크에 과적합되는 구조적인 한계가 있습니다. 그렇다고 처음부터 열화상 대규모 모델을 학습시키기에는 데이터 수집의 장벽이 높기에 어려움이 있을 것 같습니다.

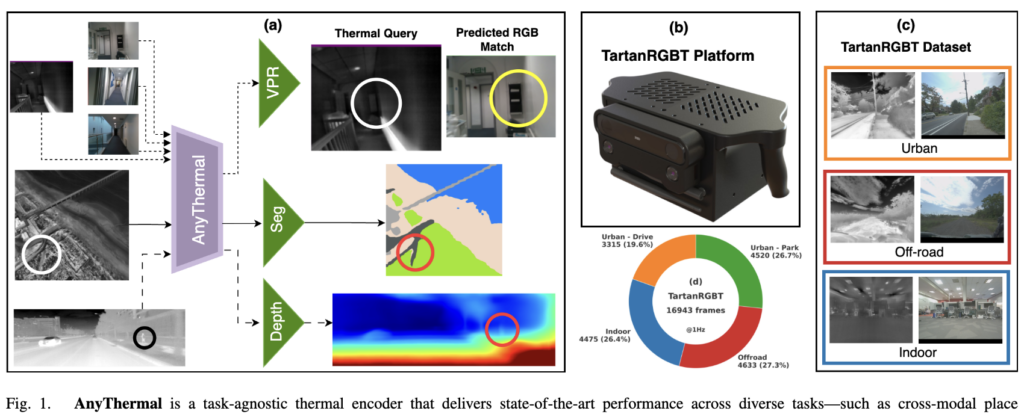

그래서 이 논문에서는 기존에 잘 학습된 RGB 모델의 지식을 열화상 모델로 넘겨주는 Knowledge Distillation 방식을 사용하여, Task-agnostic열화상 백본인 AnyThermal을 제안합니다. 심지어 이를 위해 하드웨어적으로 동기화된 다중 환경 RGB-T 데이터 수집 플랫폼과 데이터셋까지 직접 구축했다고 하는데요. 리뷰 해보도록 하겠습니다

Introduction

다들 잘 아시겠지만, 열화상 이미지는 조명 조건이나 날씨 변화에 강건하여 perception 분야에서 필수적으로 다뤄지는 모달리티입니다. 하지만 인터넷 규모의 데이터셋을 바탕으로 발전한 RGB 기반와는 달리, 열화상 데이터는 그런 자원이 적어 대규모 학습의 이점을 얻기 어려웠습니다. 이로 인해 기존 연구들은 주로 특정 태스크에 맞춰 사전 학습된 RGB 백본을 finetuning 하는 방식을 사용했지만, 열화상만의 특징을 제대로 잡지 못해 일반화성이 크게 떨어지는 한계가 있었습니다.

이를 해결하기 위해 RGB 모델의 지식을 열화상 모델로 전달하는 knowledge Distillation 기법이 연구되었지만, 이 역시 단일 환경에만 의존했기 때문에 한계가 명확했습니다. 이 논문은 이러한 도메인 과적합을 막기 위해 다양한 환경의 RGB-T 데이터셋을 결합하여 지식 증류를 수행하는 AnyThermal 백본을 제안합니다.

이 논문은 또한 다중 환경 데이터를 확보하기 위해 하드웨어적으로 동기화된 데이터 수집 플랫폼을 직접 구축했다는 것입니다. 센서 간의 데이터를 픽셀 수준으로 정렬(Alignment)하는 것은 매우 까다로운 작업인데, 논문에서는 스테레오 RGB 기반의 깊이 추정 알고리즘(FoundationStereo)을 활용하여 이 문제를 풀고자 했습니다. 구체적으로는 추정된 dense depth 맵을 이용해 RGB 픽셀을 3D 공간으로 역투영한 뒤, 미리 캘리브레이션된 extrinsics 파라미터를 통해 열화상 카메라 프레임으로 변환하고 다시 2D로 투영하는 방식을 채택했습니다.

하지만 이 방식에는 명확한 한계점이 존재하긴 합니다. 스테레오 기반의 깊이 추정은 완벽하지 않으며, 여기서 발생하는 뎁스 오차는 곧바로 두 모달리티 간의 픽셀 정렬 오류로 나타날 것 입니다. 또한, 열화상 카메라가 RGB 카메라 아래에 장착된 구조 때문에 시야각 차이가 발생하여, 열화상 뷰 하단에는 RGB 정보가 아예 존재하지 않는 Black pixels이 생기게 됩니다. 저자들은 이를 완화하기 위해 Z-버퍼와 bilinear splatting 같은 후처리를 적용했지만 , 결국 불완전한 뎁스 정확도 때문에 자신들이 구축한 TartanRGBT 데이터셋을 깊이 추정(Depth Estimation)이나 교차 모달 장소 인식(VPR) 같은 정밀한 벤치마크 평가에는 사용하지 못했다고 명시했습니다. 아직까지 분명한 열화상 rgb의 공간에는 한계가있는 것 같습니다. (너무 기대하고는 안보셨으면 해서 intro에 작성했습니다..ㅎ)

논문에 작성된 Contribution은 다음과 같습니다.

- AnyThermal: RGB와 열화상 이미지 간의 지식 전이를 통해 얻은 열화상 이미지용 task-agnostic 특징 추출기입니다. AnyThermal을 task-specific 헤드와 결합할 경우,thermal segmentation 및 cross-modal place recognition과 같은 다운스트림 태스크에서 여러 환경에 걸쳐 state-of-the-art 성능을 달성함을 보여주며, 단일 열화상 깊이 추정 monocular thermal depth estimation과 같은 태스크에서는 비슷한 크기의 RGB 기반 백본보다 우수한 성능을 냅니다.

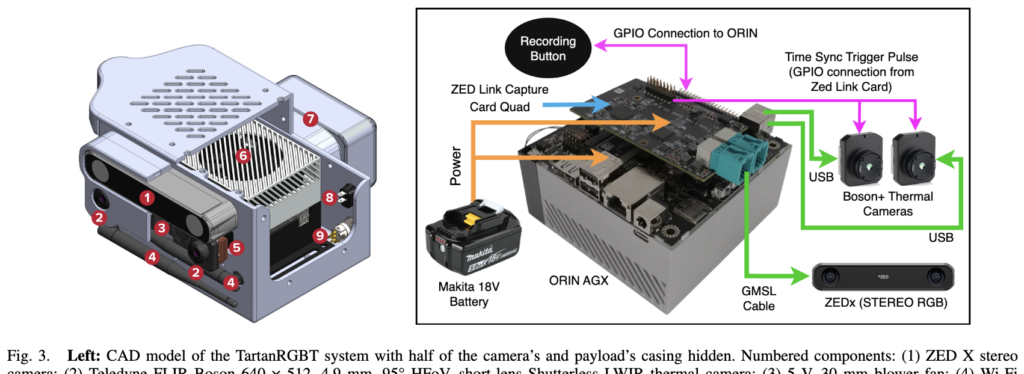

- TartanRGBT platform: 동시에 캡처되는 스테레오 RGB 및 스테레오 열화상 이미지를 수집하기 위한 오픈 소스 데이터 수집 플랫폼입니다. 저자들이 아는 한, 이는 열화상 이미지를 위한 최초의 오픈 소스 데이터 수집 플랫폼입니다.

- TartanRGBT dataset: TartanRGBT 플랫폼을 사용하여 다양하고 균형 잡힌 데이터셋을 수집했습니다. 이 데이터셋은 주거 지역, 캠퍼스, 실내 환경, 오프로드 지형, 공원 및 트레일을 포괄합니다. 또한, 이 데이터셋이 다양한 환경 전반에서 여러 열화상 다운스트림 태스크에 대한 AnyThermal의 성능을 어떻게 더욱 끌어올릴 수 있는지 보여줍니다.

Method

이 논문에서 제안하는 AnyThermal의 핵심은 완전히 새로운 네트워크 구조를 설계하는 것이 아닙니다. 제안한 다중 환경 데이터셋을 활용해 기존의 파운데이션 모델의 지식을 열화상 도메인으로 전이시켜 백본을 재학습하고, 이를 다양한 다운스트림 태스크에서 평가하는 것 입니다. 추가적으로 이 학습 데이터를 수집하기 위해 열화상과 RGB를 동시에 동기화하여 촬영할 수 있는 하드웨어 플랫폼을 함께 제안했습니다.

Knowledge Distillation

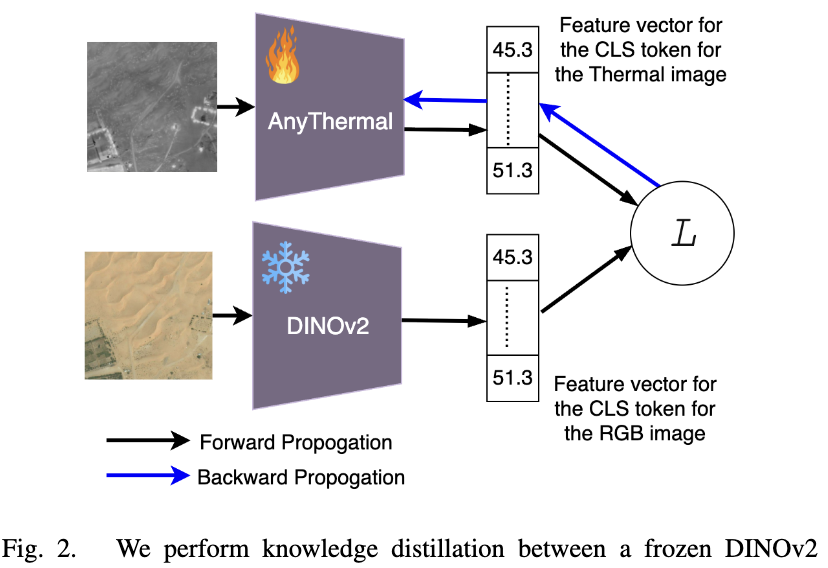

저자들은 Teacher-Student 구조의 지식 전이를 도입했습니다. 스크레치부터 학습하는 것이 아니라, 두 네트워크 모두 사전 학습된 DINOv2(ViT-B/14) 가중치로 동일하게 초기화를 한 상태에서 시작합니다.

학습은 별도의 Self-supervised 방식으로 진행됩니다. 먼저, RGB 이미지를 가중치를 freeze, Teacher 네트워크에 통과시켜 타겟이 되는 RGB의 CLS 토큰 특징 벡터를 뽑아냅니다. 동시에 단일 채널의 열화상 이미지를 3채널로 변환하여 Student 네트워크에 통과시켜 열화상 CLS 토큰 특징 벡터를 얻어냅니다. 이후 이 두 CLS 토큰 벡터 간의 Contrastive Loss를 계산하고, 이 Loss를 오직 Student 네트워크 쪽으로만 역전파시켜 가중치를 업데이트합니다. 사실 학습방법은 매우 간단합니다.

여기서 아키텍처적으로 패치(Patch) 단위로 대응점을 찾아 Loss를 계산하지 않고, 네트워크 최종 레이어의 CLS 토큰 특징에만 Contrastive loss를 적용했다는 점이 포인트인데. 앞서 서론에서도 언급했듯, 센서 간의 완벽한 픽셀 Alignment나 시간 Time-sync(동기화)는 까다롭고 오차가 발생합니다. 만약 픽셀이나 패치 단위로 타이트하게 loss를 주었다면 이러한 물리적인 정렬 오차가 학습에 치명적인 노이즈로 작용했을 것입니다. 하지만 CLS 토큰은 색상 같은 로컬 특징이 아니라 이미지 전체의 전역적인 semantic 정보를 담고 있습니다. 따라서 픽셀 정렬이 다소 어긋난 데이터셋들을 학습에 활용할 때도 공간적 제약을 완화하여 지식을 전이할 수 있다는 장점을 갖습니다.

이렇게 제안한 5개의 다중 환경 데이터셋을 섞어서 전이를 마친 AnyThermal 백본은 특정 도메인에 편향되지 않은 범용적인 특징 추출기가 된다고 저자는 주장합니다. 이후 저자들은 이 백본의 가중치를 고정시킨 상태에서 각 다운스트림 태스크의 목적에 맞는 가벼운 Task-Specific Head만 부착하여 모델의 일반화성을 입증했습니다. 예를 들어 VPR 태스크에서는 재현율이 높은 SALAD 헤드와 Triplet margin loss를 결합하여 열화상 쿼리에 맞는 RGB 이미지를 찾도록 훈련했습니다. 열화상 Segmentation에는 무거운 디코더 대신 가벼운 2-layer MLP와 Dice loss를 적용하였고 Depth Estimation에는 기존 MiDaS 프레임워크를 그대로 가져오되 특징을 추출하는 백본만 AnyThermal로 교체하는 방식을 채택했습니다.

이처럼 다양한 환경 데이터의 지식 전이를 성공적으로 수행하기 위해서는, 결국 다양하고 품질 좋은 RGB-Thermal 쌍 데이터를 확보하는 것이 필수적입니다. 이를 위해 저자들은 단순히 알고리즘만 제안하는 데 그치지 않고, 오픈소스로 활용 가능한 데이터 수집 플랫폼인 TartanRGBT Platform을 직접 구축했습니다.

TartanRGBT PLATFORM

다양한 환경에서 RGB-T 쌍 데이터를 수집하기 위해 저자들은 자체적인 오픈소스 하드웨어 플랫폼을 구축했습니다. 컴퓨팅 모델은 AGX ORIN 64GB를 사용했으며, 스테레오 RGB 및 IMU 데이터 수집을 위해 ZEDx 카메라를, 스테레오 열화상 데이터 수집을 위해 2대의 FLIR Boson 640+ 카메라를 장착했습니다. 센서 간의 시간 동기화는 소프트웨어 단이 아닌 하드웨어 레벨에서 맞추었습니다.

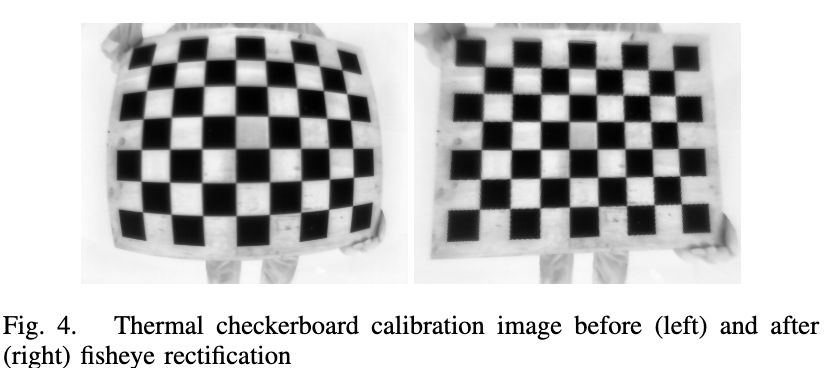

위 그림은 전체 플랫폼입니다. 우선 캘리브레이션 같은경우 RGB 카메라의 Intrinsics은 제조사에서 제공하는 공장 출고 캘리브레이션 값을 그대로 사용했습니다. 반면, 열화상 카메라의 내부 파라미터와 왜곡을 잡기 위해서는 커스텀으로 제작된 heated checkerboard를 사용했습니다.

이 체커보드 같은경우 샌드블라스트 처리된 알루미늄 정사각형 패턴을 검은 아크릴 배경 위에 부착하여 제작한 패시브 방식의 체커보드입니다.

마지막으로 실제 환경에서의 데이터 수집 편의성을 높이기 위해 소프트웨어를 오픈소스로 공개하였습니다. 비록 카메라 간의 완벽한 픽셀 정렬에는 여전히 숙제가 남아있지만, 이러한 셋업 과정 전체를 오픈소스로 푼 것은 열화상 도메인의 연구자들에게 유용한 레퍼런스가 될 것 같습니다. 하드웨어적으로 중요하게 설명드릴 부분은 여기까지이고 혹시 추가적으로 하드웨어 정보는 댓글이나 데모페이지에 들어가셔서 확인해주세용

Experiments

이제 본격적으로 제안된 AnyThermal 모델이 다운스트림 태스크에서 어떤 성능을 보여주는지 살펴보겠습니다. 저자들이 서론부터 내내 강조했던 일반화 성능이 실제로 입증되었는지를 확인하는 것이 이 파트의 핵심입니다.

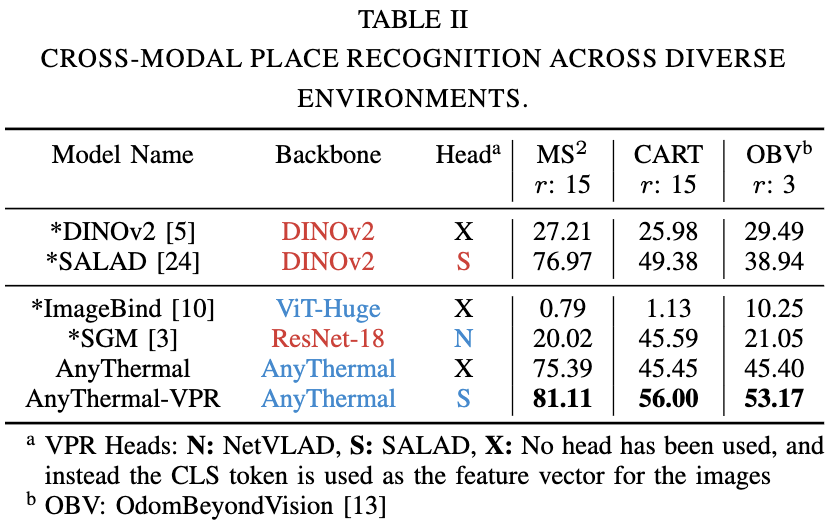

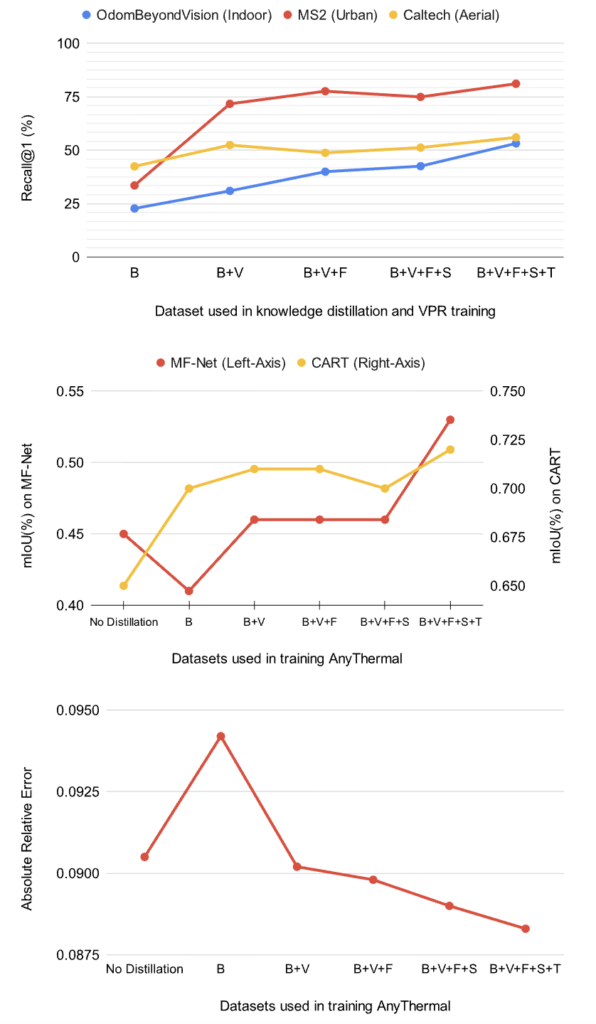

가장 먼저 VPR 결과입니다. 제가 이 테스크에 대해서는 잘 모르지만 저자들이 설명하는 것에 맞춰 작성하도록 하겠습니다. 우선 Zero-shot으로 3개의 데이터셋—MS2,CART(항공), OdomBeyondVision(실내)를 가져와서 평가를 진행했습니다. 결과적으로 AnyThermal-VPR은 세 가지 환경 모두에서 1위를 기록했습니다. 도심 환경에서는 81.11%, 항공과 실내 환경에서도 각각 56.00%, 53.17%의 Recall@1 수치를 달성했습니다. 각 실험은 헤드를 다르게해서 실험을 하였다고 합니다

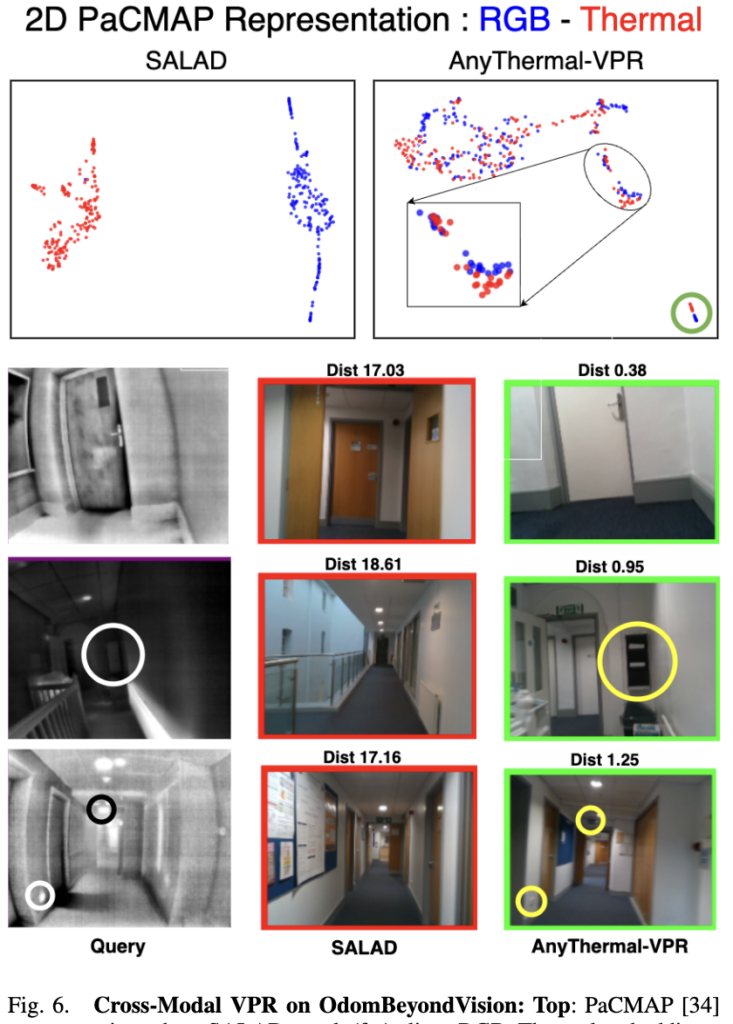

또한 VPR 정성적 평가 결과. 기존 SALAD가 RGB와 열화상 특징을 잘 묶지 못하는 반면, AnyThermal은 두 모달리티를 같은 공간에 잘 정렬함을 보여줍니다.

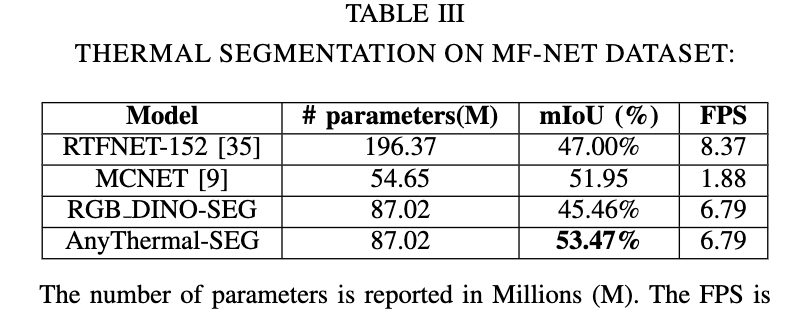

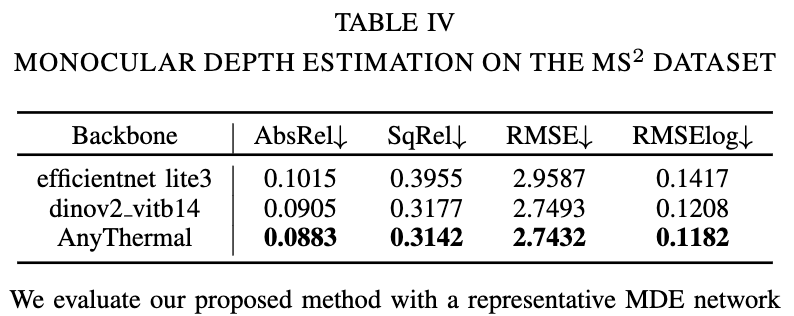

뿐만 아니라 Segmentation과 Monocular Depth Estimation 에서도 일관되게 나타납니다. MF-Net 데이터셋을 활용한 분할 태스크에서는 정확도(mIoU 53.47%) 면에서 SOTA를 달성했을 뿐만 아니라, 가장 근접한 성능을 내던 RGB 기반 segmentation 모델 대비 추론 속도가 3.6배(6.79 FPS)나 빠른 효율성을 보여주었습니다. 깊이 추정 태스크 역시, MS2 데이터셋에서 기존 RGB 백본(EfficientLite3)이나 가중치가 고정된 DINOv2를 그대로 가져다 썼을 때보다 확연히 낮은 오차율(AbsRel 0.0883)을 기록하며 열화상 도메인에 맞게 특징이 학습되었다고 합니다

마지막으로 조금 재밌는 실험이 있었는데요 Data Scaling에 따른 Ablation Study입니다. 저자들은 “과연 데이터를 무작정 많이 때려 넣는다고 지식 증류 성능이 계속 오를까?”라는 질문을 던집니다. 실험 결과, 기존의 도심(Urban) 환경 데이터를 계속 추가할 때는 성능이 어느 순간 정체되거나 오히려 항공 환경 평가 등에서 성능이 떨어지는 현상이 발생했습니다.

하지만 저자들이 직접 수집한 TartanRGBT 데이터셋을 학습에 추가하자 성능 향상이 되었다고 합니다. 이는 부족했던 환경적 다양성이 더해지면서 모든 태스크와 도메인에서 일관되게 성능이 향상하는 결과를 보여주었습니다. 요약하자면, 열화상 모델을 파운데이션 모델급으로 끌어올리기 위해서는 단순히 데이터의 ‘양’을 늘리는 것보다 환경적 다양성’을 확보하는 것이 훨씬 더 결정적인 역할을 한다는 객관적으로 보여주지 않았을까 생각이 듭니다. ‘T’가 저자들이 제안한 데이터셋입니다.

열화상 데이터셋 촬영을 예정하고있어 참고하기 좋았던 논문인것 같고 alignment 문제만 해결하면 패치 Level 뿐만아니라 픽셀레벨에서의 학습을 통해 성능향상 가능성이 있는 것 같습니다. 감사합니다

안녕하세요 우진님 좋은 리뷰 감사합니다.

제목만 봤을 때 이 논문이 thermal계의 다이노 representation learning 관한 내용이 주를 이룰 것 같았는데 뭔가 리뷰를 읽다 보니 dataset, platform논문 같다는 느낌도 들었습니다. 오히려 성능 향상의 핵심이 새 아키텍처라기보다는 좋은 RGB-T paired data를 다양한 환경에서 모은 것 에 더 가까워 보이는 것 같습니다. 그래서 아키텍쳐 쪽에서는 단순히 CLS token만으로 distillation 한거 같은데, 세그멘테이션이나 뎁스추정과 같은 dense한 task에서도 좋은 성능을 보인 이유가 궁금합니다.

안녕하세요 우진님, 리뷰 감사합니다.

설명해주신 내용을 보니 이 논문의 novelty는 모델 구조 자체보다는 다양한 RGB-T 데이터를 확보하는 과정과 distillation 방법 쪽에 더 있는 것처럼 느껴졌습니다. 우진님도 비슷하게 보셨는지, 그리고 실제로 이런 방식으로 데이터셋을 구축하고 학습까지 해보실 생각이 있으신지 궁금합니다.

또 이 방법은 RGB semantic space에 thermal representation을 정렬하는 느낌도 드는데, 열화상만의 modality-specific한 표현이 있다고 보시는지도 궁금합니다. 만약 있다면 그런 표현까지 함께 학습하는 방향도 가능할지 궁금합니다. 그리고 alignment 문제가 더 해결된다면 CLS 토큰 수준이 아니라 patch-level이나 pixel-level로 더 직접적인 학습도 가능할 것 같은데, 이 부분에 대해서도 우진님 생각이 궁금합니다.

우진님 좋은 리뷰 감사합니다.

Teacher인 RGB의 CLS 토큰과 Student인 Thermal의 CLS 토큰을 이용하여 contrastive loss로 학습한다고 하셨는데, 해당 논문이 segmentation과 같은 dense prediction을 수행하기 위해서는 패치 단위로 loss를 계산하는 것 이 좋지 않을까 하는 생각이 듭니다. 이에 대해 저자들이 혹시 따로 실험을 진행하거나 근거로 삼는 논문이 있는 지 궁금합니다.

또한, Data Scaling에 따른 Ablation Study 결과를 보면, 마지막에 저자들이 제안하는 데이터 T를 포함한 것으로 보이는데, 저자들이 자신들이 수집한 데이터가 다양한 환경에서 수집 되었다고 표현하였는데, T만을 이용한 실험 결과는 따로 없었는 지 궁금합니다. 또한, 데이터가 추가되는 순서가 B→V→F→S→T 로 정해진 이유가 따로 있을까요?