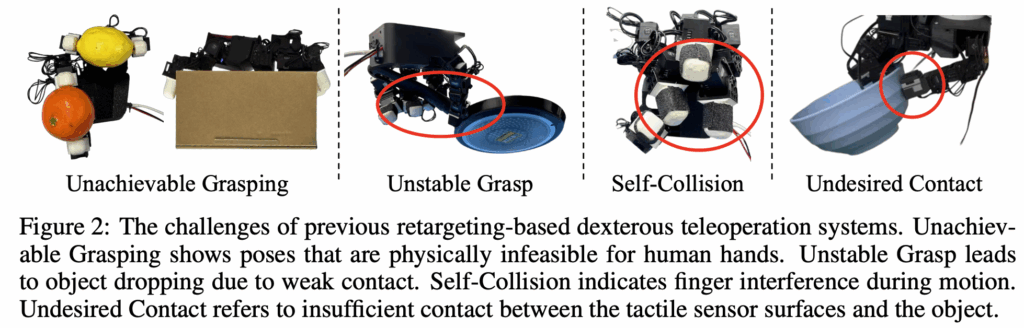

안녕하세요 최인하입니다. 이번에 리뷰할 논문은 Teleopration 논문입니다. 로봇 domain에서 learning based 방식의 발전과 large-scale의 robot datasets의 등장으로 현재 로봇은 다양한 task를 수행할 수 있게 되었는데요 Teleoperation은 real world의 robot demonstration data를 효율적으로 모을 수 있는 방식으로 많이 사용되고 있습니다. 하지만 기존의 방식들은 몇가지 문제점이 있습니다. 제가 예전에 리뷰한 AnyTeleop 같은 경우에는 vision-based 방식으로 하드웨어에 일반화 성능이 있다는 장점이 있지만, human hand wrist를 기준으로 각 관절의 keypoint 간 상대 벡터를 사용하여 Teleoperation을 수행합니다. 하지만 이러한 점은 robot hand가 커버할 수 있는 즉 인간의 손보다 dexterity한 부분을 사용하지 못하게됩니다. 또한 human hand의 상대 벡터를 사용하기 때문에 embodiment gap이 존재하여 collision 등이 발생할 수 있다는 단점이 존재합니다.

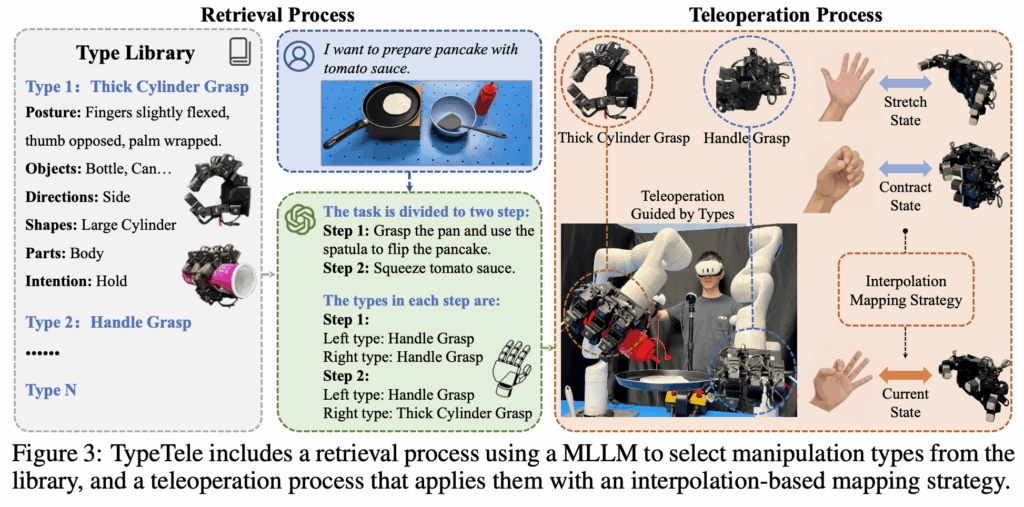

저자는 이 두 문제를 해결하기 위해서 Type-guided dexterous teleoperation system을 제안합니다. 간략하게 말해보면 우선 전반적인 manipulation task에 필요한 동작들을 분류하여 dexterous manipulation type library를 만듭니다. 이 library를 기반으로하여 2-stage를 수행하는데, 첫번째로 type retrieval stage입니다. 이 stage에서는 MLLM을 사용하여 현재 task에 맞는 적절한 manipulation type을 찾습니다. 그 후 두번째 stage인 action stage에서 human hand action을 specific dexterous manipulation type과 interpolation mapping합니다.

논문을 읽으면서 다양한 task의 library를 만드는 과정과 손 안에서 dexterity한 작업을 못한다는 점이 단점이라고 생각했습니다. 하지만 저자는 이 방법론으로 기존 방법론들에 비해서 SR이 높아졌고,더욱 효율적으로 데이터를 모을 수 있으며, data의 quality까지 챙겼다고 하네요. 이제는 자세하게 설명해보겠습니다.

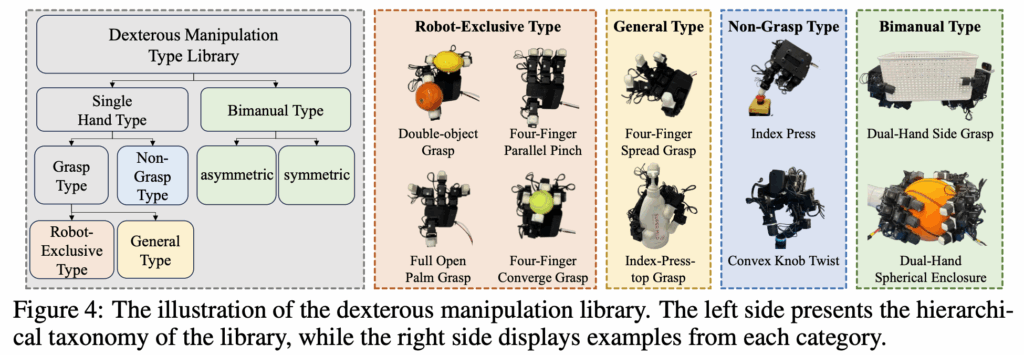

Dexterous Manipulation Type Library

위에 보이는 그림이 Dexterous Manipulation Type Library의 그림입니다. 다양한 dexterous한 pose를 hardware specific하게 계층적 구조로 분류했습니다. single hand typer과 bimanual 을 구분지어 나누었는데요, 특히 single에서는 grasp와 non grasp로 또 나누어 grasp와 우리가 물체와 상호작용하는 방식을 동시에 표현했다고 합니다. bimanual type은 대칭과 비대칭으로 구분했다고 합니다.

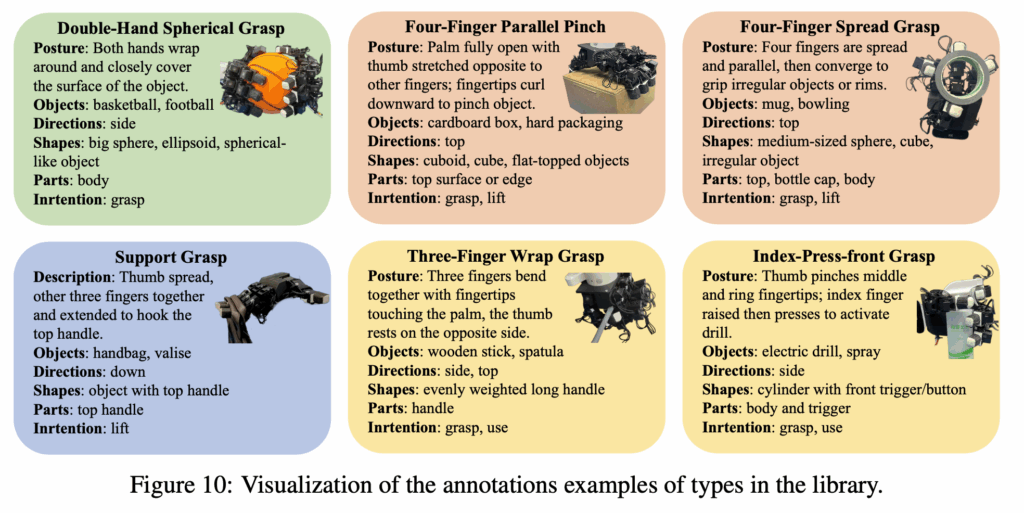

library를 들여다 보면 위의 그림과 같습니다. 각각의 dexterous type에는 stretching and contracting postures에 대한 annotation이 주어지며, object centric한 정보와 posture-centric한 정보가 주어지므로 type retrieval을 수행할때 해당 posture가 구체적으로 어떤 형태를 가지는지 또한 어떤 종류의 task와 object를 다루는데 적합한지를 알 수 있다고 합니다.

MLLM-assisted Type Retrieval

이제 주어진 task에 가장 적합한 manipulation method를 선택하는 MLLM 기반 type retrieval을 수행합니다. library의 정보가 GPT 같은 MLLM에 prompt로 입력된 후 MLLM에게 two sub-questions를 prompt로 입력해주는데요 다음과 같습니다.

- How many steps are required to complete the task?

- Which type of manipulation should be assigned to each hand per step?

이를 통해 위의 그림처럼 MLLM이 여러단계 task를 쪼개고, 각 단계에서 어떤 object가 관련이 있는지 추론하며, 어떤 상호작용 방식을 통해 조작해야 하는지 guide합니다. 각각의 손마다 어떤 library의 type을 선택하는 것이 유리한지 정하는거죠. 프로젝트 페이지의 영상을 보면 수행해야 될 task가 바뀔 때 마다 robot hand의 grasp pose가 슉슉 바뀝니다.

이렇게 task가 바뀔 때마다 finger tip의 6-DOF, 변환값 T를 가지고 robot hand의 관절 값은 IK를 통해서 계산되며 posture가 바뀌게 됩니다.

Interpolation Mapping Strategy

이 부분은 사람 손과 로봇 손의 mapping 과정이라고 보시면 될 것 같습니다.

TypeTele 논문에서는 인간 손과 로봇 손의 관계를 비율적으로 mapping합니다. 우선 위의 식은 인간 손의 stretch와 contract간 비율을 0~1 사이로 나타낸 비율입니다. 이때 P는 3차원 벡터로 표현됩니다. (p(ratio)는 0~1 비율)

그 후 로봇 손의 관절 값들을 이 비율로 같이 맞춰주는 과정을 통해서 인간 손과 로봇 손의 mapping이 완료됩니다.

Experiment

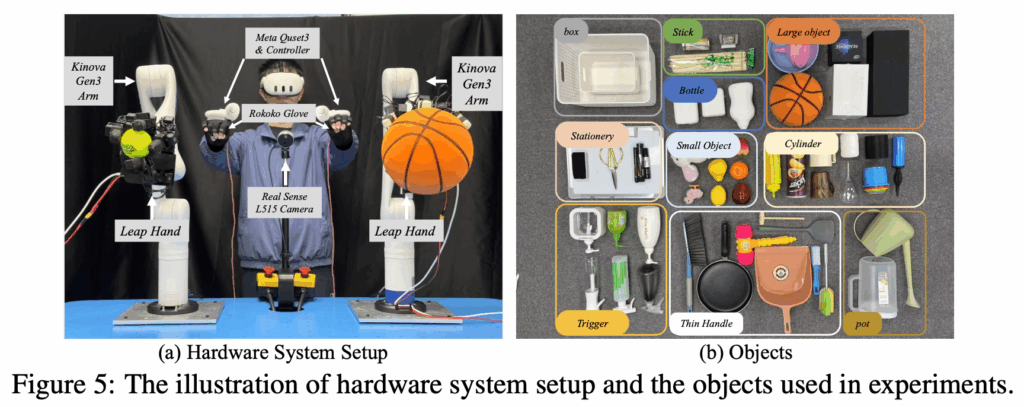

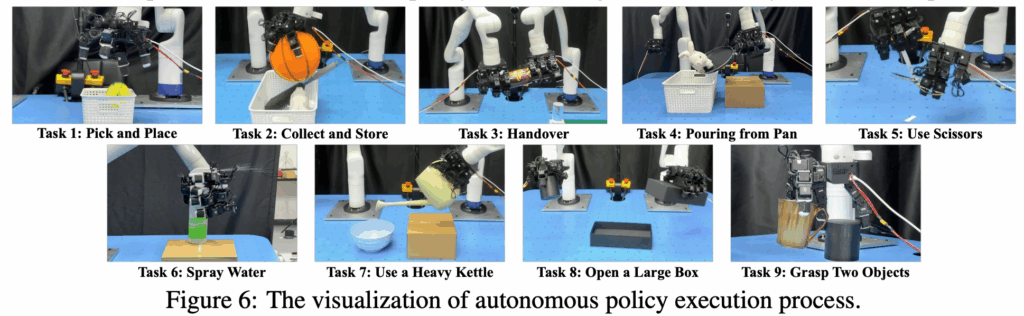

실험 환경은 위의 사진과 같습니다.

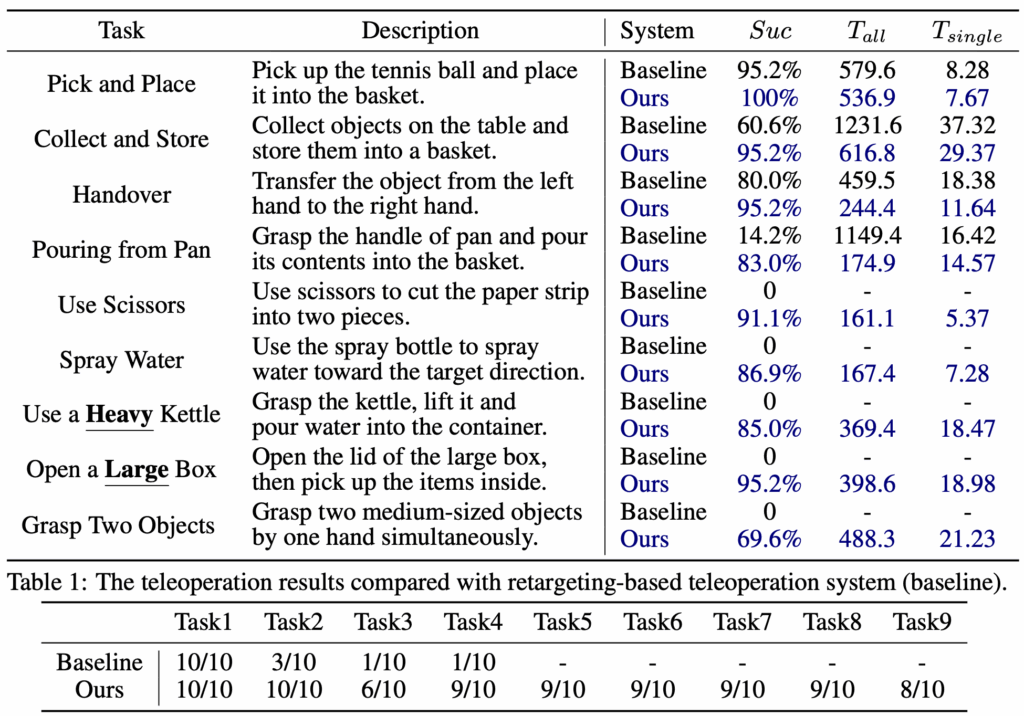

기존 retargeting을 이용한 방식에 비해서 논문에서 제시하는 type-guide 방식의 성공률이 높은 것을 확인할 수 있습니다. 어찌보면 그 task를 수행하기 위해서 annotation 된 hand posture를 통해서 진행하므로, 당연한 결과라고 생각합니다. 하지만 library Type에 없는 posture를 요구하게 되면 task 성공률이 매우 떨어지겠죠. 또한 논문에서는 모은 데이터로 policy를 학습시켰을 때 기존 방식들에 비해서 높은 성공률을 보이므로 Data의 quality 또한 기존 방식들에 비해서 높다고 주장합니다.

사진이 올라가지 않아서 올리지는 못했지만 형태가 비슷한 object나 various dexterous robotic hands에도 잘 적용이 되는 모습을 볼 수 있었습니다. 또한 view 상에서 task에 필요없는 다양하고 복잡한 객체가 있는 다중 객체 상황에서도 30회 중 27회 적합한 최적의 manipulation type이 선정되었고, 나머지 3회도 최적의 type은 아니지만 실행 가능한 type이 선정되었다고 하네요.

기존의 retargeting 방식의 Dex Teleoperation 방식이 아닌 어찌보면 Task에 맞게 annotation 된 posture를 사용하면서 인간으로는 할 수 없는 robot의 posture를 사용할 수 있고, embodiment gap도 해소한 논문이었습니다. 감사합니다.

안녕하세요 인하님 리뷰 감사합니다.

Retargeting 방식이 아닌 teleoperation system을 제안한 연구가 맞나요? 맞다면 retargeting 없이 어떻게 teleoperation이 가능한지 이해를 못 해서 혹시 설명을 부탁드려도 될까요? 저장된 다양한 grasp중 일부를 가져오는건지.. annotation과 retrieval 대상이 정확히 무엇인지도 궁금합니다!

안녕하세요 인하님 리뷰 감사합니다.

Task의 단계가 바뀔 때마다 MLLM이 개입하여 적절한 타입을 결정해야 하는거 같은데 맞나요..? 이해하기가 좀 어려웠어서 ㅠ

혹시 이 과정에서 발생하는 시간 때문에 Teleoperation의 흐름이 끊긴다거나 멈추거나하는 현상이 발생하지않을까요 ?

안녕하세요, 인하님. 좋은 리뷰 감사합니다.

URP 주간에 비슷한 질문을 드린 적이 있었는데, TypeTele 역시 human hand motion을 기반으로 robot hand를 제어하는 teleoperation 구조로 이해했습니다. 그렇다면 여전히 manipulation이 물체나 task에 맞춰 동작하기보다는 human motion을 기준으로 수행되는 방식이라고 볼 수 있을까요?

이러한 접근이라면 인간 손의 움직임을 기준으로 매핑되는 구조이기 때문에, 로봇이 가진 고유한 자유도나 인간과 다른 관절 범위를 충분히 활용하기 어려운 한계는 없는지 궁금합니다.

리뷰 감사합니다🖐️

안녕하세요 인하님 좋은 리뷰 감사합니다. 궁금한 부분이 있어서 남겨놓습니다.

Q1. MLLM이 task를 쪼개고, 각 task마다 library 속 manipulation type을 선택하는 것으로 이해했습니다. MLLM이 task를 쪼개는 기준과 task마다 type을 선택하는 기준이 궁금한데, 이 과정이 전적으로 prompt에 의존하는 것인가요? 맞다면 prompt가 바뀌었을 때 결과가 달라질 수 있지 않을까 싶은데 언급이 있었는지 궁금합니다.

Q2. 사람 손과 로봇 손을 매핑하는 과정에서 P가 3차원 벡터로 표현된다고 했는데, p_ratio는 손가락마다 계산하는 값인가요? 아니면 관절과 관절 사이마다 계산하나요? 손 전체 비율이라면 사람도 손가락마다 길이가 다르고 손바닥 크기도 다른데 비율 값 하나로 어떻게 매핑이 되는지 궁금합니다.

감사합니다.