Intro

해당 논문은 Retrieval을 기반으로한 locailzation 방법을 제안했으며, 성능과 속도면에서 SOTA를 달성했던 논문입니다. 사람이 자신이 위치한 곳을 인식하기 위해서 이전에 방문한 곳을 기억하고 세부적인 것을 매칭 시킴으로써 인식한 것과 동일한 방식을 사용했습니다. 논문에서는 이러한 방법을 hierarchical manner라고 칭합니다.

또한 original Netvald의 연산량을 줄이기위해 original Netvald로부터 knowledge distillation을 한 mobileNetvald를 이용했으며, 2D-3D matching에서 속도와 성을 향상시키기 위해 camera pose가 aliasing되도록 clustering하여 3D 포인트를 줄이는 방법을 이용했습니다.

추가적으로 논문은 localization pipeline을 평가하기 위해서 Zurich dataset을 제작하여 평가 하였습니다.

Hierarchical Localization Method

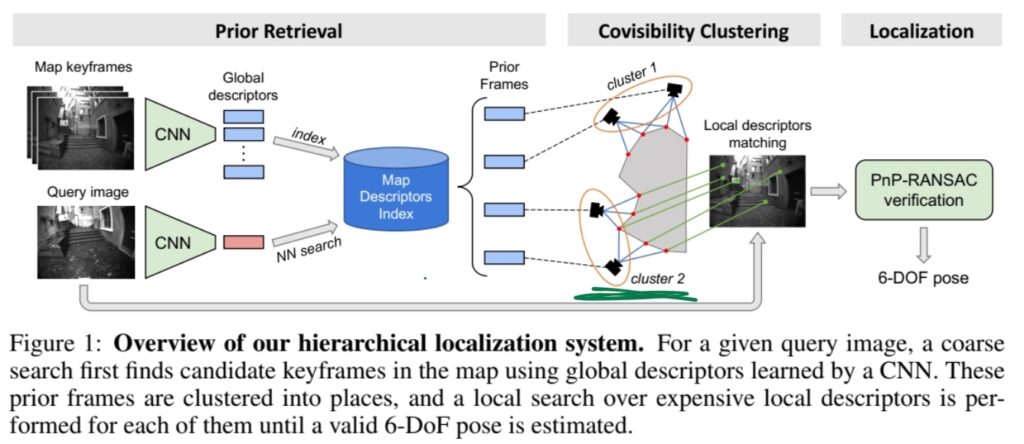

전체적인 pipeline은 1. Map의 keyframes을 global descriptor로 추출한 index와 query로부터 추출된 global descriptor를 얻습니다. 2. query를 index로부터 Nearest neighbor searsh를 진행하여 prior frame(top k)을 구합니다. 3. prior frame을 bipartite graph를 통해 가시적으로 유사한 공간을 보는 영상끼리 클러스터링을 진행합니다. 4. 방법 3으로부터 얻은 clue에 local matching과 PnP를 수행하여 6-DOF를 얻습니다. 설명드린 내용은 Figure 1.를 통해 도식화된 pipeline을 확인 할 수 있습니다.

Prior retrieval

해당 세션은 Retrieval을 진행하기 위한 global descriptor로 채택된 mobileNetVLAD를 소개합니다. query를 index로부터 retrieval하기 위해서 Nearest neighbor를 사용했습니다.

리뷰 중인 눈문에서는 속도와 성능 향상을 위해서 기존 NetVLAD의 백본인 VGG16보다 좋은 성능과 낮은 연산량을 가진 MobileNET을 백본으로 사용했습니다. 추가적인 특징은 아래와 같습니다.

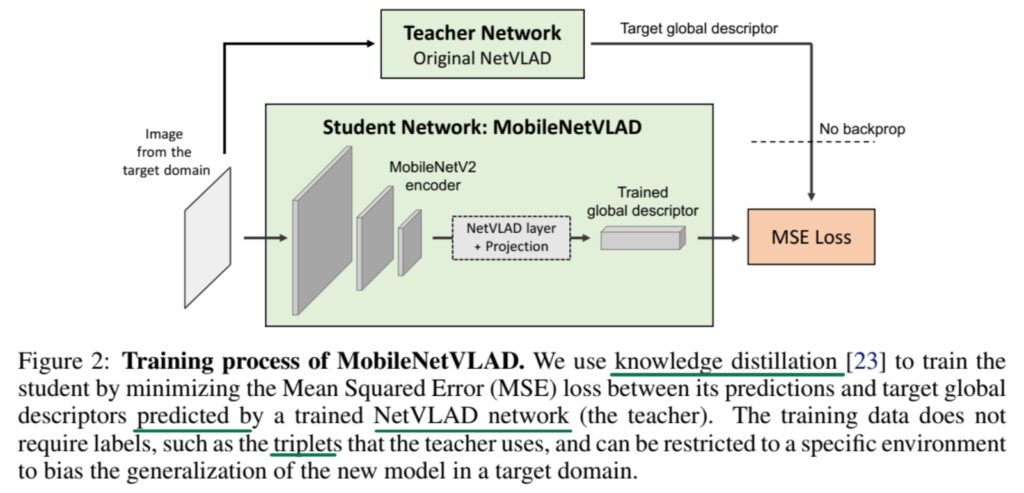

- 학습의 효율과 성능 향상을 위해서 pre-trained NetVLAD를 knowledge distillation을 사용하여 MobileNetVLAD를 학습했습니다. (Figure 2)

- MobileNet은 imageNet으로 pre-train 하였습니다.

- MobileNet의 마지막에서 두 번째 layer를 VLAD layer로 변경하였습니다.

- Retrieval 시, global descriptor를 PCA + L2 norm을 진행 후, nn search를 통해 prior frame(top k)를 선별했습니다.

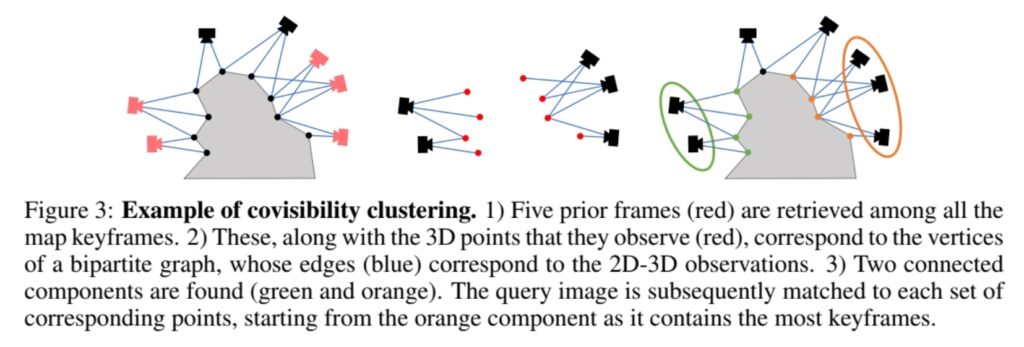

Covisbility Clustering

Covisbility clustering을 통해 같은 공간을 보는 top k를 선별, 군집화함으로써 3D point의 수 감소, noise한 point를 계산하지 않음으로써 효율적인 연산과 속도 향상을 이끌었습니다. 세부적인 방법은 아래와 같습니다.

- top k들로부터 2D-3D를 구하며, bipartite graph를 구성합니다.

- graph를 토대로 clustering을 진행합니다.

- query와 cluster간 매칭시, 한장의 영상이라도 매칭이 된다면 해당 cluster를 연산에 사용합니다.

Local matching and Localization

기존 존재하던 localization 방법들은 task에 적절한 속도를 보장하기 위해서 binary local feature를 사용했습니다. 하지만 binary local feature는 환경 변화와 반복적인scene에는 강인하지 못한 특징을 가지고 있습니다. 그렇기에 해당 논문에서는 MobileNetVLAD(이하 MVN)와 Covisbility Clustering 통해 속도 향상을 이뤄 SIFT와 같은 non-binary local feature를 통해 연산을 해도 속도를 보장하였습니다. SIFT를 통해 Local matching을 수행 후, PnP를 통해 6-DOF를 구하였습니다. 구체적인 내용은 아래와 같습니다.

- 사용된 local feature는 SIFT, matching 시 사용된 알고리즘은 kd-tree를 사용했습니다.

- 사용된 PnP는 P3P-RANSAC을 통해 6-DOF를 추정하였습니다.

Evalution

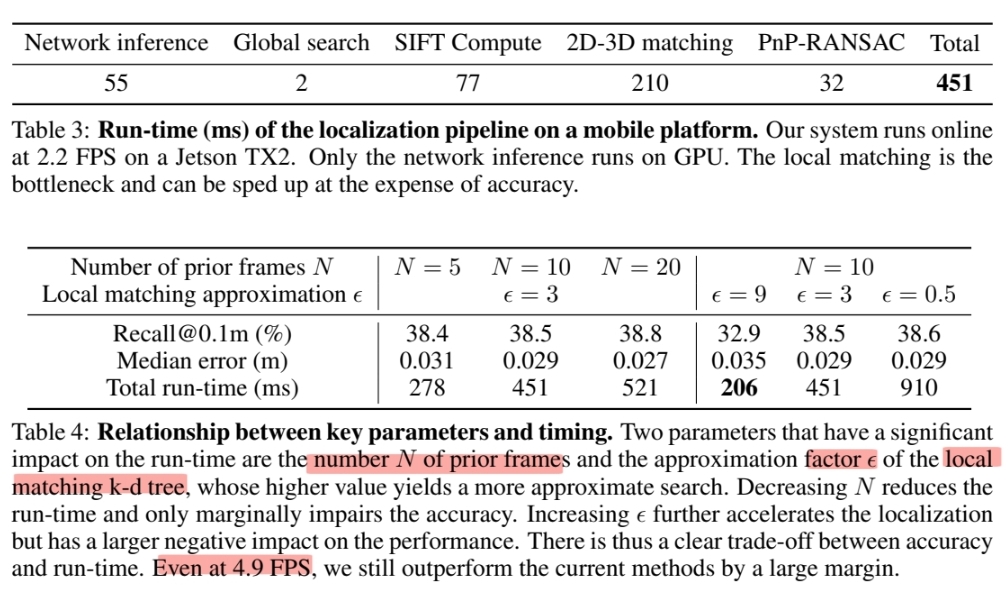

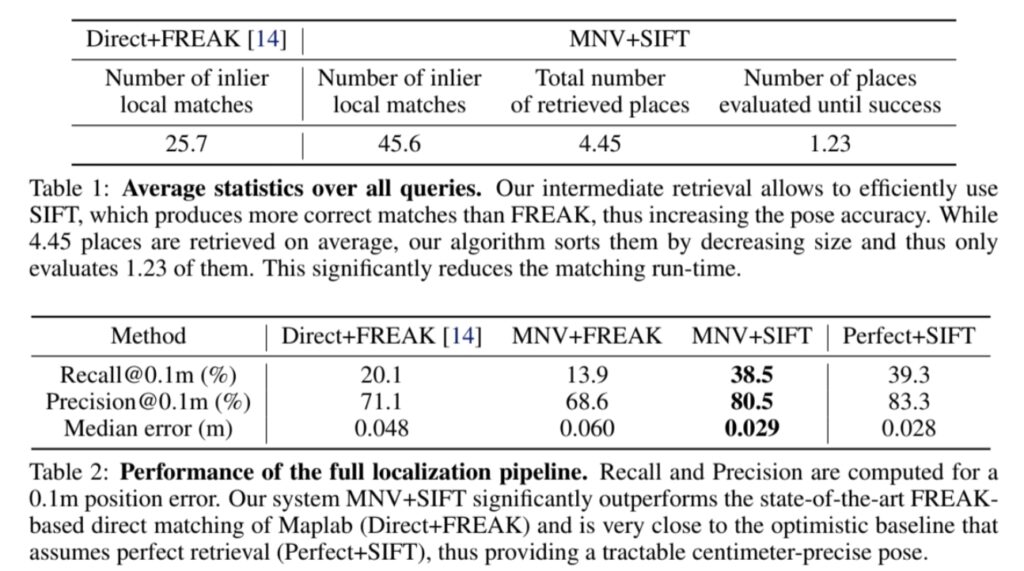

평가는 Jetson Tx-2에서 진행하였으며 2.2FPS의 속도를 보였습니다. 전체적인 pipeline의 평가는 자체적으로 제작한 Zurich dataset으로 평가하였습니다.

Conclusion

해당 논문은 수직적인 방법으로 속도와 성능 향상을 얻었습니다. 하지만 논문에서 말하길 retrieval 에서의 개선을 통해 전체적인 localization 성능 향상보다는 local feature를 이용한 방법들에 의존적인 성능 향상을 보였다고 합니다. 현재 진행 중인 챌린지에서 사용 중인 retrieval과 유사한 방법이기에 성능 향상을 위해서 local feature level에서의 개선에도 관심과 공부를 해야한다는 교훈을 얻었습니다. 또한 논문에서 후속 연구로 learnable local feature와 learnable retrieval을 결합한 방법을 진행한다고 하였습니다. 그렇기에 이어서 후속 논문인 ‘From Coarse to Fine: Robust Hierarchical Localization at Large Scale’을 리뷰하여 목표로 둔 딥러닝 기반의 localization에 다가가도록 하겠습니다.

엣지 기반으로 이미지 localization을 하기 위한 연구로 이해했습니다.

1. 그림 1의 네트워크를 보면 입력으로 이미지만 들어가는 것으로 보입니다만 내용을 읽어보면 3D 데이터에 대한 이야기를 하고 있습니다. 3D 데이터도 따로 입력되는 건가요? 아니면 prior retrieval에서 파생되는 데이터를 뜻하는 건가요?

2. MNV을 제안하는 부분에서 MobileNet의 출력을 NetVLAD layer + Projection으로 표현된 부분이 글에서 언급한 VLAD layer로 변경한 것을 뜻하는 건가요?

3. 글에서는 지식 증류(knowledge distillation)을 사용했다고 언급했는데 (그림 2의 윗부분) 정확히 어떤 역활을 하는건가요?

4. Covisibility clustering에 대해서는 그림 3을 보고 이해할 수 있었습니다. top K는 실험으로 정했을 것 같네요. bipartite graph를 처음 들어봐서 간략하게 설명해주시면 좋을 것 같습니다.

5. clustering은 어떤 방법으로 실행하나요?

6. 이 논문의 실험 비교는 다른 선행 연구와의 비교는 없었나요?

(-) MobilNetVLAD(이하 MNV)라고 줄여서 표현하겠다는 부분이 제일 먼저 언급된 부분에 있었으면 합니다.

좋은 리뷰 감사합니다.

제가 모바일 넷에 대하여 잘 몰라서 그러는데, 해당 리뷰에서

“리뷰 중인 눈문에서는 속도와 성능 향상을 위해서 기존 NetVLAD의 백본인 VGG16보다 좋은 성능과 낮은 연산량을 가진 MobileNET을 백본으로 사용했습니다.”

라고 말씀하신 부분이 살짝 와닿지가 않습니다. 모바일넷이 파라미터 수를 줄여서 보다 가볍고 속도 향상이 빠르다는 것은 쉽게 이해가 가능한데, 속도 뿐만 아니라 성능면에서도 VGG16보다 좋다는 것에 대해서 설명해주실 수 있으실까요?