이미지 하나로부터 깊이영상(Depth)를 추정하는 연구인 Monocular Depth estimation 은 RGB를 베이스로 굉장히 발전되어왔습니다. 하지만 RGB는 illumination에 약하는 단점 때문에 열화상 영상을 활용한 깊이 추정들이 아주 조금씩 나오고 있습니다. 이 논문은 그 논문들 중 비교적 최근 나온 논문으로 열화상 영상의 제약 조건들을 해결하기 위한 여러 대안책들을 제안하고 있습니다.

기존 Monocular depth estimation은 RGB영상 두장(왼쪽 , 오른쪽)을 가지고 Task를 진행하며 정답 라벨로 두 영상의 Disparity를 사용합니다. 이러한 상황에서 RGB 카메라대신 열화상 카메라를 사용하는 데 있어서 여러 문제가 있습니다. 그중 하나로는 Resolution이 크면서 보다 Sensitive 한 영상을 얻을 수 있는 열화상 카메라는 RGB 카메라 두대에 비해 매우 비쌉니다. 이러한 문제 때문에 본 논문에서는 열화상 이미지 두개를 사용해 Monocular depth estimation을 하지 않고 열화상 영상하나와 RGB 영상 두개를 가지고 Task를 진행했다고 합니다.

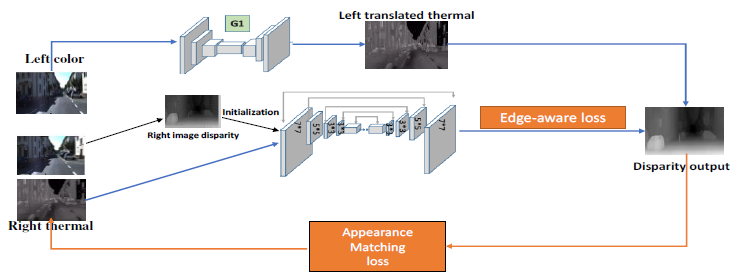

RGB 영상 두개 (Left, Right)와 열화상 영상 한 개 ( Right)를 가지고 Depth Estimation을 하는 과정은 다음과 같다( 그림 1과 동일 ).

- Disparity를 Initialization하기 위해서 RGB Right로 부터 disparity를 구한다.

- Left RGB를 image translation 방법론을 이용해 Left translated Thermal로 변환한다.

- Left translated Thermal를 이용해 initialized disparity를 refine 한다.

1 Thermal Image Disparity initialization

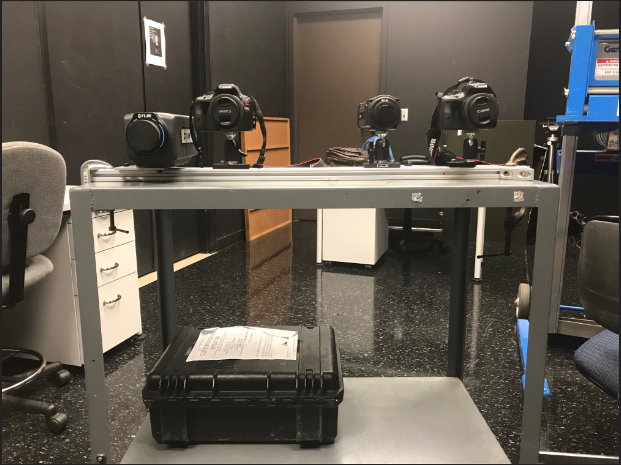

그림 1 에서와 같이 Right RGB에서 구한 Disparity를 Thermal 의 Disparity로 initialize하기 위해서는 Thermal 와 RGB가 굉장히 유사하게 촬용되어야 한다. 따라서 이 논문에서는 그것을 위해 데이터셋을 촬영했다고 한다.

그림 2는 데이터셋에 촬영에 사용된 셋팅이며 오른쪽 열화상 카메라와 RGB를 최대한 붙혔다고 한다. (흠…. 이게 붙힌게 맞는지… 이걸 셋팅이 굉장히 무척 마음에 안드는데 이걸로 무슨 촬영을 했는지 일단 엄청난 의문!!!!!!!!!! 그리고 보면 열화상 카메라도 두개가 다른거 같은데 그것에 대한 언급이 없음)

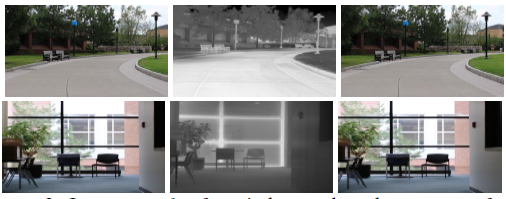

(그림 3은 촬영 된 영상의 Example인데 딱봐도 그림 2에서 본 것 처럼 RGB와 Thermal의 높이 차이가 나는게 촬영된 영상에서도 보이는 것을 볼 수 있다. )

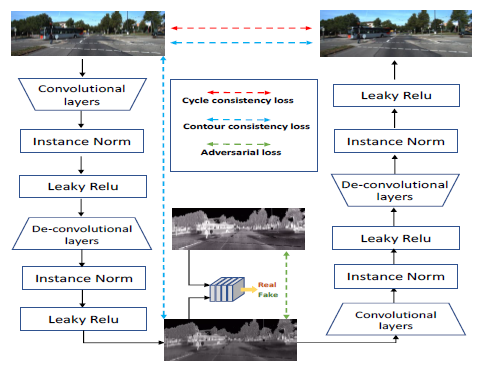

2. Image Translation from Color to Thermal

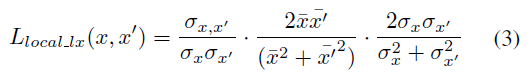

RGB에서 Thermal 영상을 얻기 위한 Translation 방법론으로 이 논문은 CycleGAN을 베이스로 했다고 한다. 다른 Loss는 기존 CycleGAN과 동일하고 하나의 Loss가 RGB 2 Thermal를 위해 추가 되었다. 그 Loss는 다음과 같다.

생성된 열화상 영상과 실제 열화상 영상의 Correlation을 고려하고 평균적인 illumination을 닮도록 Loss를 설계했다고 한다. 총 세개가 고려 됐으며 각각은 다음과 같다. 첫번째 식은 두 영상의 Correlation, 두번째 식은 두 영상의 Variation을 고려해 illumination을 고려, 세번쨰는 유사한 Distribution을 나타내도록 고려. 이 식을 5×5 patch로 2 stride씩 옮겨가며 적용해서 local 한 부분을 Translated Thermal 가 닮을 수 있도록 했다고 한다.

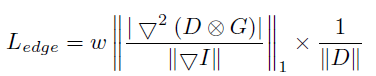

3. Neural Network Structure for Single Thermal Image Depth Estimation

Depth Estimation Model은 Monodepth1 과 동일하며 Loss 하나빼고 동일하다고한다. 추가된 Loss는 Edge-aware Smoothness Loss로 texture정보가 적거나 Occlude 된 부분에서 분산이 작아지는 것을 방지 하고자 추가했다고 하며 식은 다음과 같다. D=Disparity map , I= input image

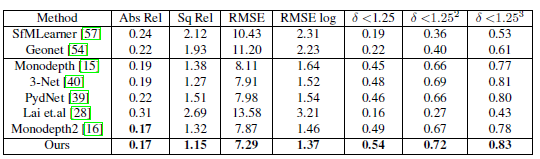

Results

촬영한 데이터셋에서 기존 방법론과 성능을 비교했을떄 가장 성능이 좋다고 한다. 나머지 방법론들을 학습시키기 위해서 Thermal (Right)와 Translated Thermal(Left)를 사용했다고 한다.

이 외에도 정성적 결과와 Translate 의 정량적결과가가 첨부 되어 있으나 동일하게 가장 성능이 좋음을 나타내서 추가하지 않았다.

정량적 평가 부분에 대한 설명에 대해 궁금한 점이 있습니다.

각 방법론의 GT는 Right image disparity를 사용했을까요??

아님 right T-translate T의 disparity를 사용했을까요?

위의 두 방법은 모두 T의 위치에서 추론된 값이 아니기 때문에 애매한 케이스 같은데, 어떻게 공평하도록 실험 세팅을 했는지 궁금합니다.