안녕하세요. 이번에 소개드릴 논문도 UC 버클리 Sergey Levine 교수님 연구실에서 2022년에 발표한 ViKiNG: Vision-Based Navigation with Kilometers-Scale Generalization이라는 논문입니다. 어쩌다보니 리뷰를 해당 연구실에서 낸 논문만 리뷰하게 되네요. ViNT나 NoMaD 에서 ViKiNG이라는 논문에 대한 내용을 많이 언급하였고 그리고 해당 방식을 차용해서 적용한 부분이 많아서 이 참에 조금 더 깊게 이해해볼 겸 읽어보고 리뷰로 들고오게되었습니다.

바로 리뷰 시작하도록 하겠습니다.

Introduction

마찬가지로 해당 연구는 기존에 리뷰했던 ViNT나 GNM 계열의 시각 기반 내비게이션 연구 이면서, 메트릭 지도 없이 순수 RGB 기반이면서 특히 수 킬로미터(km) 이상의 장거리 navigation을 수행할 수 있는 연구입니다.

저자는 메트릭 정보 없이 네비게이션을 수행하는 연구를 하지만 long horizon task를 수행하는데 있어서 완전히 geometric한 정보 없이는 힘들다고 언급합니다. 조금 큰 규모의 navigation 문제는 결국 전체적인 지형 구조가 어떻게 생겼는가?에 대한 힌트가 있어야 하는데, ViKiNG에서는 이 부분을 정확한 SLAM map 대신 지리적 힌트(geographic hints)로 대체합니다. 예를 들면 로드맵 정보라던지, GPS, 위성 이미지 등을 사용하게 되는데, 이것들을 방향성이 있는 힌트로서 단순히 어떤 스코어를 산출하는데 사용되고 실제 세부적인 이동 결정은 전적으로 카메라에서 읽은 egocentric observation기반으로 실행한다고 보시면 됩닌다. 어찌되었든 메인은 카메라에서 읽은 현재 관찰정보 만으로 네비게이션을 수행하지만 조금 장거리 이동을 위해서 저런 지리적 힌트를 사용하겠다라고 이해하시면 좋을 것 같습니다.

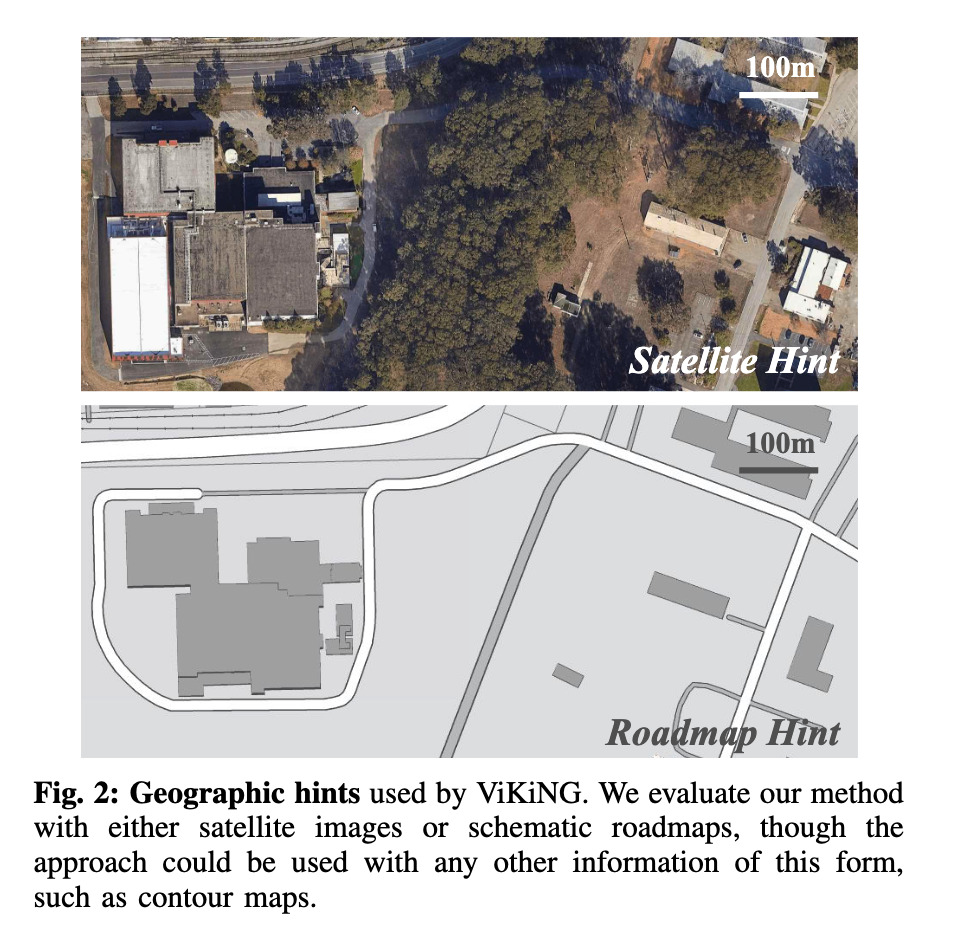

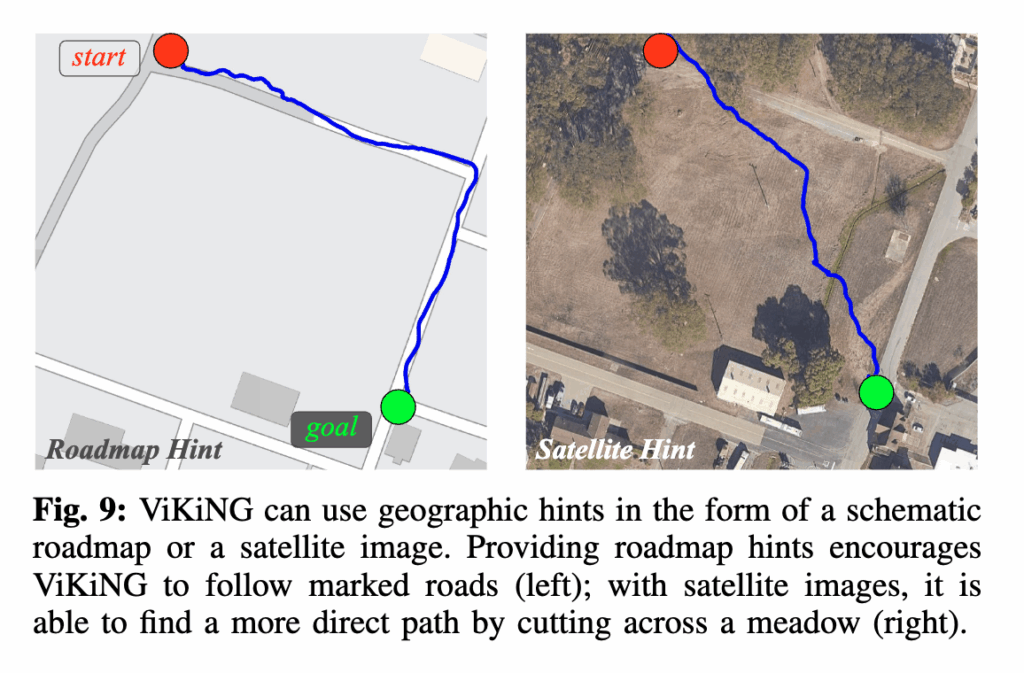

지리적 힌트는 아래 피규어에 나타난 위성지도와 로드맵처럼 이미지로 주어지게 됩니다.

사람같은 경우도 local 하게는 어떤 지도 정보 없이 잘 이동할 수 있지만 조금이라도 스케일이 커지면 지도의 힘을 빌리긴 해야하지만서도 그 지도 퀄리티가 그렇게 중요하지 않은, 예를 들어 사람이 종이에 그린 대충의 동네 지도를 들고도 길을 찾을 수 있는 것과 같은 느낌이라고 보시면 될 것 같습니다.

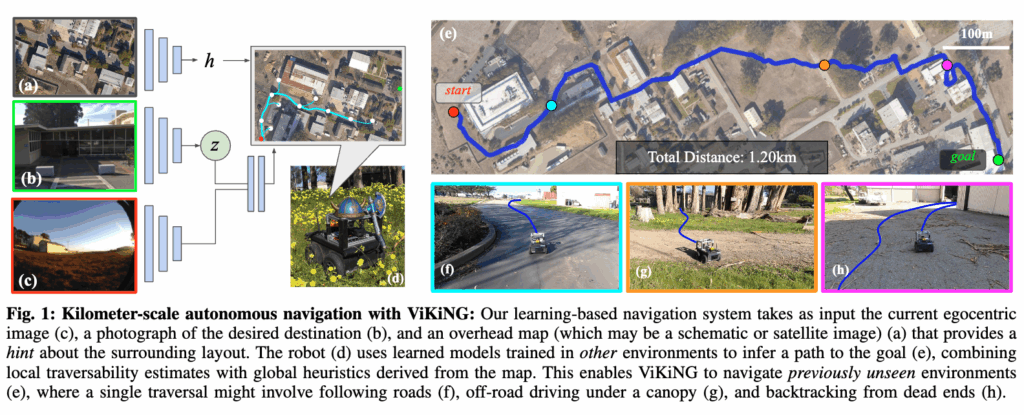

실제로 ViKiNG알고리즘은 42시간의 분량의 주행 데이터로 학습되었고 학습데이터에서 80m 보다 긴 이동 경로를 본적이 없음에도 불구하고 해당 알고리즘은 지리적 힌트 정보를 통해서 2km 이상 떨이진 목표지점을 잘 찾아가는 모습을 보였다고 합니다. 아래 (a)가 위성지도를 지리적 힌트로써 모델의 입력으로 들어가고 (b)목표지점 (c)내가 현재 보고있는 관찰 상태를 통해서 모델이 어떻게 네비게이션을 수행할지 예측하는 구조라고 보시면 됩니다.

해당 방식의 큰 틀에서의 동작 방식은 아래와 같습니다.

1)고수준(high-level) 경로 계획은 위성 지도나 로드맵 등에서 추출한 heuristic을 기반으로 어떤 subgoal이 목표 방향에 유리한지를 판단하면서 2) 저수준(low-level) 행동은 현재 시점 카메라 이미지와, latent space에서 샘플링한 subgoal을 기반으로 지금 시점에서 어디로 가야 하는지를 학습된 모델이 직접 판단하면서 네비게이션을 수행하게 됩니다.

기존 리뷰했던 논문들과 큰차이는 없지만 subgoal 생성하는 방식과 같은 세부적인 내용에서는 조금 차이가 있는데 해당 내용은 method에서 자세하게 다루도록 하겠습니다.

다음은 Method 부분에서 ViKiNG-A*, latent goal model, heuristic 학습 구조를 중심으로 이어서 설명드리도록 하겠습니다.

Method (Visual Navigation with Geographic Hints)

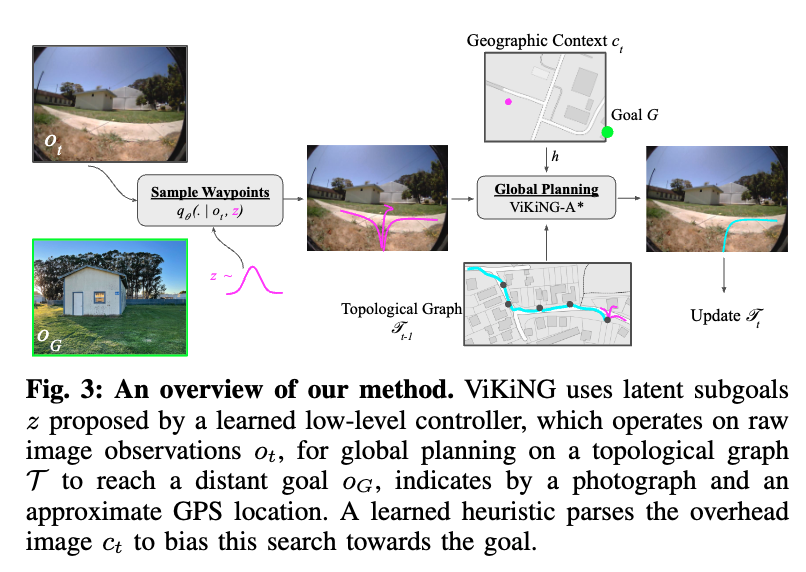

앞에서 소개한 것처럼 ViKiNG의 전체 구조는 지도 없이 RGB 관찰만으로 이동하되, 위성 지도 혹은 로드맵 같은 지리적 힌트를 heuristic으로 활용한다라는 철학을 기반으로 하는데, 실제로 해당 모델이 어떻게 동작하는지 ViKiNG의 핵심 구성요소들에 대해서 하나씩 살펴보도록 하겠습니다.

A. Low-level Control with a Latent Goal Model

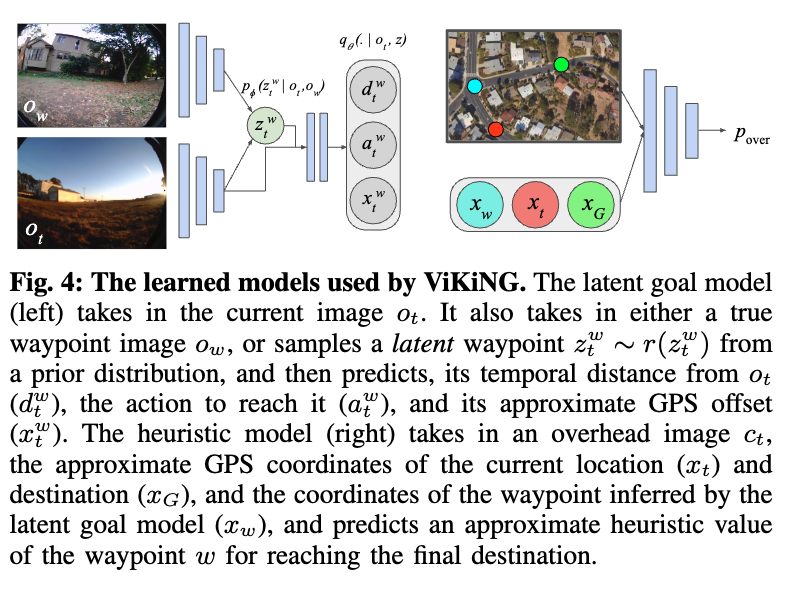

ViKiNG의 Method에서 가장 먼저 소개되는 구성 요소는 Latent Goal Model인데, 이 파트는 로봇이 지금 보이는 장면에서 특정 subgoal까지 어떻게 이동해야 하는지를 어떻게 학습하고 판단하는지를 다룹니다

먼저 모델은 입력으로 현재 카메라 관찰 이미지 o_t, subgoal o_w을 입력으로 받아서 (1) 그 subgoal까지 도달하는 데 걸리는 시간 d_t^w, (2) subgoal로 도달하기 위해 지금 취해야 할 행동a_t^w, (3) 두 지점간 GPS 기준 상대적 위치 오프셋 x_t^w을 모두 예측하게 됩니다.

실제로 학습시에는 학습데이터의 trajectory에서 두 시점을 샘플링해서 더 이른 시점의 이미지를 o_t로 사용하고 더 나중 시점의 이미즐 o_w로 사용합니다.

근데 위에서 모델의 입력으로 subgoal을 받는다고 하였지만 실제 운용 관점에서 새로운 환경을 탐색해야한다고 했을 때, 해당 모델은 ViNT의 diffusion 모델로 subgoal 이미지를 생성하는 것과 비슷하게 현재 이미지 o_t만을 보고도 latent 공간에서 도달 가능해 보이는 waypoint 후보를 직접 생성할 수 있습니다. 별도의 이미지 생성 모델이나 기하학적 지도 없이도 이 근처에서 갈 수 있을 것 같은 subgoa 을 스스로 만들어내는 능력이 있다는 것입니다.(물론 ViNT에 나왔던 diffusion 모델처럼 이미지를 생성하는 방식이라는 많이 다릅니다.)

latent goal model의 전체구조는 두개로 쪼갤 수 있습니다.

- Waypoint Encoder p_\phi(z_t^w \mid o_w, o_t)

- Predictor (Decoder) q_\theta({a, d, x}_t^w \mid z_t^w, o_t)

근데 여기서 z_t^w (latent waypoint)는 2가지 방식으로 얻을 수 있습니다. 서브골 이미지가 주어지지 않을 때 prior 분포 r(z_t^w) = \mathcal{N}(0, I) 에서 샘플링(탐색시) 서브골 이미지 o_w가 주어졌을 때 인코더 p_\phi(z_t^w \mid o_w, o_t)로 부터 샘플링할 수 있습니다.

따라서 서브골 이미지가 주어지 않을 때 prior에서 샘플링된 latent waypoint z_t^w \sim r(z_t^w) 도 유효한 예측을 만들어내야하기 때문에 저자는 VIB(Variational Information Bottleneck)을 활용합니다. VIB는 KL-divergence 를 통해 encoder p_\phi(z_t^w \mid o_w, o_t)가 prior r(z_t^w) 와 분포가 가깝도록규제하는 방식이라고 하는데, 제가 이해한 바로는 학습 때에는 항상 (o_t, o_w)가 있으니까 encoder p_\phi(z_t^w \mid o_w, o_t)를 사용해 z를 샘플링하고 이 분포가 prior r(z) = \mathcal{N}(0,I)와 KL로 가까워지도록 만들면 결과적으로 encoder가 만들어내는 z들의 분포 ≈ prior 분포가 되게 될 것이고 그러면 테스트 시에는 굳이 o_w가 없어도 그냥 z \sim \mathcal{N}(0,I)에서 뽑아도 encoder가 만들었을 법한 z와 통계적으로 비슷하니까 decoder가 의미 있는 waypoint가 될 수 있다라고 이해하였는데, 자세한 내용은 논문에서 다루고 있지 않아 잘 이해했는지는 모르겠습니다…

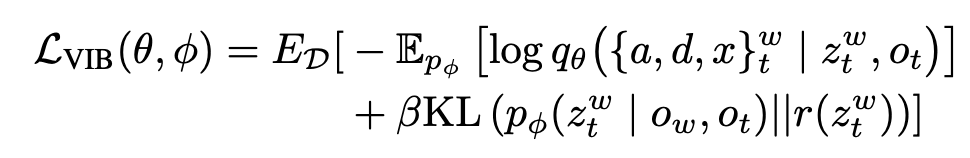

결과적으로 아래는 p_\phi와 q_\theta 를 학습시키는 목적함수입니다.

첫 번째 항은 모델이 {a, d, x}를 정확하게 예측하도록 만드는 항이고 두 번째 항은 그 샘플에서 나오는 encoder 분포를 prior에 가깝게 만들도록 하는 항이라고 보시면 될 것 같습니다.

B. Informed Search on a Topological Graph

앞서 A에서는 로봇이 단일 subgoal까지 이동하는, loca 하게 잘 움직이는 능력을 학습하는 과정이었다면 여기서는 이 로우레벨 모델을 기반으로 수 킬로미터(km) 규모의 장거리 목표(goal)를 찾아가는 하이레벨 플래너를 결합한 부분을 다룹니다.

ViKiNG은 이전 논문들과 마창가지로 로봇의 탐색 과정에서 로봇이 실제로 도달해본 위치들을 노드로 삼아 위상적(topological) 그래프 T 를 점진적으로 구축합니다. 간단하게 토폴로지 그래프의 구성들에 대해 설명드리면 노드는 해당 지점에서 관찰한 이미지를 뜻하고, 간선(edge)은 로우레벨 모델이 예측한 temporal distance를 뜻합니다. 여기서 중요한 건 현실에서는 A, D, Dijkstra(플래닝 알고리즘)가 가정하는 것처럼 모든 노드들과 노들 간 거리 정보 등 사전에 미리 알 수도 없다는 점입니다. 로봇은 직접 방문해야 그 노드를 알 수 있는데 그 방문 자체가 비용이 되게됩니다. 그래서 저자들은 이러한 문제를 극복하고자 A* 을 변형한 ViKiNG-A 알고리즘을 제안합니다.

로봇은 매 local 하게 움직이는 반복에서 Open set(아직 탐색되지는 않았지만 앞서 prior에서 랜덤 샘플링한 z로 예측한 d,a,x로 만든 waypoint들의 후보들)에서 가장 비용이 낮은 waypoint w_t를 선택하고 실제로 그 지점까지 주하고 도착 후 관찰한 이미지 o_t 를 그래프 T에 추가하면서 d정보를 활용해 엣지도 연결하는 방식으로 탐색+그래프생성을 하게 됩니다.

어떤 후보들이 비용이 낮은지 계산은 아래처럼 4항의 합으로 구성이됩니다.

\text{cost}(w) = g(t,w) + d_{\text{Pr}[w]}^{w} + h(w) + v(\text{Pr}[w])

먼저 위에서 g(t,w)는 subgoal 노드 w 위치에서 부모 노드까지의 경로 비용. 즉 현재 있는 노드와 새롭게 생성된 노드간 경로 비용이라고 보시면됩니다. (그래프 T 상에서 플래닝 알고리즘으로 계산)(부모 노드는 현재 노드를 의미하고 \text{Pr}[w]로 표기함.) d_{\text{Pr}[w]}^{w}은 앞선 g(t,w) 랑 비슷한데 부모 노드로부터 waypoint w 후보까지의 모델 예측 temporal distance을 비용으로 계산합니다. h(w) 같은 경우는 목표까지의 heuristic인데 자세한 내용은 C 파트에서 다루도록 하겠습니다. 그리고 v(\text{Pr}[w])는 같은 경우는 v(\text{Pr}[w]) = C \cdot N(\text{Pr}[w]) 와 같이 구성 되어있고 N(\text{Pr}[w])은 서브루틴을 통해서 로봇이 부모노드 현재 노드에 도착한 총횟수라고 합니다. 이 항같은 경우에는 새로 도달한 지점일 경우 어드밴티지를 주는 역할을 하는 항으로 로봇이 이미 여러번 방문한 노드보다 한번도 가보지 못한 새로운 지점을 더 탐색하도록 유도하기 위해설계했다고 합니다.

요약하면 위 식에서 왼쪽부터 차례대로 1~4 항이라고 했을 때, 1항 + 2항은현재 위치에서 빠르게 도달할 수 있는 waypoint를 3항은 목표 방향으로 더 가까워지는 waypoint를 4항은 아직 많이 방문되지 않은 새로운 waypoint를 찾도록 유도하는 그런 비용함수라고 이해하시면 좋을 것 같습니다.

C. Search를 위한 목표 지향적 Heuristic 학습

앞선 비용함수에서 언급했던 3항에 대한 내용에 대해서 자세하게 다루도록 하겠습니다. 먼저 리뷰 서두에서 언급하였듯이 ViKiNG의 장거리 탐색을 가능하게 하는 핵심 구성요소는, 위성 사진·로드맵과 같은 지리적 힌트(geographic hints)를 활용해 어떤 waypoint가 목표 방향으로 유망한가?를 판단하는 heuristic 함수를 활용했기 때문에 있다고 하였습니다. 기존 A* 탐색에서는 GPS 좌표만 있다면 |x_G - x_w| 과 같은 단순 거리 기반 heuristic을 사용할 수 있지만, 위성 이미지나 schematic 지도처럼 metric 공간이 아닌 시각 정보에 대해서는 이런 방식을 사용할 수 없습니다.

따라서 저자들은 이 heuristic을 데이터 기반으로 직접 학습하는 방식을 활용합니다.

저자는 waypoint w가 목표 G까지 이어지는 유효한 경로 위에 있을 확률 모델p_{\text{over}}(w \rightarrow G \mid x_w, x_G, x_t, c_t)을 정의 합니다.

여기서 c_t는 현재 위치를 중심으로 크롭한 overhead 이미지(로드맵,위성 사진)라고 보시면 됩니다.

따라서 저자는 이 확률을 사용하여 heuristic을 아래와 같이 정의합니다.

h_{\text{over}} = \lambda_{\text{over}} (1 - p_{\text{over}})

목표 방향에 맞는 waypoint일수록 p_{\text{over}} 는 커지게 되고 그럼 h_{\text{over}}(최종비용)은 낮아지고 반대로 목표와 무관한 waypoint는 h_{\text{over}}가 커져 다음 iteration에서 밀려나게 됩니다.

그리고 샘플링된 waypoint는 아직 가본 적이 없으므로 실제 GPS x_w가 존재하지 않습니다. 그래서 저자는 이 문제는 low-level model이 예측한 GPS offset x_t^w 을 사용해 x_w = x_t + x_t^w (현재 GPS + 예측한 GPS)로 복원함으로써 해결합니다.

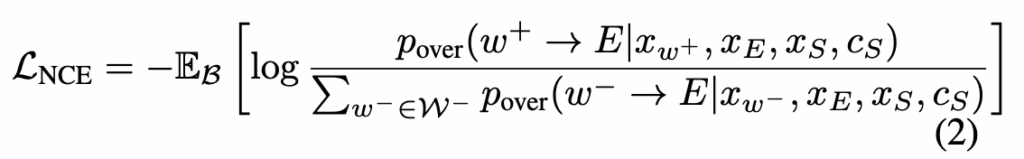

결국 학습하고자 하는 확률 모델 p_{\text{over}}을 학습하기 위해 저자들은 InfoNCE 기반 contrastive learning을 사용했다고 합니다. 이 학습의 핵심 아이디어는 같은 trajectory 내에 실제로 존재했던 waypoint들을 positive w^+ 로 정의하고 전혀 다른 trajectory에서 가져온 waypoint들은 negative w^- 샘플로 만들어서 모델이 이 둘을 구분하도록 학습시키도록 하는 것입니다. 해당 InfoNCE loss는 아래 처럼 구성되어있습니다.

결과적으로 해당 구조는 목표까지 실제로 이어지는 waypoint를 높게, 무관한 waypoint를 낮게 평가하도록 모델을 학습시키도록 설계되었다고 보시면 될 것 같습니다.

논문에서는 명시적으로 언급되어있지는 않지만 결국 로우레벨 모델과 이 휴리스틱 모델을 따로 학습시키는 것 같습니다. NoMaD와는 다르게 엔드투 엔드는 아닌 것 같습니다.

학습 trajectory는 길어야 50m인데 실제 수 km 떨어진 goal까지 가야 하는 상황에서 일단 지금까지만 보았을 때에는 딱히 heuristic이 장거리 관계 보다는 단거리(local) 관계만 학습하는 걸로 보입니다.

저자들은 여기에 추가로 Goal Chaining(trajectory stitching) 기법이라는 것을 사용합니다.

GPS 상에서 서로 겹치는 여러 trajectory들을 연결해 거대한 macro-trajectory(수 km 단위) 를 만든 뒤, 이 내부에서 x_S, x_E, x_{w^+} 를 샘플링하여 실제 학습되는 Positive waypoint w^+와 목표 x_E는

수 km 떨어진 관계일 수도 있게 됩니다.

결과적으로 렇 p_{\text{over}} 모델은 장거리 목표까지 학습할 수 있는 많은 양의 long-horizon sample들을 얻게 될 수 있고 heuristic 함수가 장거리 목표 까지 더 잘 도달할 수 있도록 도와줄 수 있게 됩니다.

Experiments

이제 실험 결과에 대해서 설명드리도록 하겠습니다.

지금까지 리뷰했던 논문과는 다르게 자문자답 형식의 실험결과를 구성하지는 않았습니다.

먼저 지상이동 모바일 플랫폼 인 Clearpath Jackal UGV에 ViKiNG을 탑재해 실험하였고 데이터셋은 크게 두종류로 이루어져있습니다.

자율주행 기반의 랜덤 데이터 30시간( office 환경의 쾌적한 환경, 완전히 자동으로 수집된 다양하고 예측 불가능한 주행 패턴이 특징이라고 합니다.)

그리고 teleoperation 기반의 12시간 데이터(도심 보도, 공원, 등산로 등,위험 요소나 복잡한 지형을 사람이 직접 탐색해 수집) 저자는 명시적으로 실내외 구분하지는 않았지만 실내외 구분된 데이터 셋이라고도 볼 수 있을것 같습니다. 앞서 메서드 파트에서 잠깐 언급하였지만 학습 중 본 trajectory의 최대 길이가 80m(평균은 45m 수준)입니다. 그런데도 실제 테스트에서는 아래 처럼 1km 이상 장거리 목표까지 안정적으로 이동하면서, 학습 데이터의 평균 속도(1.68 m/s)의 80% 이상을 유지했다고 합니다.

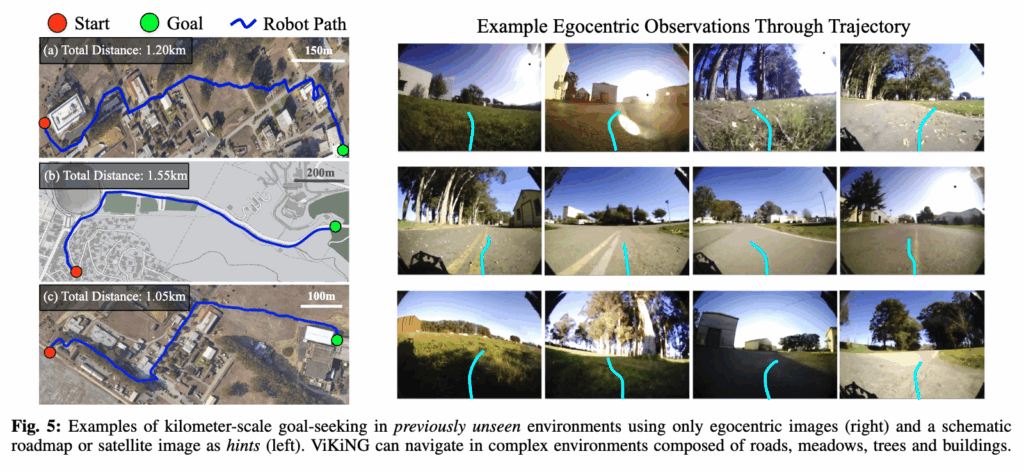

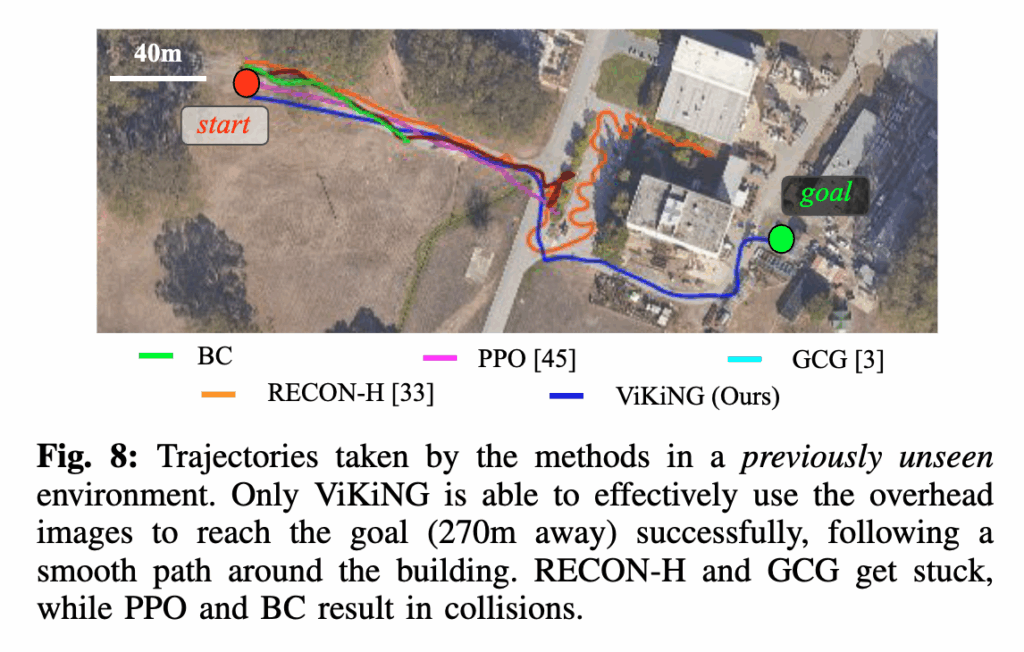

그리고 저자들은 ViKiNG을 완전히 처음 보는 다양한 open-world 환경에 배치하여 장거리 navigation을 수행하는 실험도 진행하였습니다.

건물이 많은 캠퍼스 환경, 도심 환경 등등에서도 잘 주행하는 모습을 보였으며 특히 막다른 골목에 들어가면 스스로 돌아 나오고 open set의 다른 노드에서 탐색을 재개해서 결국 목표에 도달하는 모습을 보였다고 합니다.

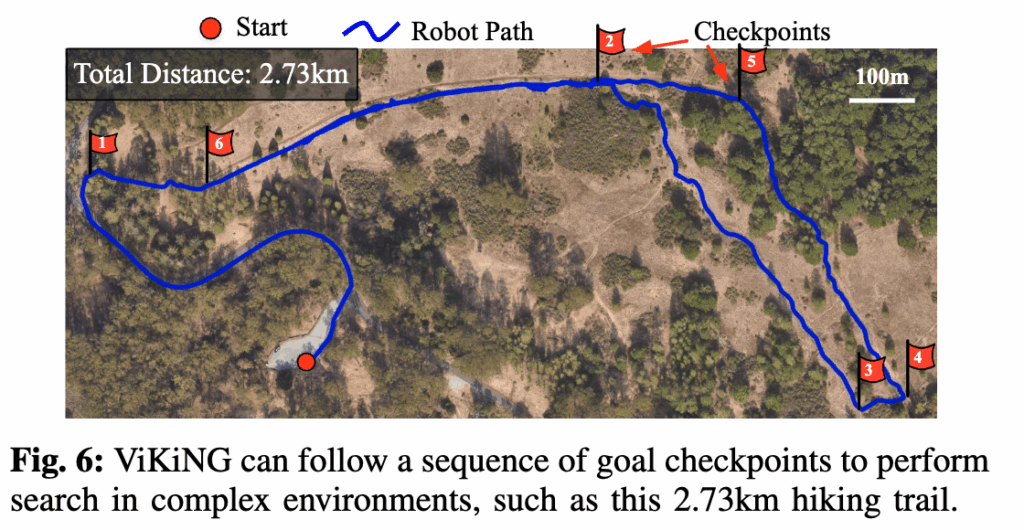

그리고 저자는 고도 상승이 70m 정도 되는 2.7km 의 하이킹 트레일 주행실험을 하였습니다.

위 처럼 6개 checkpoint image와 + GPS 정보를 제공해주고 ViKiNG-A* 를 6개의 goal마다 반복 실행하였다고 합니다. 그리고 Topological graph T는 계쏙 재사용하는 방식으로 실험을 진행하였다고 합니다. 결과적으로: 로컬 충돌 회피 장거리 heuristic이 잘 결합되어 트레일을 벗어나지 않고 모든 checkpoint를 성공적으로 통과하는 모습을 보였다고 합니다.

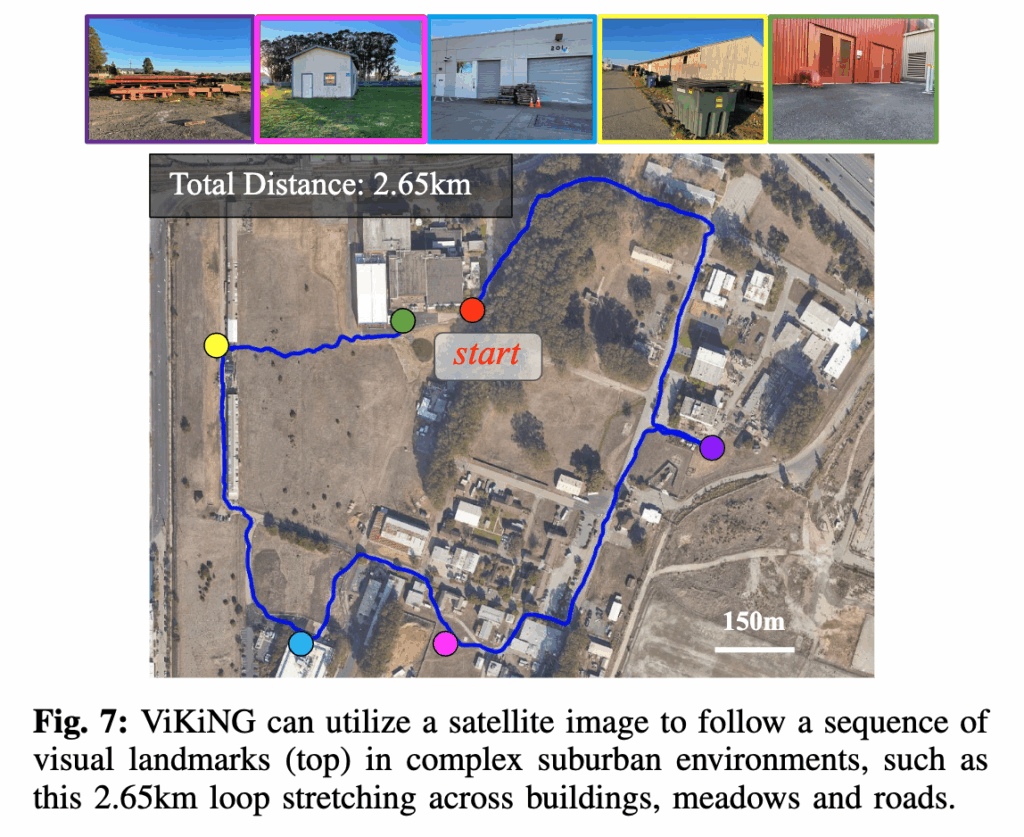

저자는 교외(suburban) 환경 테스트에서는 5개의 landmark 이미지를 순차적으로 방문하는 visual inspection task를 수행하였습니다. 위 fig같은 경우를 보면 로봇이 각 랜드마크에 안정적으로 잘 도달 하는 결과를 보입니다.(인간의 개입이 단 한번도 없었다고 합니다.)

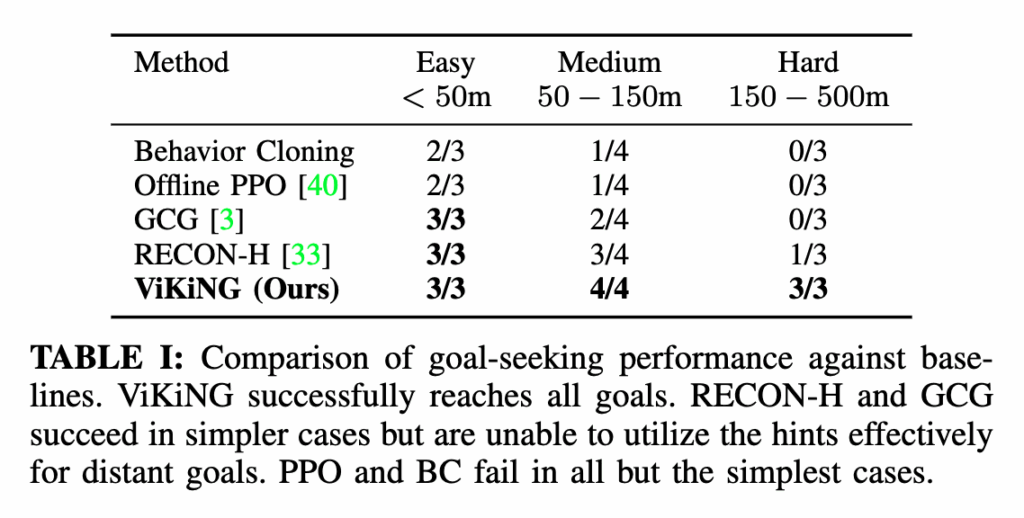

마지막으로 정량적 평가에 대해서 다루도록 하겠습니다. 비교 대상은 총 4가지이고 모든 방식은 동일한 데이터, 동일한 입력(RGB, GPS, satellite), 동일 액션 스페이스 조건을 갖춘 상태로 비교하였습다고 합니다.

상황은 10개의 unseen environment에서 목표 RGB 이미지그리고 대략적인 GPS 위치 를 주고, 사람이 개입하지 않고 도달하면 성공하는 실험을 진행하였는데 결과는 아래 테이블 표와 같습니다.

결과적으로 ViKiNG은 대부분의 환경에서 가장 높은 성공률을 기록하는 모습을 보입니다. 특히 장거리 목표 탐색에서 기존 기법들보다 압도적인 모습을 보이네요.

이제 해당 방법론이 장거리 수행에있어서 핵심적인 역할을 다룬 부분에 대한 실험을 설명드리도록 하겠습니다. 저자들은 지리적 힌트의 품질이 떨어지거나 잘못되었을 때도 시스템이 얼마나 안정적으로 동작할 수 있는지를 다양한 실험을 통해 보여줍니다. 결론적으로 ViKiNG은 힌트를 지도처럼 절대적인 정보로 사용하지 않고 단지 목표 방향으로 탐색을 유도하는 heuristic으로만 활용하기 때문에, 힌트 품질이 좋지 않아도 전체 시스템이 크게 무너지지 않는다는 점을 중심으로 보셔도 좋을 것 같습니다.

저자들은 먼저 힌트 이미지의 종류가 heuristic 학습에 어떤 영향을 미치는지를 비교합니다. 동일한 데이터로 학습하되, 사용된 힌트만 로드맵(roadmap) 기반 힌트, 위성 이미지(satellite image) 기반 힌트로 형태를 다르게 줍니다. 모든 구조는 동일하고, 단지 입력되는 힌트의 형태만 다르다고 보시면 좋을 것 같습니다.

결과적으로 로드맵 기반 모델은 로드맵에 표시된 도로 경로를 우선적으로 따르는 경향을 학습합니다.반면 위성 이미지 기반 모델은 잔디, 트레일, 평평한 지형 등 실제로 통과 가능한 지면을 판단하고 로드맵에 없는 지역도 더 빠르면 과감하게 가로질러 이동하는 경향을 보입니다. 저자들은 위성 이미지가 로드맵보다 훨씬 풍부한 시각적 특징들을 가지고 있어서 위와 같은 결과를 보이는 것이라고 분석합니다.

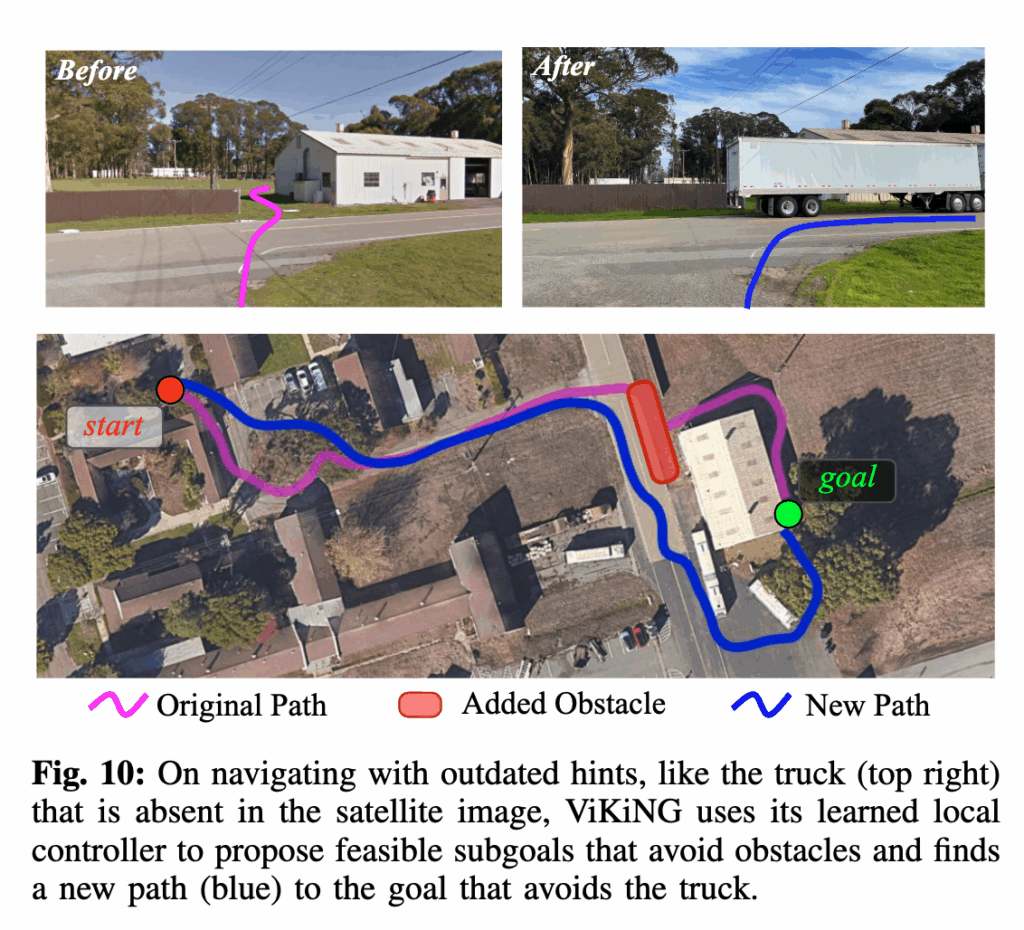

그리고 저자들은 두번째로 이 지리적 힌트 정보가 오래되어 실제 환경과 맞지 않을 때, 즉 현재는 2025년인데 2020년 지리 정보를 힌트로 주면 노이즈로 작용될 수 있는데 이거에 대해서ViKiNG이 어떻게 행동하고 얼마나 대응을 잘하는지를 점검하는 실험도 보여줍니다.

그래서 저자들은 원래 경로를 막는 대형 트럭 장애물을 새로 설치하여 과거 상태인 위성 이미지엔 이 장애물이 반영되어 있지않는 그런 상황을 만들어 낸 후에 실험을 진행합니다.

결과적으로 로봇은 기존 위성 이미지가 안내하는 경로를 따라가 트럭 바로 앞까지 접근합니다. 하지만 충돌하지 않 새로운 우회 경로를 스스로 찾아 목표까지 이동하는 모습을 보였다고 합니다. latent goal model(로우레벨 모델)은 충돌을 일으킬 수 있는 subgoal을 애초에 제안하지 않고 heuristic은 valid subgoal만 평가하기 때문에 저렇게 힌트와 실제 환경 간의 작은 차이는 시스템 전체를 흔들지 않는 모습을 보입니다. 결국 힌트가 틀렸더라도 로컬 컨트롤러가 기하학적 제약을 자동으로 보정해주는 역할을 해주기 때문에 잘 작동하는 것임을 보여주는 실험 같습니다.

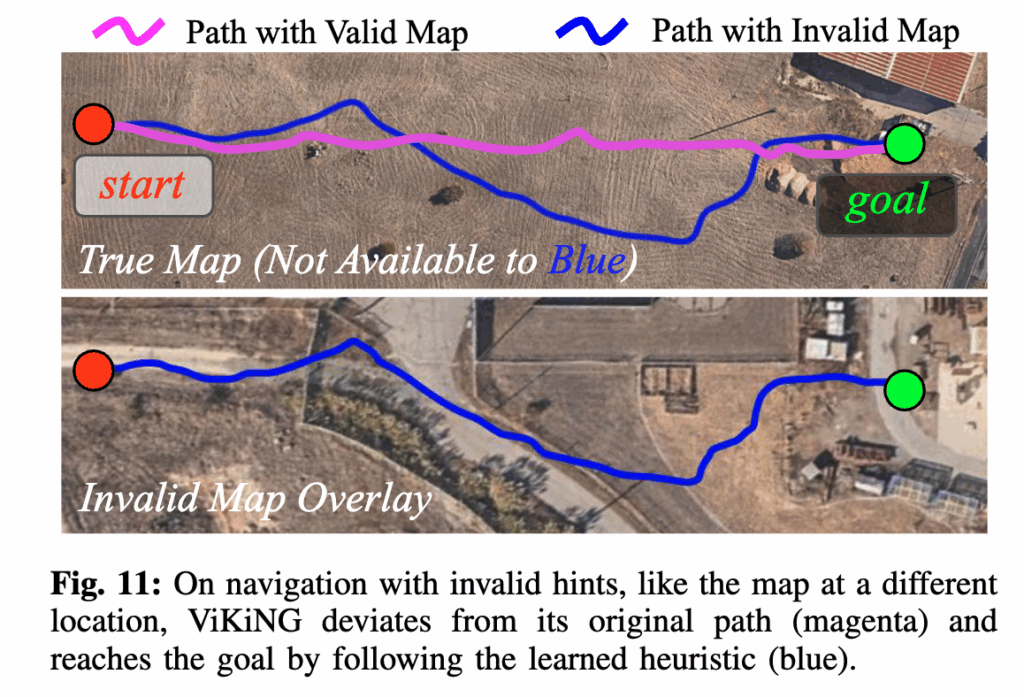

그리고 이번에는 위 상황과는 완전 다르게 완전 틀린힌트를 주는 경우인데, 여기서는 GPS를 의도적으로 약 5km 오프셋시키는 방식으로 로봇이 완전히 잘못된 위성 이미지를 참고하도록 실험을 진행합니다. 즉, 실제로는 존재하지 않는 곳에 도로가 있다고 로봇이 믿게하는 실험입니다.

결과적으로 로봇은 실제 환경에는 없는 도로가 있다고 생각하고 원래 경로에서 벗어난 움직임을 보입니다. 근데도 목표에는 성공적으로 도달합니다. 왜냐면 잘못된 지도가 가리키는 경로가 실제로도 장애물 없는 개방된 공간 이었기 때문입니다. 이 실험은 ViKiNG이 힌트를 절대적으로 따르지 않는 것을 보여주면서 힌트가 유도하는 방향이 위험하지 않은 한에서만 가능하다는 점을 보여줍니다.

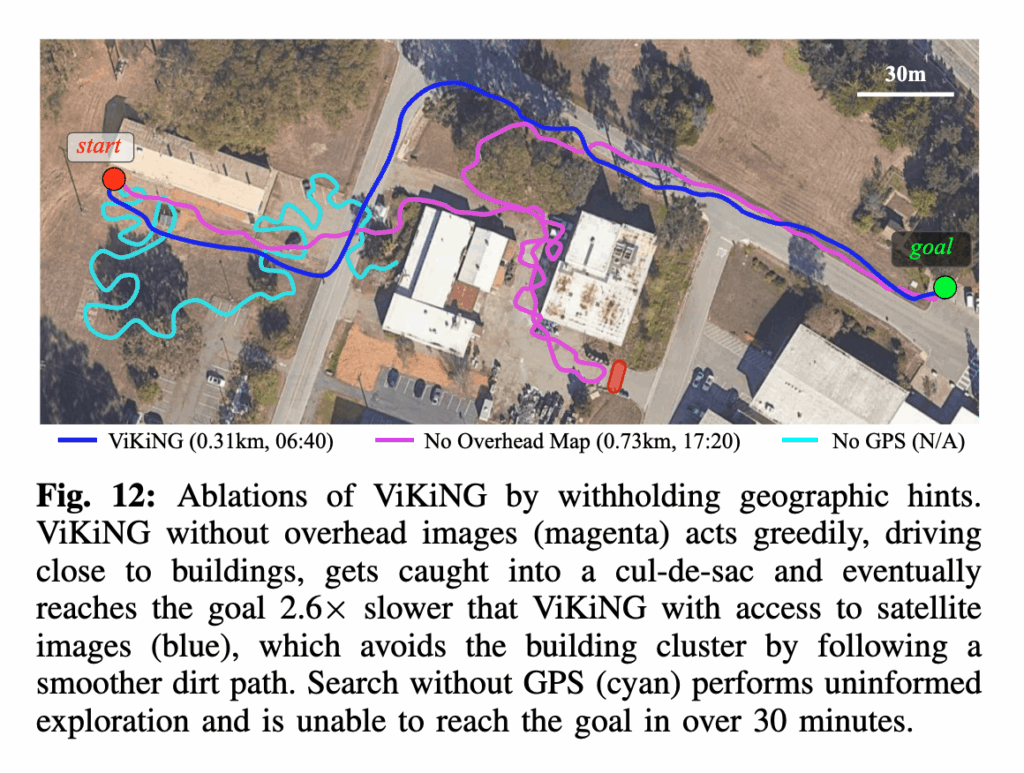

그리고 마지막 실험은 힌트 품질의 문제가 아니라, 아예 힌트를 제거하면 어떻게 되는지 확인하는 실험을 합니다. 먼저 Overhead 이미지 없음이 (GPS만 사용) 사용하는 경우, 즉 위성 이미지 없이 단순히 h_{\text{GPS}} = |x_g - x_w| 형태의 거리 기반 heuristic을 사용합니다.

여전히 목표 도달은 가능하지만, 탐색 시간이 길어지고 막다른 길로 잘못 들어갔다가 backtracking하는 과정이 발생하는 모습을 보인다고합니다.

그리고 추가적으로 GPS까지 제거 (완전 uninformed search)하는 실험도 진행합니다. 이 경우에는 저자의 컨트리뷰션인 heuristic 자체가 사라져 ViKiNG-A* 는 사실상 Dijkstra 같은 무정보 탐색을하게 되는데, 이 경우 로봇은 주변을 무작정 탐색하게 되고 30분이 지나도 목표에 도달하지 못하는 모습을 보인다고 합니다. 결과는 위 피규에서 확인하실 수 있습니다.

결과적으로 ViKiNG이 장거리 navigation을 수행하기 위해서는 적어도 약한 형태의 힌트라도 필요하다는 점을 보여주는 것 같습니다.

이상 리뷰를 마치도록 하겠습니다. 감사합니다.

안녕하세요 우현님 리뷰 감사합니다.

ViKiNG은 SLAM이나 metric map 없이, 이동 중에 쌓인 관찰들로 topological graph를 만들고 ViKiNG-A* 탐색을 통해 학습 시 본 trajectory 길이를 넘어 km-scale planning을 가능하게 한 것으로 이해했습니다.

그런데 비교 실험에서 BC나 Offline RL도 baseline으로 등장하는데, map이 전혀 없는 설정에서 BC/Offline RL이 수행한다는 planning은 어떤 의미인가요? 제가 이해를 잘못 한 것일수도 있을 것 같습니다,,