안녕하세요 1번째 X-Review 작성자 손우진입니다. 처음 작성하는 리뷰라 미숙한 점이 있을 수 있습니다. 독자분들 모두의 피드백은 저의 실력향상과 올바른 길로가는 거름이라 생각하고 성심껏 답변하고 받아드리겠습니다! 언제든 질문 부탁드립니다. 그럼 거두절미하고 첫번째 논문리뷰 시작하겠습니다

(2022 CVPR에 발표된 논문으로 pose Estimation 에서 RGB이미지만으로 occlusion에 강인함을 제안한 논문입니다)

Introduction

이번 리뷰는 제가 처음으로 작성하는 6DoF 관련 논문 리뷰이며, 앞으로도 이 분야의 논문을 자주 보게 될 것 같아 먼저 간략하게 6DoF 포즈 추정이 무엇인지 소개한 뒤 본격적으로 논문을 설명드리겠습니다.

로봇 비전, 자율주행, 증강현실 등 다양한 컴퓨터 비전 응용에서는 카메라가 관찰한 이미지로부터 실제 물체를 인식하고 조작하는 기능이 필수적입니다. 이를 위해서는 단순히 물체를 ‘어디에 있는지’ 뿐만 아니라 ‘어떤 방향을 향하고 있는지’ 즉 3차원 공간에서의 위치(Position)와 자세(Orientation) 를 함께 알아야 합니다.

이처럼 3축 위치(x, y, z)+3축 회전(roll, pitch, yaw) 을 모두 추정하는 것을 6DoF포즈 추정이라고 합니다. 결국 이 문제는-> real world의 물체를 카메라 좌표계로 투영하고 그것의 위치와 방향을 정확히 해석하는 것에 핵심이 있습니다.

그렇다면 object pose estimation에서 물체의 방향과 위치를 정확히 추론하는 일은 핵심이라는 점에 공감하실 수 있을 것입니다. 이를 위해 다양한 방법론이 제안되어 왔으며 일부는 깊이 정보를 포함한 센서(depth sensor) 를 활용해 높은 신뢰도를 확보하기도 했습니다. 하지만 depth sensor는 비용, 환경 제약, 반사/투명체 문제 등으로 인해 항상 실용적인 해결책은 아닙니다. 이에 따라 본 논문은 단일 RGB 이미지만을 활용하여 6DoF 포즈를 추정하는 문제에 집중하고 있으며 특히 가림(occlusion) 상황에서도 견고하고 일관된 예측이 가능한 RoPE 프레임워크를 제안합니다. 서두가 너무 길었습니다. 본격적으로 리뷰 시작하도록 하겠습니다

RGB만을 가지고 pose를 추정하게 되면 depth 정보가 없어 여러 한계들이 존재합니다. 그 중 저자는 특히 가림(occlusion) 상황에서의 예측에 주목합니다. 물체의 일부분이 보이지 않거나 다른 물체에 의해 가려질 경우 정확한 포즈 추정이 어려워지는 문제로 특히 기존의 대표적인 two-stage 방식에서도 충분히 해결되지 않는 영역입니다. 기조 two-stage 대표방식인 pvnet,BB8등 2D-3D의 대응점을 이용해서 모델의 학습후에 PnP알고리즘으로 해결하는 방법은 정확도도 높을 뿐더러 PnP알고리즘으로 보완될수있습니다. 하지만 이런 two-stage 방식은 본질적으로 occlusion에 취약하다는 한계점이 존재합니다. 때로는 PnP알고리즘에 너무 의존할수도 있을수도 있다고 생각이듭니다. 저자는 이러한 한계를 극복하기 위해 occlude-and-blackout (OBA) 배치 증강 기법을 도입하여 occlusion에 강한 feature들을 학습하도록 유도하고 추가적으로 일관된 랜드마크 예측을 위해 (전체 형태와 어긋나지 않도록 배치되는 것) Multi-precision supervision(MPS)를 설계했습니다.

Method

가장 핵심이되는 파이프라인은 위와같습니다. 2D랜드마크 예측은 HRNet으로 사용하고있습니다.그렇다면 occlusion에 대한 강인함과 랜드마크의 일관성을 향상시킬수 있었던 방법을 설명드리겠습니다.

OBA

우선 앞서언급했듯이 occlude-and-blackout batch augmentation입니다

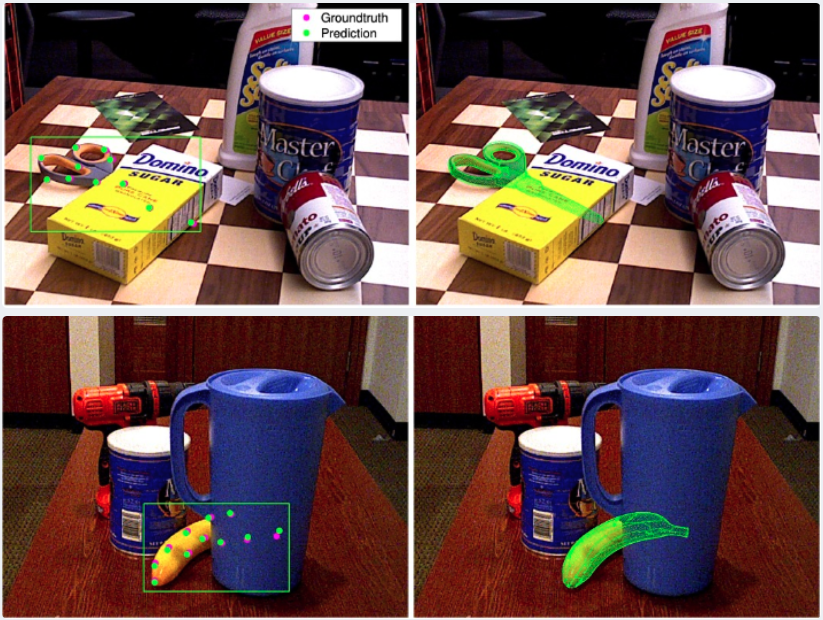

물체는 보통의 경우는 쉽게 학습을통해 예측을 할수있지만 위의 사진처럼 외부의 개입으로인해 가려짐이 생길수있고 다양한 유형의 가림 상황이 있을 수 있습니다. 그래서 occlusion에 대해서도 강인함을 얻기위해 Random erasing, hide-seek 등 다양한 augmentation을 활용합니다(물론 이런 기법들이 pose estimation에 맞춤으로 나온것은 아닙니다). 그래서 RoPE논문에서는 이런 증강기법들의 영감을 받아 해당 기법과 유사하게 RoI align을 통해 객체의 바운딩 박스를 추출하여 박스내의 grid로 분할하여 noise나 random patch로 부분을 대체하였습니다. 이런한 방식은 데이터의 다양성뿐만 아니라 overfitting을 방지하고 일반화성능을 높이는데 효과적입니다.

–학습시에는 위 파이프라인과 같이 한 배치안에서 같이 학습이됩니다.–

MPS

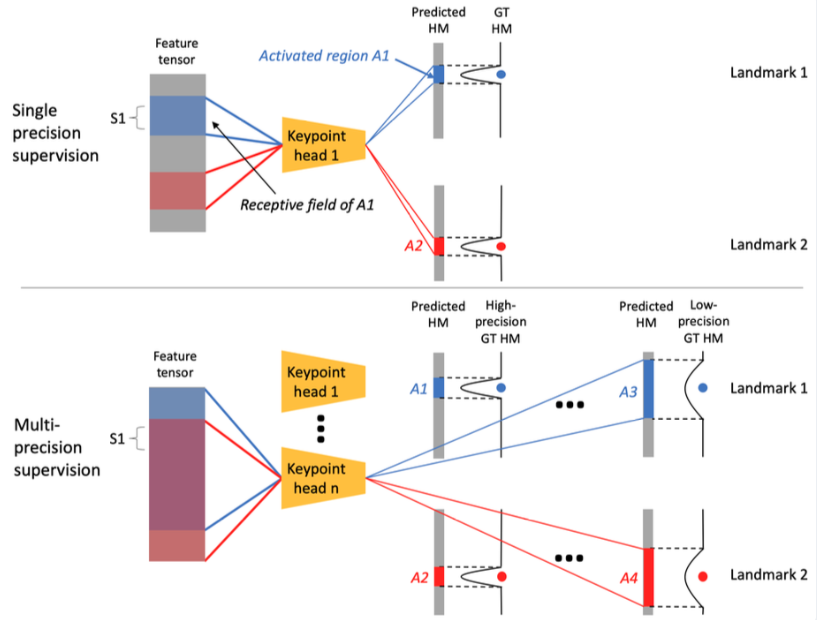

두번째로는 MPS(Multi-precision supervision)입니다. 위 파이프라인(figure 2)에 heatmap이 3개인 점을 주목해주세요. 기존의 heatmap-based 는 하나의 가우시안 히트맵을 사용합니다. 이때의 분산값은 예측 성능에 큰 영향을 주는 하이퍼파라미터입니다. 분산이 작을수록 위치는 정밀하게 예측되지만 전체적인 구조를 반영하지못합니다. 따라서 occlusion에 강해지기위해서는 구조적인 일관성이 중요하여 서로 다른 분산을 가진 세개의 heatmap을 동시에 학습합니다. 조금 더 구체적으로 말씀드리자면 위 그림처럼 단일 정밀도(single precision)로 학습할 경우 feature map의 특정 영역은 오직 하나의 랜드마크 예측에만 사용됩니다. 즉 feature tensor의 일부가 지역적인 정보(local feature) 만 반영하게 되고 물체 전체 구조와의 관계는 학습되지 않습니다. 반면 MPS 구조에서는 하나의 feature가 여러 수준의 heatmap supervision을 동시에 받습니다. 이로 인해 같은 feature 구간이 여러 랜드마크 예측에 관여하게 되고 네트워크는 보다 구조적이고 일관된 표현 즉 holistic representation을 학습하게 됩니다. 특히 occlusion 상황처럼 일부 랜드마크가 보이지 않을 때에도 다른 랜드마크들과의 상대적 관계를 바탕으로 예측을 보완할 수 있어 구조적으로 안정적인 포즈 추정이 가능해집니다.

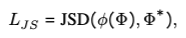

학습된 heatmap은 예측한 heatmap을 softmax 된것과 GT heatmap을 통해서 확률 분포간의 차이를 출이는 Jensen-shannon divergence를 사용합니다.

landmark filtering

그렇다면 이렇게 학습된 네트워크를 통해서 keypoint를 예측하게 되는데요 high precision(분산이 작아 위치정확도는 높지만 노이즈에 민감)을 통해서 예측된 2D keypoint 와 mid-precision(분산이 보다 넓어 형태 파악에 강하지만 위치 오차가 클수있음-> Xm)을 통해 예측된 keypoint를 통해서 서로 유사한 경우에만 신뢰성있는 keypoint라 생각하고 선택되어집니다.

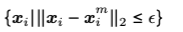

위 식을 통하여 pnp(3개의 점, 1개의 검증용 점)solver로 값이 가장 작은 4점을 pnp solver로 넘겨지게 됩니다. 이러한 filtering 방식(high-precision 예측과 mid-precision 예측이 서로 유사한 점만 선택하는 방식)은 refinement 없이도 예측 품질을 사전에 확보하는 방법에 큰 기여를 하게 됩니다.

Experiments

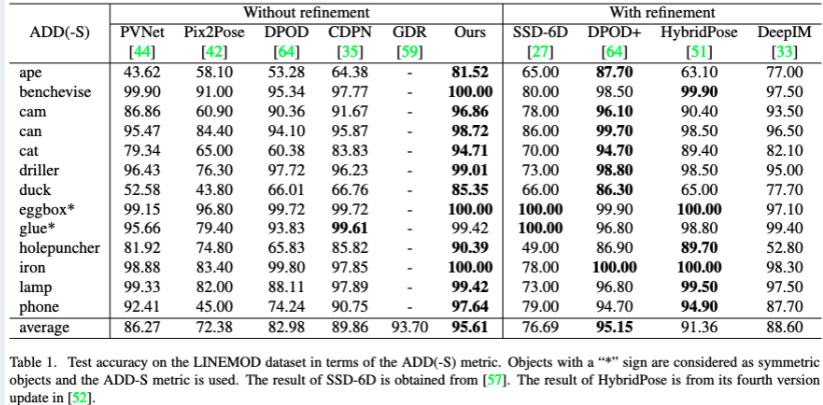

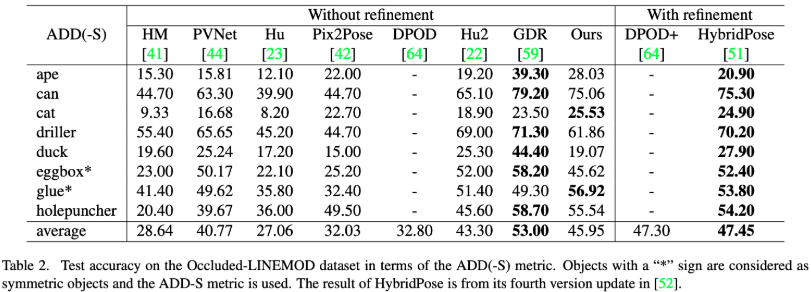

먼저 주요 실험 은 Table1 과 Table2 입니다 dataset은 LINEMOD와 Occluded-LINEMOD입니다

LM데이터셋에서 각 refinement 단계를 포함하는지 여부에 따라 두 그룹으로 나누어서 비교하였습니다. 평균 ADD(-s) (예측된 6DoF 포즈로 정렬한 3D 모델과 정답 포즈로 정렬한 3D 모델 간의 평균 거리를 측정하는 지표) 에서 refinement의 유무에 상관없이 가장 좋은 성능을 달성하는 결과를 확인할 수 있습니다.

그리고 occluded LINEMOD에 대한 실험 결과인데요 refinement 없이 학습된 방법 중에서 ADD(-s) 기준 두 번째로 높은 성능을 기록하면서 occlusion에 강인함을 보였습니다. 여기서 의문점이 드는 것이 occlusion에 강인하다고 해서 SOTA의 성능을 달성할 것처럼 논문에서 얘기를 했지만 그러지는 못해서 의문점이 듭니다 ):

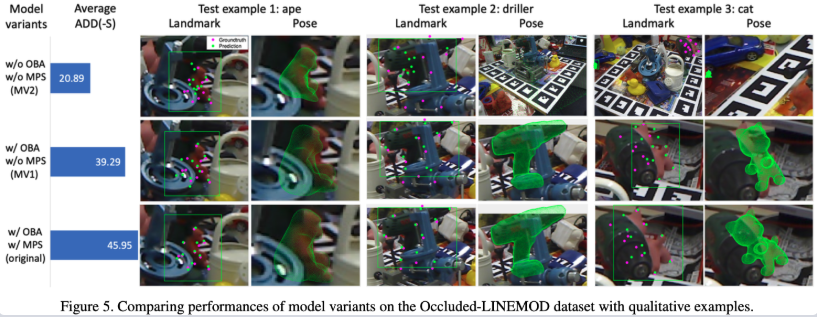

다음은 ablation result입니다

OBA 와 MPS를 사용했을때 나오는 실험결과인데요 위에서 부터 MV2 는 OBA 와 MPS 를 사용하지않는 결과입니다 keypoint예측에서 다소 예측점이 맞지않는 정량적결과를 보실수있습니다 그에 비해 OBS,MPS를 사용했을경우에는 높은 ADD(-s) 와 정량적 결과를 보실수있습니다.

Conclusion

논문에서 ROPE라는 프레임워크를 제안했고, 이는 가림(occlusion) 상황에서도 강인한 object pose estimation을 가능하게 합니다.가림에 강인한 특징(feature)을 학습하도록 유도(OBS)하고, 동시에 전체적(holistic) 표현 학습(MPS)을 하는것이 강인한 자세 추정을 달성하는 핵심임을 보였습니다. LINEMOD, Occluded-LINEMOD 널리 사용되는 벤치마크 데이터셋에서의 평가 결과 ROPE는 후처리(refinement) 없이도 SOTA를 능가하거나 이에 필적하는 성능을 보였습니다.

제가 준비한 첫번째리뷰는 여기까지입니다. 감사합니다. 끝으로 독자여러분들의 질문은 언제나 환영입니다^^.

우진님 좋은 리뷰 감사합니다.

Introduction에서 언급하신 2-stage 방식이 본질적으로 occlusion에 취약한 이유가 무엇인 지 궁금합니다.

또한, 해당 논문에서 제안한 occlude-and-blackout batch augmentation에서 Random erasing, hide-seek 등 기존의 augmentation과의 차별점이 있는지 궁금합니다. 즉, OBA 배치 증강 방식을 제안한 것과 기존 augmentation을 적용한 것 중 어디에 해당하는 지, 제안한 것이라면 어떤 차별점이 있는 지 설명 부탁드립니다.

마지막으로 MPS는 3가지 분포의 예측값을 만들어내는 데, 3가지 예측값으로부터 최종 keypoint는 어떻게 정해지는 지 설명 부탁드립니다.

좋은 댓글 감사합니다!

Q1. Introduction 2-stage방식이 본질적을 occlusion에 취약한 이유

-> 2-stage자체가 취약하다는게 아닙니다. 논문에서 저자가 주장하는 2-stage는 예를 들어 keypoint라고 했을때 keypoint에 대해서 최적화를 하거나 learning-based를 통해 계산됩니다. 그래서 연산량의 증가와 시간소비가 많이된다는 한계가존재합니다. 그래서 본논문은 mps를 통해 high-precision과 mid-precision 의 예측한 keypoint의 거리들을 통해서 최종 keypoint로 선택되는것입니다. 그래서 refinement 없이도 높은 성능을 달성할 수 있었습니다.

Q2. 기존 augmentataion 과의 oba 차이

-> 기존의 random erase 난 hide-and-seek같은 기법은 전체 데이터셋을 기준으로 픽셀별로 랜덤노이즈나 블랙아웃으로 처리하게됩니다. 하지만 저자는 object의 occlusion에 강인한성능을 향상시키기위해 기존 keyopoint를 기준으로 bbox를 설정하고 그 외 영역은 블랙아웃처리를 한다음 박스내 grid로 나누어 랜덤값을 주게 됩니다.

Q3. MPS 3가지 예측값으로부터 최종 keypoint 설정

-> 우선은 multi-precision 으로 각가의 키포인트가 있을것입니다 그리고 저희는 gt keypoint를 알고있구요 그래서 gt-keypoint 를 heatmap으로 형성합니다 이때 각각의 시그마에 적용된 heatmap이 형성되어서 각가의 gt가 다르겠죠? 그래서 그 히트맵과의 차이를 줄여나가는 방법입니다

충분히 답변되셨을지 모르겠습니다^^ 그럼 질문주셔서 감사합니다!

안녕하세요, 좋은 리뷰 감사합니다.

전체 파이프라인이 동작하기 위해서 2D 랜드마크 예측이 가장 먼저인 것 같은데요, HRNet을 사용하다고 말씀해주셨지만 랜드마크가 정확히 무엇이고 이를 예측하는 HRNet은 구체적으로 어떤 형태로 랜드마크를 예측하는 것인가요 ?

또한 OBA가 RoI align을 통해 객체의 바운딩 박스를 추출한 다음에 그 부분 중에 랜덤하게 노이즈나 패치로 대체한다고 이해하였습니다. 이 RoI align이 occlusion되어 가려진 영역까지 포함하는게 맞을까요 ? 그렇다면 전체 이미지로 봤을 때 가려진 부분에 대해서 노이즈나 랜덤 패치로 대체된다면 이전의 random erasing과 같은 기법과 거의 유사한 결과를 보일 것 같은데 이 augmentation 기법이 occlusion에 강인할 수 있는 이유가 무엇이라고 생각하시는지 궁금합니다.

감사합니다.

날카로운 질문 감사합니다^^

Q1. 랜드마크가 정확히 무엇이고 예측하는 HRNet은 구체적으로 어떤 형태로 예측하는가

>> 사전에 fps를 통해서 camera coordinate로 투영된 2D keypoint를 가지고 GT bbox를 사용하게됩니다 그렇다면 augmentation된 이미지와 Original 이미지를 HRnet에서는 feature 들만 뽑게됩니다 그 feature들을 통해서 bbox를 예측하게됩니다 keypoint는 뒤에mps에서 heatmap을 통해서 찾게됩니다

Q2. RoI align이 occlusion되어 가려진 영역까지 포함되어있는지?

>> 지금 데이터셋은 occlusion이 없다는 가정하에 학습이 됩니다. 그래서 oba 기법이 적용되면서 occlusion에 강인한성능을 가지게 됩니다.

질문주셔서 감사합니다^^

안녕하세요 우진님, 좋은 리뷰 감사합니다.

제가 pose estimation에 대해서는 잘 몰라서 드리는 질문일 수 있겠는데요.

논문에서 사용하는 GT heatmap은 데이터셋에 직접 제공되는 형태인지 아니면 landmark 좌표(GT 2D keypoint)를 기반으로 후처리로 생성한 것인지가 궁금합니다!

감사합니다.

댓글 달아주셔서 감사합니다~ 우현님!

좋은 질문입니다. GT heatmap같은경우 각각의 시그마 값을 반영하여 사전에 정의된 3D keypoint(물체 좌표)를 -> 2D keypoint(카메라좌표계)로 투영하여 만든 keypoint를 동일한 시그마값에서의 gt heatmap을 생성하여 예측된 heatmap과의 차이를 구합니다 즉 gt가 각 시그마값 마다 있다고 생각하시면 됩니다!

감사합니다?