이번 리뷰 논문은 열화상 영상 향상 알고리즘 논문입니다. 매번 딥러닝 기반의 모델들만 보다가 갑자기 영상 처리 논문을 들고 와서 의아해 하시는 분들도 계실 것이라고 생각이 듭니다. 저희 팀에서는 무인 이동체들이 이상 환경에서도 시각 인지를 잘 수행하도록 하는 연구를 진행하고 있습니다.

무인 이동체가 겪을 수 있는 여러 이상 환경 중에서 주로 저조도, 역광, 안개, 연기 등 가시 영역의 영상 센서가 시각 정보들을 취득하기 어려운 상황을 다루고 있습니다. 이러한 이상 상황을 해결 가능한 방법들은 다양하게 있습니다. 여러 해결 방법 중에서 저희는 센서 레벨에서 해결하는 방향으로 문제를 풀어나가고 있습니다.

이상 상황 중에서 타겟으로 둔 저조도, 안개, 연기 중 저조도는 광원체로부터 발산된 빛이 적거나, 없는 상황에서 발생하는 상황에 해당합니다. 광원체로부터 발산된 빛인 물체로부터 색 파장이 흡수되거나, 반사되어 색 정보를 인지할 수 있게 됩니다. 즉, 가시 영역의 영상 센서는 빛을 발산하는 광원체가 없으면 측정이 불가능하죠… 반대로, 역광은 헤드라이트나 태양 빛으로 인해 빛이 직접적으로 센서에 노출되는 현상을 의미합니다. 이런 현상은 렌즈로부터 빛이 더 극대화되면서 영상 센서에 노출되어 노이즈가 발생되는 현상으로 물체로부터 반사된 색 파장보다 강한 빛을 가지고 있기 때문에 정보 누락을 야기시킵니다.

저희 연구실에서는 저조도와 역광을 해결하기 위한 수단으로 원적외선 열화상을 이용하고 있습니다. 먼저, 저조도는 위에서 언급한 바와 같이 가시 영역 영상 센서들은 광원체로부터 발산된 빛으로부터 물체에 ‘반사된 색 파장’을 인지하여 영상 센서 정보를 취득합니다. 반면에 원적외선 열화상은 물체 자체가 가지고 있는 열로부터 발산되는 원적외선 정보를 센서가 취득하여 영상 정보를 생성하기 때문에 광원체의 여부가 불필요하게 됩니다. 광원체가 불필요하기 때문에 저조도 상황에서도 강인하게 정보를 취득 할 수 있게 됩니다. 다음으로 역광은 주로 헤드라이트나 태양 빛으로 인해 발생하게 됩니다. 헤드라이트와 태양 빛의 파장은 대부분 0.2~2.0um로 자외선~근적외선까지의 파장대의 전자기파로 구성됩니다. 반면에 원적외선은 8um~12um (LWIR 센서 기준으로 분류)로 역광의 원인이 되는 요소들이 가지고 있는 파장과 다른 영역의 파장을 측정하기 때문에 영향을 덜 받게 됩니다.

저조도와 역광 문제에 대해 열화상으로 해결이 가능하다는 점에 대해서는 연구실에 계신 분들도 다 알고 계실 거라고 생각합니다. 이번에 저희 팀에서는 저조도와 역광 외에 안개/연기/스팀(이하; 에어로졸)이 발생한 상황에서도 문제를 해결하고자 합니다. 에어로졸은 물방울, 먼지 입자와 같은 작은 크기의 입자들이 공중에 분포되어 있는 현상을 의미합니다. 이러한 현상들은 가시 영역의 파장들이 영상 센서에 도달하기 전에 차단하거나 난반사 일으켜 노이즈를 야기시킵니다. 이러한 현상들은 가시 영역의 센서 뿐만이 아니라 근거리 깊이 센서와 LiDAR에서도 문제를 일으키는 현상에 해당합니다. 저희는 에어로졸이 발생한 상황을 해결하기 위해 열화상 영상을 이용하고자 합니다. 열화상 영상은 실제로 먼지와 불연소, 연소로 구성된 연기가 발생한 화재 환경에서 시야 확보를 위한 도구로 사용되고 있으며, 저희 팀에서 가시거리 1m까지 안개를 발생시켜 실험을 진행해본 결과, 열화상 영상에서는 강인하게 시각 정보 취득이 가능한 것을 확인했습니다. 이렇게 열화상이 에어로졸 상황에서도 강인하게 동작 가능한 이유도 파장대로 설명이 가능합니다. 앞서 에어로졸 상황에서 문제를 일으키는 가시 영역의 영상 센서와 깊이 센서들이 사용하는 파장은 750nm~950nm이며, 라이다는 길면 1050nm(;근적외선)을 이용하여 시각 정보를 측정합니다. 한 연구 결과에서는 파장대가 길면 길수록 에어로졸의 밀도 높아지는 경우에도 상대적으로 강인하게 작동된다는 연구 결과가 있습니다.(요청하시면 논문 드리겠습니다… 찾아야 함…)

++ 해당 원리를 장애물 피하기로 비교하자면 에어로졸의 밀도가 올라간다는 말은 장애물 수가 증가함을, 사람은 빛으로, 진폭은 사람이 초당 좌우로 반복해서 뛰는 행위라고 가정하고 어떤 진폭이 통과할 가능성이 높을지 생각해 보신다면 이해하시기 편할 것 같습니다.

++ 물론, 에어로졸이 더더더 강해진다면 열화상에서도 노이즈가 발생합니다…

생각을 정리하는 목적으로 작성하다 보니 말이 길어졌네요. 만약에 열화상 센서가 왜 무인 이동체에 필요한지에 대해 설명하기 힘들었던 분들은 제가 정리한 내용이 도움이 되었으면 합니다.

어찌 되었든 저희 팀에서는 원적외선 파장대 이하의 파장으로 측정하는 센서로 시각 정보 취득이 어려운 상황을 해결하기 위해 열화상을 이용하고자 합니다. 이번 무인 이동체는 재난 환경에서 기기를 조작하는 것이 목적입니다. 사람이 타겟인 Multispectral KIAST dataset과는 다르게 대상 물체가 조작을 위한 객체 입니다… 문제가… 측정하기에 충분한 열 에너지를 가지고 있는 객체도 있겠지만 대부분 배경과 구분하기 어려울 정도로 같은 열 에너지를 가지고 있는 경우가 대부분 입니다. 즉… 촬영했을 때… 잘 안보여요…

그래서 영상 품질을 향상 시키기 위해서 해당 논문을 들고 왔습니다. 위에서 풀어낸 이야기 대비 논문 내용은 아주 간단합니다.

Method

먼저, 12~16bit의 열화상에 가우시안 필터를 적용하고 입력 영상을 평활화하여 base image를 생성하면서 저주파 영역에서 대비를 향상시키고 8-bit 영상을 생성합니다. 다음, 입력 영상에서 base image을 빼서 detail image를 생성합니다. 그 다음, 생성된 base image와 detail image를 합하여 향상된 이미지를 얻습니다. 이런 기법을 digital detail enhancement (; DDE)라고 합니다. 추가적으로 저자는 base image와 detail image를 보다 개선시키는 방법을 제안합니다.

+ 영상 정보는 픽셀 값 변화에 따라 주파수 영역으로 변화가 가능합니다. 대체로 주파수 영역의 정보들은 면 정보를 가지고 있으면, 고주파 정보들은 엣지 정보와 같은 디테일한 정보들을 가지고 있습니다. 여기서 표현되는 base image = 저주파 (Low-Frequency; LF) 영상, detail image = 고주파 (High-Frequency; HF) 영상이라고 보시면 됩니다.

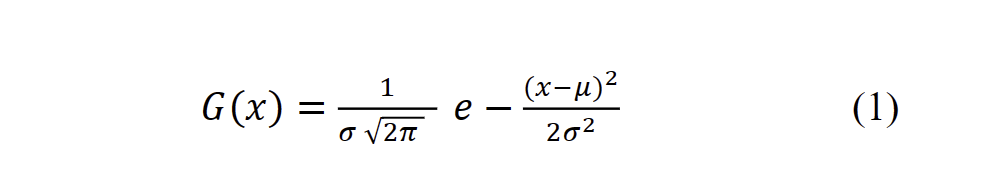

base image와 detail image를 생성을 위해 저자는 가우시안 필터를 이용합니다. 가우시안 필터는 영상을 스무딩하여 노이즈를 제거하기 위해 많이 사용되는 필터로 커널의 크기에 따라 스무딩 정도가 증가합니다. 가우시안 필터에 대한 수식은 다음과 같습니다.

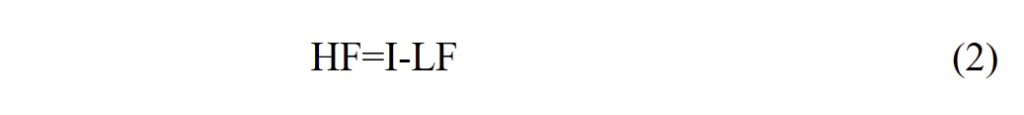

가우시안 필터는 저주파는 통과시키고 고주파는 제거하는 특성을 가지고 있습니다. 저자는 가우시안 필터를 이용하여 저주파 영상 base image; LF를 생성합니다. 그 다음 원본 영상에서 필터링된 영상을 빼면 고주파 성분을 나타내는 detail image; HF를 얻을 수 있습니다. 이에 대한 수식을 아래와 같습니다.

+ 위에 수식에서 보이는 바와 같이 I = LF + HF = G(I) + (I – G(I)) 입니다.

Base image 개선

DDE 연구에서 IR 이미지는 일반적으로 14 또는 16 비트 해상도이고 결과적으로 기본 이미지에는 어떠한 디테일도 포함되어 있지 않으므로 이 단계에서는 적절하게 8비트로 압축됩니다. 이러한 목적을 위해 DDE 연구에서는 일반적으로 히스토그램 투영 방식을 사용하여 동적 범위를 14비트에서 8비트로 줄입니다.

본 연구의 목적은 동적 범위를 8비트로 줄이면서 저대비 base image에서 가능한 최선의 방법으로 대비 향상을 달하는 것을 목적으로 합니다. base image를 개선하기 위해 Adaptive Double Plateau Histogram Equalization(; ADAPHE)를 기반으로 고도화 진행합니다.

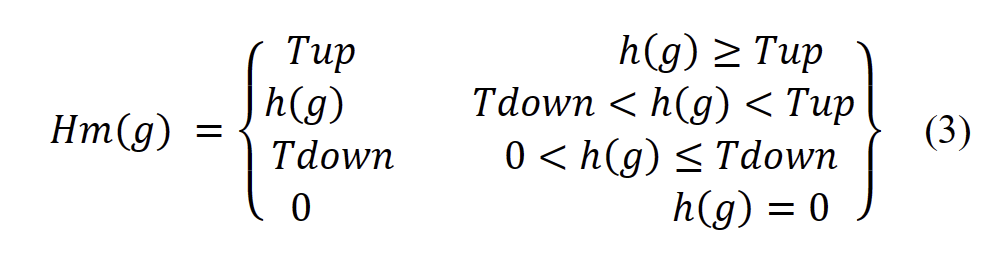

이 접근 방식에서는 히스토그램을 균등화하기 위해 이중 임계값(상한, 하한)이 사용된다고 합니다. 임계값에 따른 base image의 히스토그램 값의 재연산은 수식 3과 같습니다.

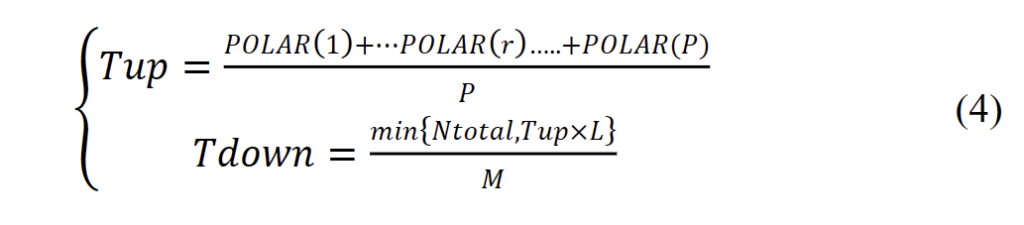

상한/하한 임계값은 위 수식을 통해 적응적으로 결정되며 마지막 단계에서는 ADAPHE을 따는 입력 이미지에 대 히스토그램 평활화를 수행합니다. 여기서 g는 gray level (~픽셀값 + 여기서는 12~16 bit LWIR이기에 픽셀값의 범위는 [0, 2^(12~14)]), h(g)는 입력 이미지의 히스토그램, hm(g)는 두개의 고원 임계값을 사용하여 수정된 히스토그램에 해당합니다. 상한 임계값 Tup과 하한 임계값 Tdwon은 수식 4에 의해 결정됩니다.

여기서 POLAR는 히스토그램의 로컬 최대값에 해당하며, L은 원본 영상의 히스토그램에서 0이 아닌 휘도의 총합에 해당하며, M은 총 픽셀 수에 해당합니다. 이 단계에서는 base image의 대비를 향상시키며 8비트 영상을 얻는 것을 목표로 합니다. base image의 세부 정보가 포함되지 않으므로 최종 이미지의 가장자리와 세부 정보가 손실되지 않습니다. 그 다음, 밝기 정보를 보정하기 위해서 영상에 감마 보정(Gamma Correction)을 적용합니다. 해당 보정은 base image에서 휘도가 높은 영역을 제어하기 위해서 사용합니다.

++ 히스토그램으로 16 bit->8 bit로 변경하는 방법은 아주 단순합니다. 16 bit에 대한 히스토그램 연산을 진행할 때, min-max normalization을 수행해 [0, 1]로 범위를 변경하고 추후에 * 255를 해주면 끝.

++ 모든 연산은 정규화된 상태에서 진행이 되고 마지막에 8비트로 reragnge 해준다고 보시면 됩니다.

Improved Detail image

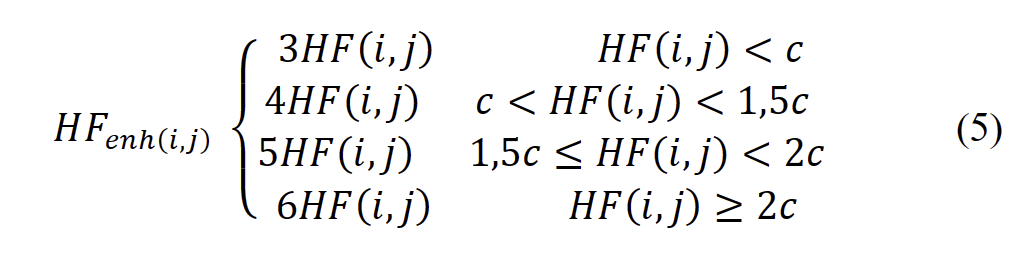

가우스 필터를 이용하여 원본 이미지에서 base image를 뺴서 디테일 성분을 얻습니다. 해당 이미지에서 큰 진폭 값은 강한 가장자리에 해당하고 작은 진폭 값은 약한 가장자리에 해당합니다. 여기서 목적은 점진적인 향상을 적용하여 detail image의 가장자리를 강조하는 것입니다. 자세한 내용은 수식 5에서 볼 수있습니다.

여기서 HF는 디테일 이미지, HF_enh은 개선된 이미지, 계수 c는 디테일 이미지의 표준편차를 의미한다. 표준 편차의 정도에 따라 강도를 강하게 하여 가장자리가 점차 강화되도록 합니다. 이를 통해 강한 에지는 더 강화되고, 진폭이 낮고 노이즈가 발생할 가능성이 있는 엣지는 덜 강화되는 것을 목표로 합니다.

개선 영상 합성

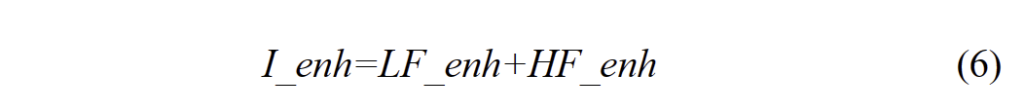

개선된 base image, detail image를 결합하여 개선된 영상을 얻습니다. 이에 대한 수식은 아래와 같습니다.

위 연산이 가능한 이유에 대해서는 수식 2 부분과 관련 내용을 같이 보시면 좋을 것 같습니다.

Experiment

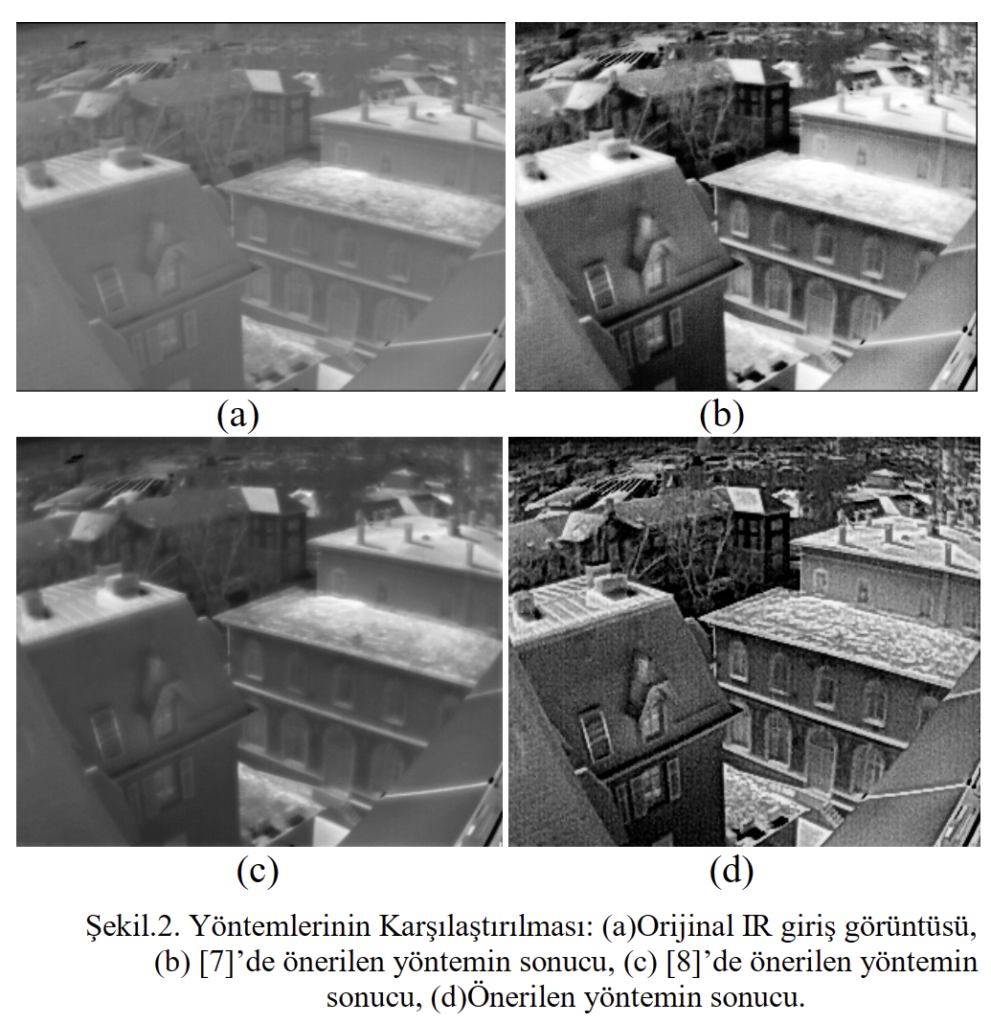

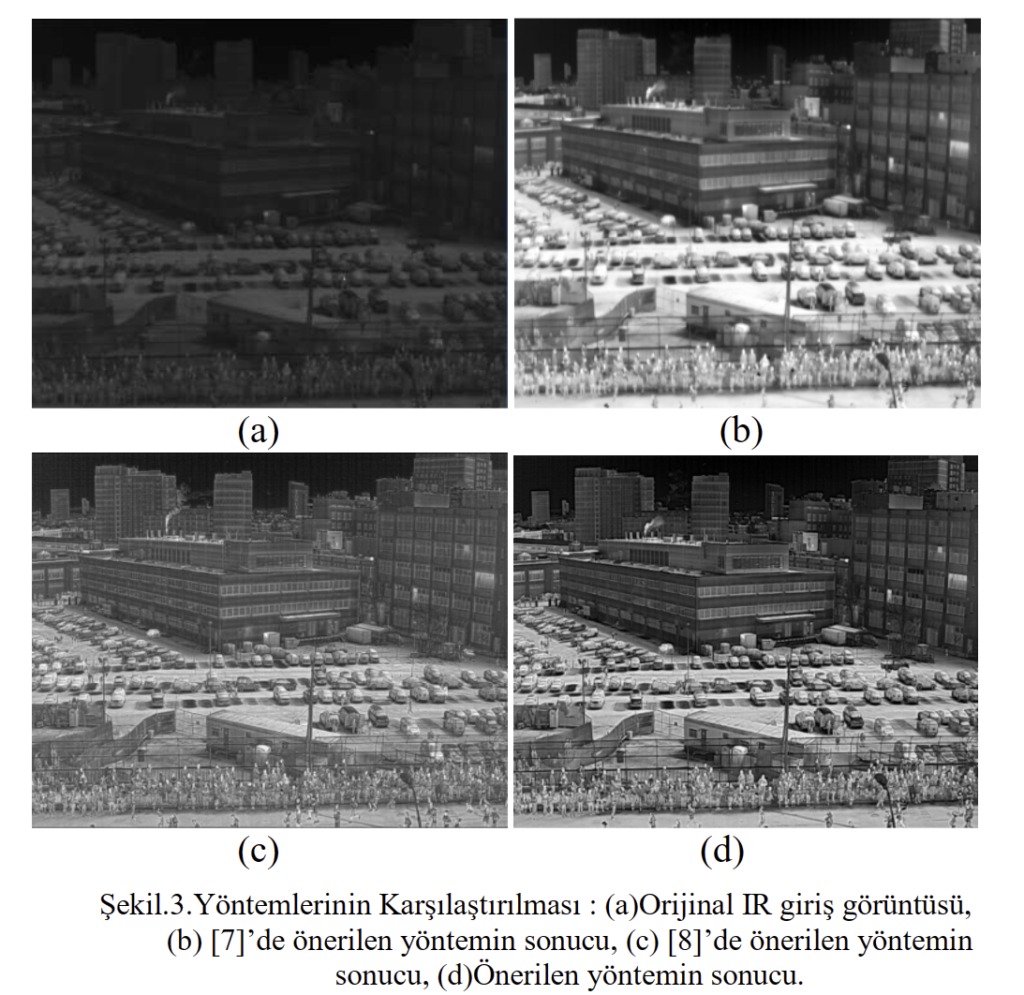

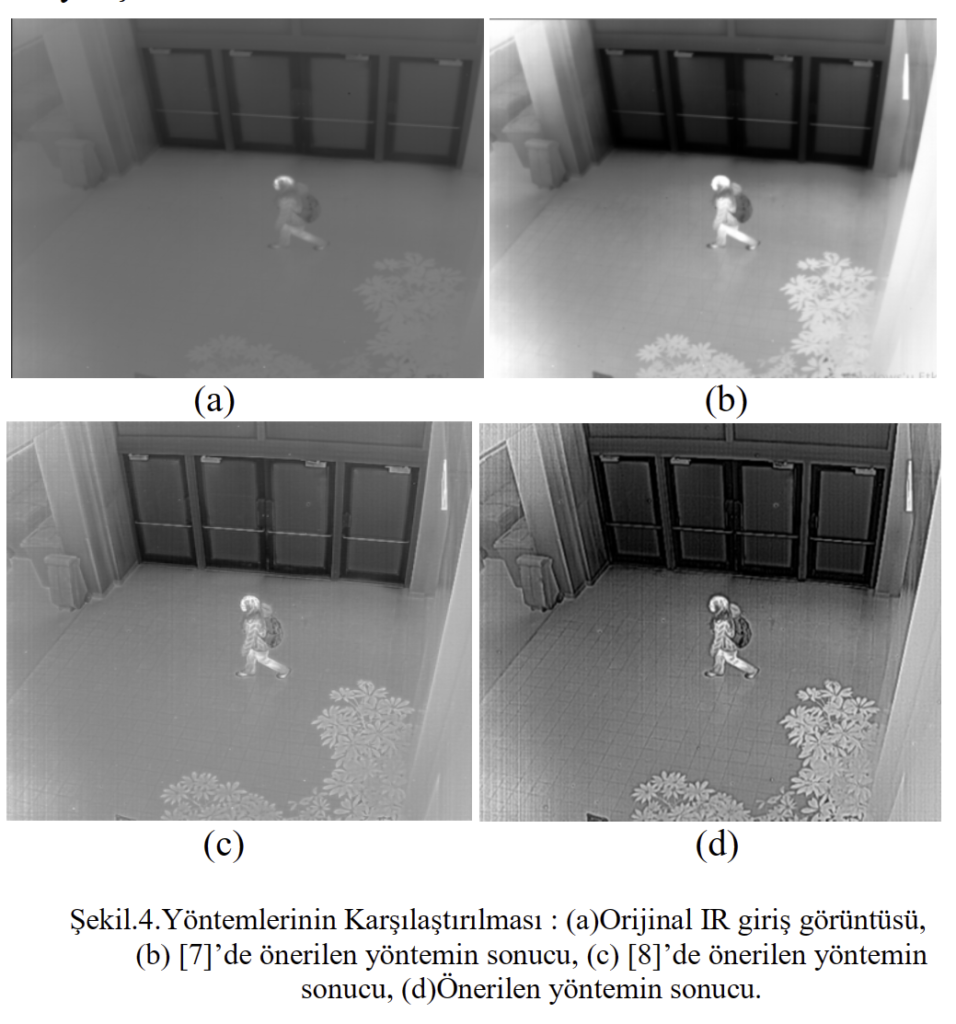

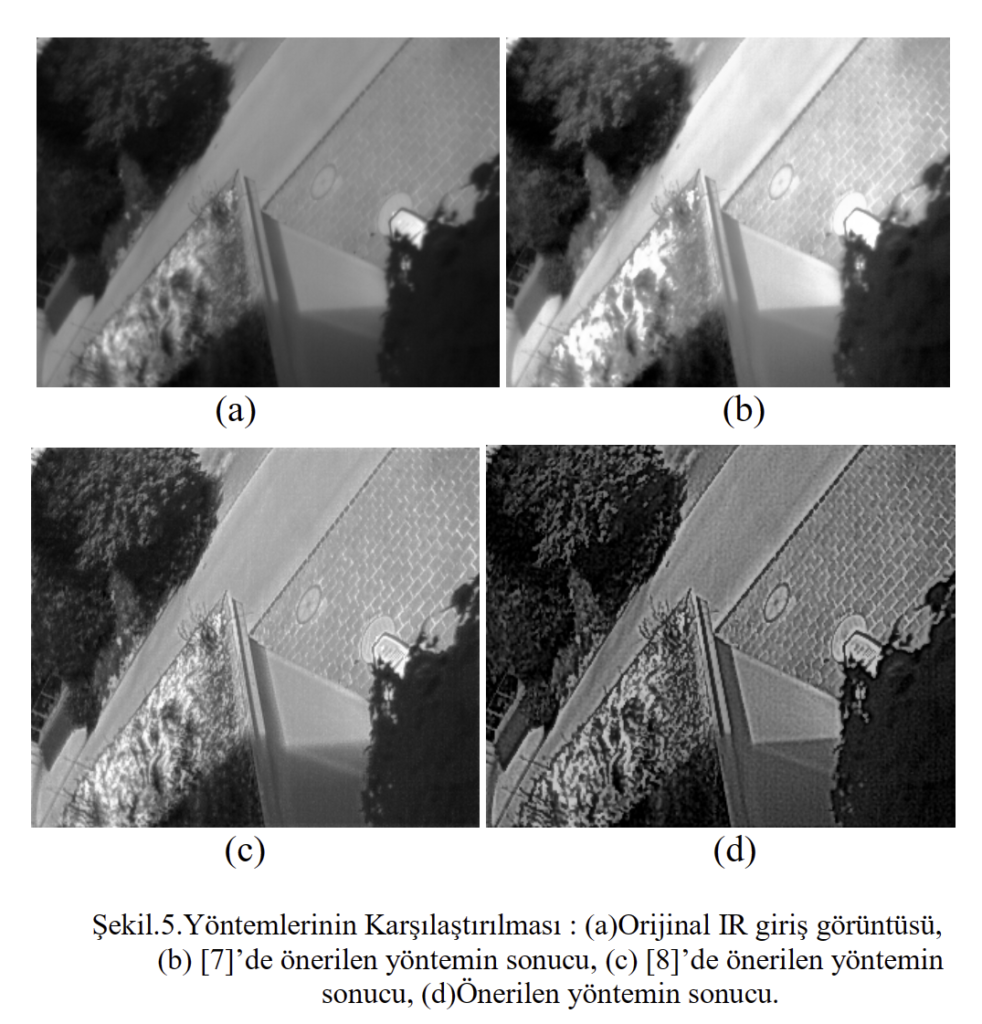

(a)는 원본 영상, (b)는 ADAPHE, (c) detail image에 이진 연산을 통해 개선한 방법, (d)는 제안하는 방법에 대한 정성적 결과 입니다. 정량적인 분석 내용은 아쉽게도 없으며, 아래의 정성적인 분석만 존재합니다. 분석 여부를 떠나 말도 안되는 품질 개선을 보여주는 결과를 보여주고 있습니다.

해당 논문은 터키어로 작성된 논문이라 번역기 돌려가면서 읽느라 힘들었습니다. 유명한 곳이 아닌 곳에 적용된 논문이라 아쉬움이 남았습니다. 조금더 저명한 곳에서 리뷰를 받고 출판된 방법을 선보이고 싶었으나… 아무리 찾아도 딥러닝 기반 위주고 영상 처리 기법은 잘 안보이네요… 뭐 어찌되었든 해당 방법을 베이스로 RGB에서 영상 처리 최근 기법을 적용해볼 예정입니다. (e.g. Gaussian-Adaptive Bilateral Filter) 시간이 남는다면 해당 논문을 구현한 코드도 같이 적어두도록 할게요.

안녕하세요 ! 좋은 리뷰 감사합니다.

디테일 이미지를 향상시킬 때 두 픽셀 값의 표준편차가 클수록 강도를 강하게 줌으로써 가장자리를 강화시키는데 여기서 노이즈가 발생할 가능성이 있다는 것은 어떤 의미인가요?? 단순히 표준 편차가 작으면 노이즈가 발생할 가능성이 크다고 정의하는 것인지 궁금합니다.

추가적으로 정성적인 결과들을(d) 보면 입력 이미지인 (a)보다 선명해진 영상이기는 하나 반대로 입력 영상에서는 없었던 줄들이 생기면서 추가적인 노이즈가 발생한 것으로 볼 수도 있지 않나 .. 생각이 드는데 이러한 영상이 품질 개선이 되었다고 평가된 것이라면 본 논문의 목적은 흐릿했던 원본 영상 내의 특징들을 두드러지게 강조시키는 것에 초점을 맞췄다고 이해해도 될까요?

마지막으로 지금은 base image와 detail image를 단순 픽셀 레벨로 합성한다고 이해했는데 혹시 각 이미지에 대한 가중치를 다르게 주어 결과를 뽑아내는 ablation study는 없었는지 궁금합니다.

감사합니다 !

Q1. 디테일 이미지를 향상시킬 때 두 픽셀 값의 표준편차가 클수록 강도를 강하게 줌으로써 가장자리를 강화시키는데 여기서 노이즈가 발생할 가능성이 있다는 것은 어떤 의미인가요?? 단순히 표준 편차가 작으면 노이즈가 발생할 가능성이 크다고 정의하는 것인지 궁금합니다.

A. HF가 클 수록 엣지일 확률이 강하고 낮을 수록 면일 가능성이 높습니다. 강함의 정도를 구분하기 위해서는 기준점이 필요합니다. 저자는 그 기준점을 표준편차로 사용하였고, 별다른 설명은 없었습니다. (개인적인 생각으로 표준편차를 기준점으로 잡은 건 별로인 것 같아요)

‘단순히 표준 편차가 작으면 노이즈가 발생할 가능성이 크다고 정의하는 것인지 궁금합니다.’은 무슨 말인지 이해를 못했슴다…

Q2. 추가적으로 정성적인 결과들을(d) 보면 입력 이미지인 (a)보다 선명해진 영상이기는 하나 반대로 입력 영상에서는 없었던 줄들이 생기면서 추가적인 노이즈가 발생한 것으로 볼 수도 있지 않나 .. 생각이 드는데 이러한 영상이 품질 개선이 되었다고 평가된 것이라면 본 논문의 목적은 흐릿했던 원본 영상 내의 특징들을 두드러지게 강조시키는 것에 초점을 맞췄다고 이해해도 될까요?

A. 잠재된 표현력을 강화시키는 방법이다 보니 노이즈는 발생할 수 밖에 없는 것 같습니다. 그래서 알고리즘의 뒷단에서 디노이징을 수행해줍니다.

흐릿했던 원본 영상 내의 특징을 두드러지게 강조시키는 것이 메인이라기 보단 12-16bit -> 8bit로 변화하면서 소실되어져 버리는 정보들을 시각적인 정보들이 잘 담는 방향으로 인코딩하자는 컨셉이 좀 더 맞는 표현 같습니다.

Q3. 마지막으로 지금은 base image와 detail image를 단순 픽셀 레벨로 합성한다고 이해했는데 혹시 각 이미지에 대한 가중치를 다르게 주어 결과를 뽑아내는 ablation study는 없었는지 궁금합니다.

감사합니다 !

A. ablation study는 없슴다. 이미지 별 가중치 주고 가하면 수식이 성립되지 않슴다. 가중합을 이야기하신 것 같은데… 흠… 해봐야 알 것 같아요.