4 종류의 스펙트럼 카메라(Visible, NIR, MIR, FIR) 를 이용해 촬영한 데이터셋 논문 입니다.

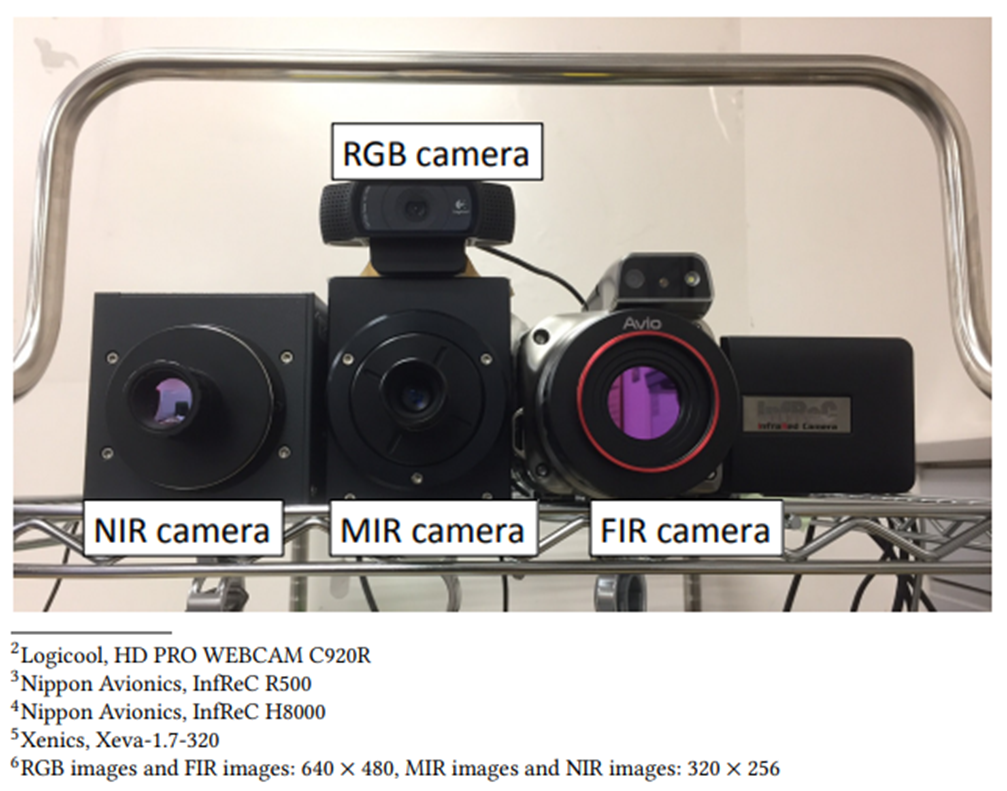

굉장히 투박해 보이지만 RGB, NIR, MIR, FIR 파장을 촬영할 수 있는 막강한(?) 다중 스펙트럼 카메라 세팅입니다. 다만 보시는것과 같이 저렇게 데이터셋을 촬여하면 각 카메라간의 View Point는 어떻게 해결할 수 있을지 굉장히 의문이 들텐데요.. 저또한 이러한 이유로 해당 논문을 읽게됐으며, 결론부터 말씀드리면 2017년 논문으로 가장 기본적인 방법을 사용하였습니다.

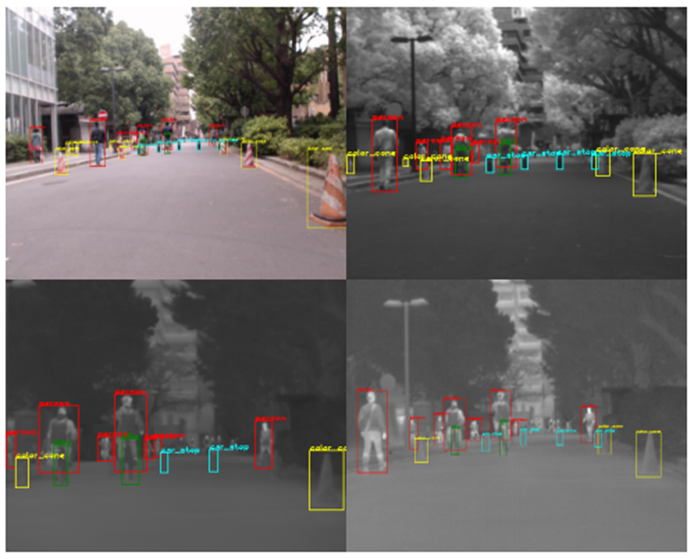

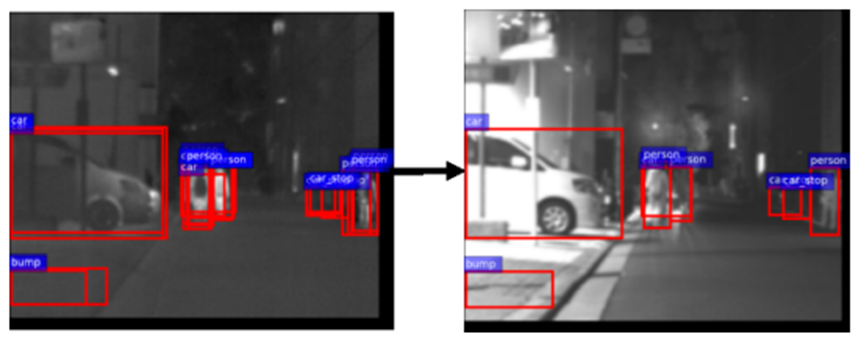

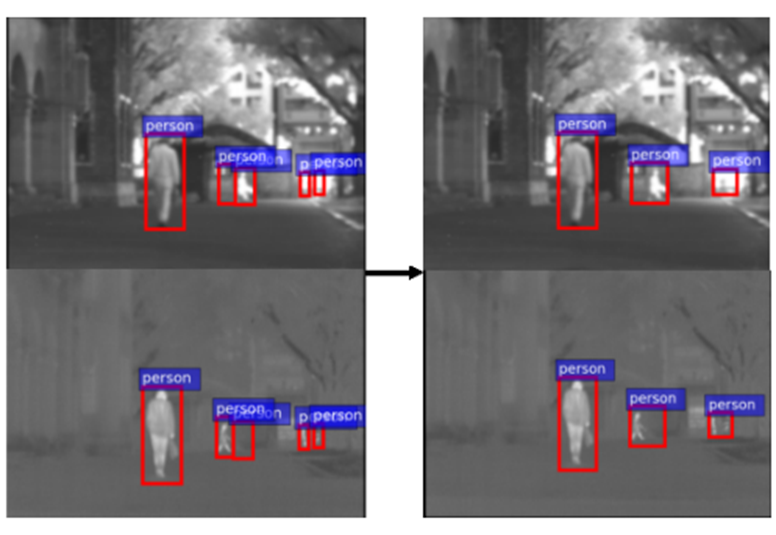

( 위의 카메라 세팅으로 촬영한 데이터셋입니다. 예상하듯 뷰포인트가 모두 다르게 촬영된것을 확인할 수 있습니다.)

Datasets

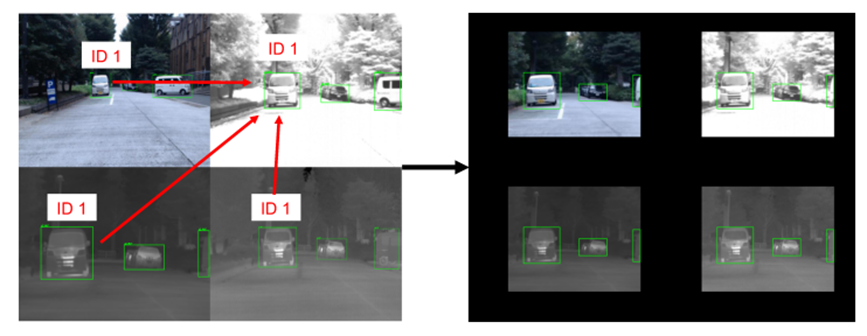

해당 연구에서 서로 다른 파장의 카메라의 이미지 정합을 위해 사용한 방법은 바로 사람이 직접 수동으로 어노테이션을 수행하며, 이때 각 박스마다 ID를 적용하여 바운딩된 박스와 ID를 가지고 하나의 좌표(논문에서는 NIR을 기준)로 모두 변형합니다. 이때, 아래 그림과 같이 Homography matrix를 사용하게 되는데 단순히 H-matrix로는 온전히 와핑이 진행되지 않을 수 있습니다. 그럼 이러한 것들은 어떻게 했을까요?

위의 그림과 같이 실제 와핑을 수행하여도 얼라인이 안맞는 영상들이 존재하는데, 이러한 영상들에 대해서 저자는 다음과 같이 이야기합니다.

Of course, this alignment method cannot align images completely; hence, the authors visually reviewed the converted images and chose 1,446 images whose alignments are correct as test images and 1,553 images whose alignments are incorrect as training images for the experiment using six channels.

결국 사람이 직접 얼라인을 맞는것들을 선별하여 test 데이터셋으로 사용하고, 잘 안맞는 데이터셋은 학습데이터로 사용했다고 합니다. (여기서 6채널은 R, G, B, NIR, MIR, FIR 6개 채널이며 YOLO에 입력을 6채널로 변경한 모델을 이야기합니다.) 이외에도 중복된 박스와 작은 박스들은 합치는 과정을 추가적으로 수행했다고 합니다.

Methods

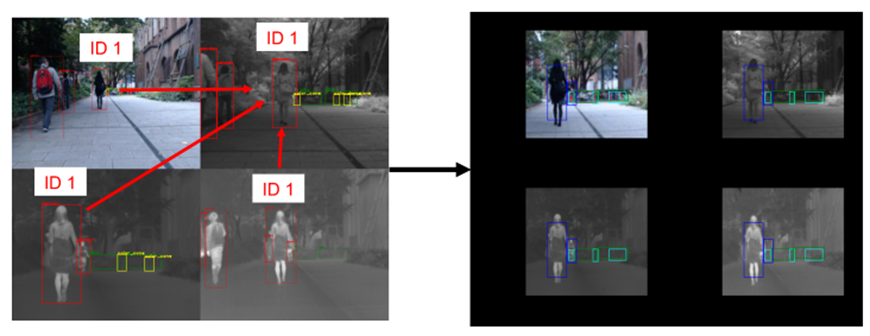

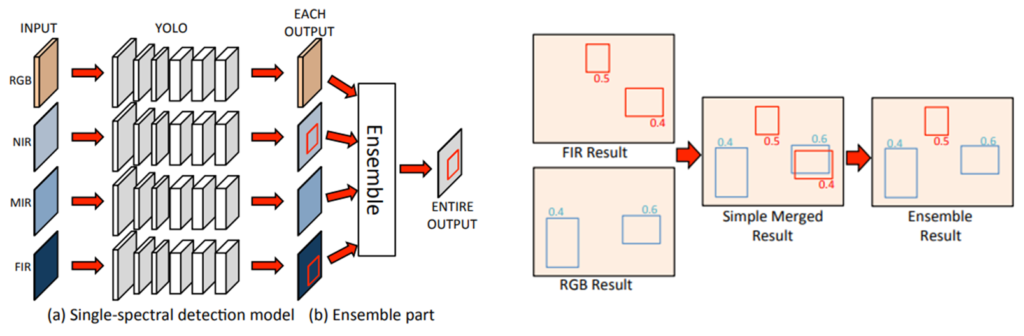

자 그렇다면 해당 논문에서 결론적으로 제안하는 방법은 무엇일까요? 아래 그림으로 한번에 이해할 수 있습니다.

각각의 스펙트럼에 따라서 YOLO를 따로 Finetune 하고, 이를 통해 나온 결과물들을 IOU를 기준으로 앙상블 하는 것이 해당 논문에서 제안하는 방법입니다. 그리고 저자는 각각의 스펙트럼에 따라 YOLO를 따로 학습 시킨 이유에 대해서 다음과 같이 이야기합니다.

In this paper, authors used YOLOv1, as the object detection model. RGB, FIR, MIR, and NIR channels were trained separately using the original. This is because it is thought that the proposed method can fully uses the features of each spectral image by learning on objects visible on each spectrum. Then, The output results from the four single-spectral detection models are combined.

각 스펙트럼 특징을 온전히 사용할 수 있다는데… 어떻게 보면 MLPD에서의 논리와 비슷하네요.

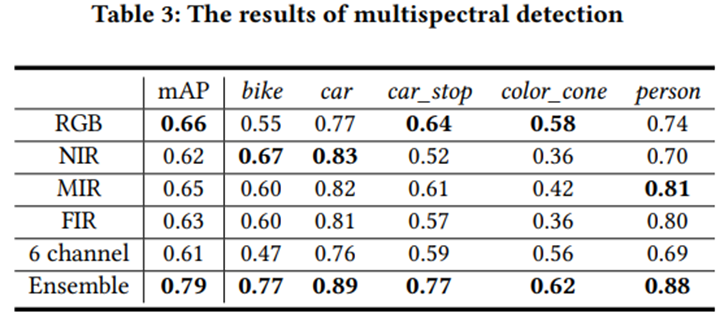

Experiments

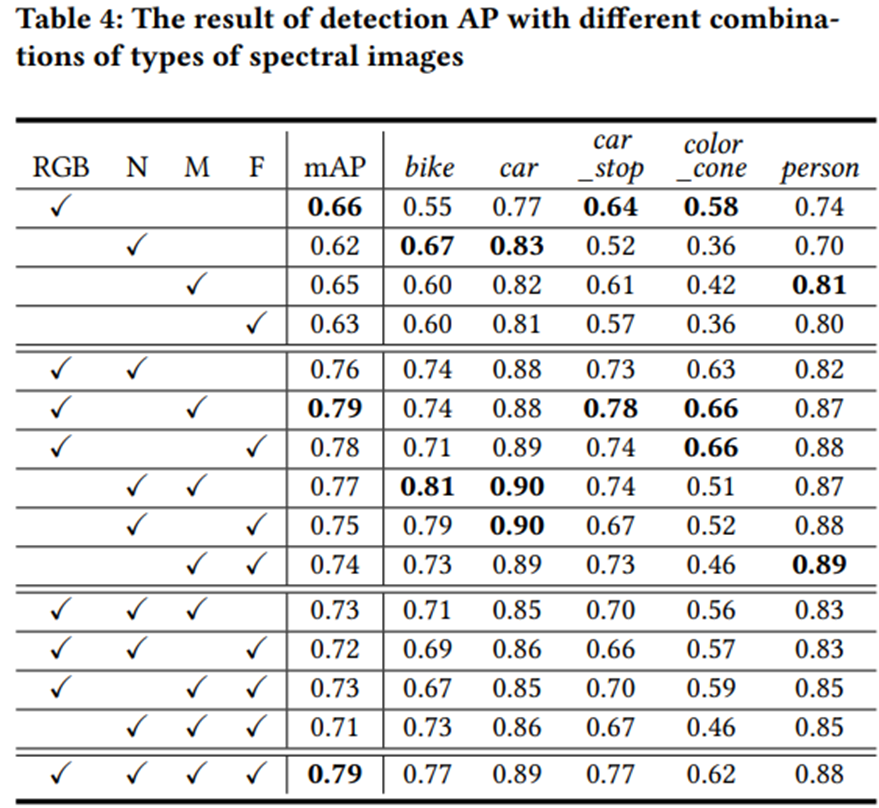

최종적으로 모든 스펙트럼을 합쳤을 때, 가장 성능이 좋다고 저자는 이야기합니다. 또한 각 모달리티를 어떻게 섞을 때 성능이 좋은지도 실험을 수행하였는데… 해당 실험은 솔직히 어떤 의미가 있는지 모르겠습니다.

Conclusion

다중 스펙트럼 원본 영상을 제공하고 있어서, 해당 데이터셋을 이용해 현재 진행중이 연구에 적용해보려고 시도하고 있습니다. 그래서 해당 논문을 읽게 됐습니다.

동기화 방식에 대해서는 따로 설명이 없나요?

넵