https://arxiv.org/pdf/2104.02904.pdf

ICCV2021에 제출된 Carnegie Mellon University에서 나온 Multispectral Pedestrain Detection 논문입니다. 본 논문에서 이야기하는 것들이 저희 IEEE RAL에 도움이 될 것 같아 읽었습니다.

시작하기에 앞서…

https://newsight.tistory.com/46

https://bioinformaticsandme.tistory.com/47

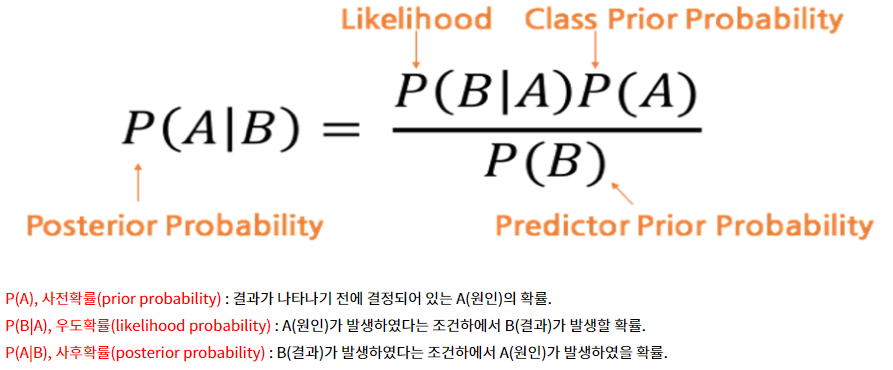

본 논문에서 베이지안 이론에 대해서 이야기합니다. 베이지안 이론에 대해서 헷갈리시는 분들은 위에 링크를 참고하시면 됩니다.

Intro

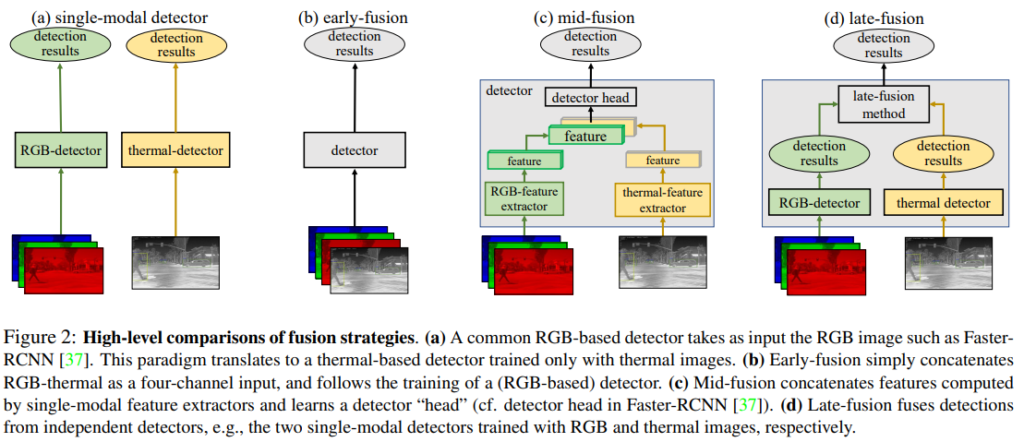

Multi-spectral pedestrian Detection을 수행하기 위해서 정말 많은 네트워크들이 제안됐습니다. 위에 그림처럼 단순히 Single modal detector도 존재하구요. Early fusion, mid fusion(Halfway fusion), late fusion 등이 존재합니다.

(이번에 저희가 제출한 MLPD의 경우 Mid-Late Hybrid Fusion에 가깝겠네요.. Multi Feature를 Fusion하는 동시에 마지막에 평균을 이용해 Score fusion도 수행하고 있으니..)

본 논문에서 제안하는 방법은 베이지안 이론을 기반으로한 very lately fusion 입니다.

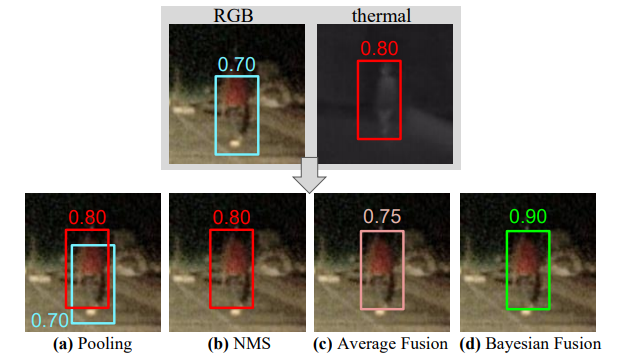

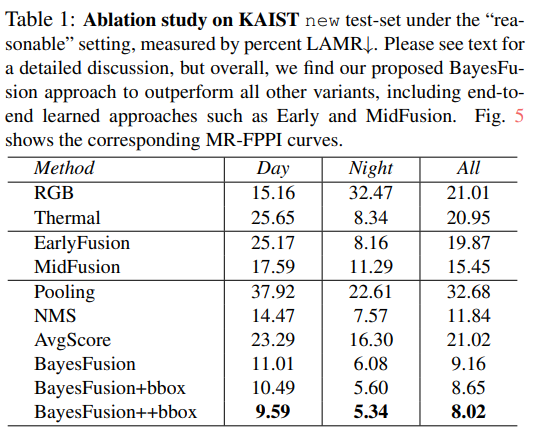

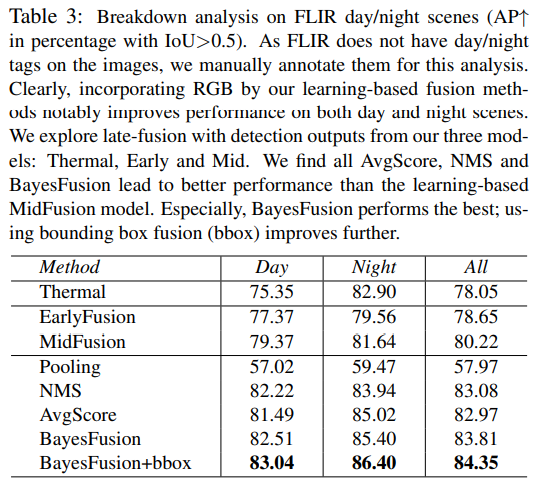

위의 그림과 같이 기존에 두개의 독립적인 모델을 가지고 Pooling, NMS, Average Fusion을 수행할 수 있지만, 논문에서는 학습이 필요없는 Bayesian Fusion을 수행했다고 합니다. 그리고 이게 Key contribution입니다. (추후에 MLPD에서 score fusion하는 단계에서 이를 적용해도 될것 같습니다.)

Probabilistic Bayesian Fusion

*조건부 독립이란? 조건부 독립 (Conditional independence) : P(A,B|C) = P(A|C)*P(B|C) 으로 표기 조건부 독립. A와 B 사건은, C사건 하에서는 서로 독립이다. 줄여서 CI라고도 한다.(다른 D사건의 전제하에해서는 독립일 수도, 아닐 수도 있다.) 이때 그냥 A와B는 서로 독립이 아님. 왜냐하면 서로 C를 통한 연관성이 있기때문. 그러나 C가 일어난 상황에서는 A,B를 서로 독립이다. 왜냐하면 모든 연관성이 C에게 있기 때문에, C가 일어난 상태에서 A와B는 서로간의 연관이 없다.

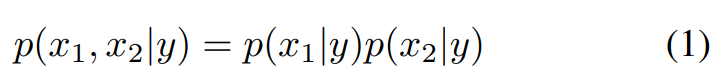

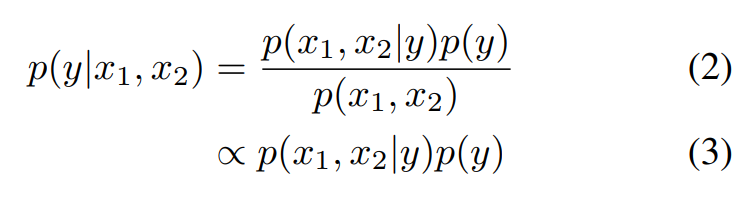

class(예를들면 person) label을 y라고 하고, RGB appearance를 x1 thermal appearance는 x2라고 합니다. 이때 x1은 x2와 조건부 독립(Conditional independence) 합니다.

*베이지안 확률이란? 종속적 관계에 놓인 사건들을 기반으로 확률을 구함. 두 확률 변수의 사전 확률과 사후 확률 사이의 관계를 나타내는 정리.

Multispectral pedestrian detection에 이를 적용해서 나타내면 다음과 같습니다.

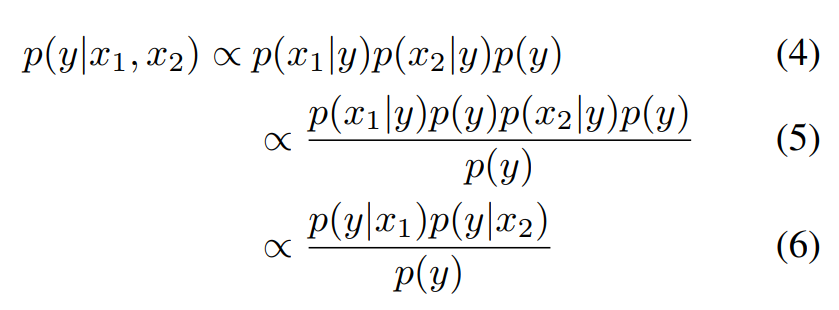

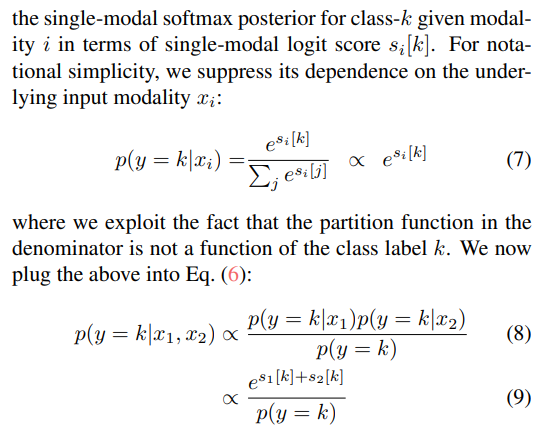

위에 베이지안 확률에 적용하여 A는 y(예를들면 person), B는 x,y(RGB,thermal)이 됩니다. 그리고 여기서 ‘ ∝ ‘는 비례함을 이야기합니다. (당연히 분수니까 분자에 비례하고 분모에 반비례하겠죠?) 3번식을 앞서 언급한 조건부 독립 식(1)에 대입하면 다음과 같은 식을 얻을 수 있습니다.

이러한 단순화한 베이지안 확률값은 싱글 모달리티 피처가 true object label에 conditionally independent일때 최적이라고 합니다. 따라서 본 논문에서는 single modal classifier를 따로 학습시켜서 p(y|x1), p(y|x2)를 따로 예측한다고 합니다. 또한 최종 socre는 class prior distribution으로 나눈 두(RGB,Thermal) distribution의 곱하고, 합이 1이되도록 normalizing을 한다고 합니다.

(뒷부분에 대해서 조금더 설명하는데… 잘 이해가 안되고 있어서 좀 더 확인해보고 업데이트 하겠습니다…)

Experiments

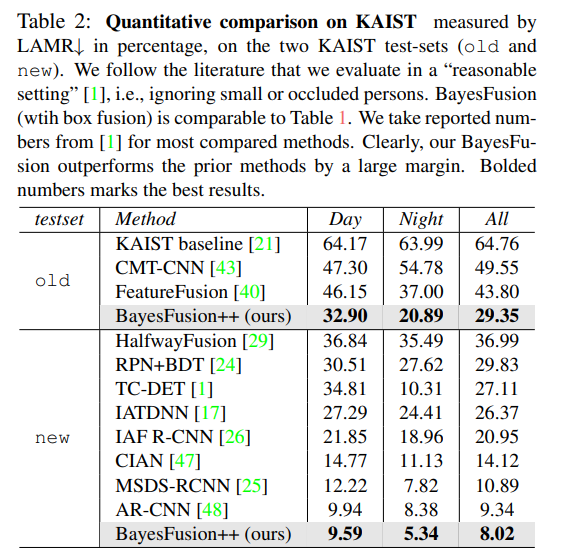

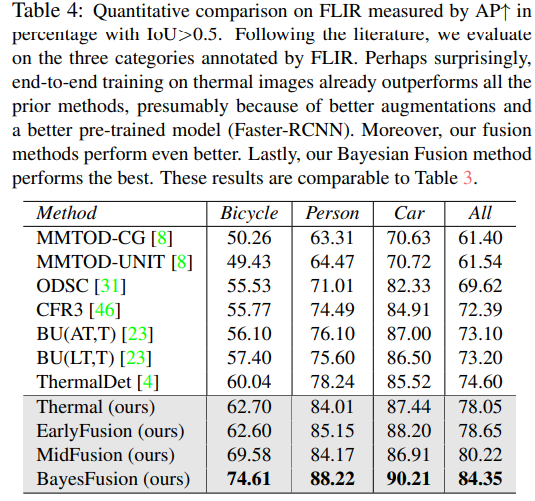

KAIST와 FLIR 모두에서 좋은 성능을 나타냈다고 이야기하고 있습니다.

음… 제가 읽고 이해하기로 해당 논문의핵심은존 NMS나 Average를 취하는 방식으로 중복된 바운딩박스를 제거하는 방식보다, 해당 논문에서 제안하는 방식이 좀 더 좋다.

위에 컨트롤+엔터 눌렀더니 댓글이 바로 달아져서 다시 이어달아요.

음… 제가 읽고 이해하기로 해당 논문의핵심은

1. 기존 NMS나 Average를 취하는 방식으로 중복된 바운딩박스를 제거하는 방식보다, 해당 논문에서 제안하는 방식이 좀 더 좋다.

2. 트레이닝할때, thermal 데이터없이 학습을 하고, test할때는 thermal을 사용하는 앙상블 같은 느낌으로 사용

이게 맞나요?

베이지안 룰 기반의 late fusion을 수행하여 좋은 성능을 나타냈고 이때 베이지안 룰 기반 방법은 추가적인 학습을 요하지 않는다고 합니다. 멀티모달에 대해서 fusion방법을 제안한 논문입니다.

RGB 와 Thermal 를 각각 Predict 하고 제안하는 베이지안 퓨전을 이용해서 좋은 bbox를 고르겠다는 거 같은데, 그림 그 단일 네트워크는 뭐썼나요..?

detectron2에서 제공하는 Faster RCNN을 사용했다고 합니다.