IITP 연구노트 작성을 위한 우울증 논문 리뷰입니다. 금일 리뷰를 진행할 논문은 지난번 리뷰했던 논문에서 사용한 AVEC depression dataset 데이터셋을 이용한 우울증 예측 논문입니다. 참고로 2018년에 나온 논문입니다.

Introduction

AVEC 데이터셋은 다양한 직장의 피실험자를 대상으로 다양한 방법의 대면-비대면 인터뷰를 수행한 데이터셋 입니다. 해당 데이터셋은 인터뷰에 참가한 피실험자의 PSTD나 우울증 정도를 포함하고 있어, Visual based 우울증 예측을 위한 연구에 많이 사용되고 있습니다.

다양한 데이터를 통해서 우울증의 정도를 예측하기 위해서 많은 연구가 이뤄지고 있으며, 얼굴에서 나타나는 정보를 통해서 우울증을 예측하려는 연구도 그 중 한 부류입니다.

스마트폰 센서를 통해서 우울증을 예측하려는 저희 연구실의 IITP 과제 목표와는 조금 다를 수 있지만, 결론적으로 멀티모달 센서 데이터를 통해서 우울증을 예측하기때문에 큰 범주에서 같은 분야라고 생각했습니다. (아마도 해당 연구는 전자부품연구원(?)에서…?)

자 그럼 다시 논문으로 돌아와서 해당 논문이 있기전에 다양한 논문들에서 얼굴정보를 통해서 우울증 정도를 예측하려는 시도가 있었습니다. 그리고 그러한 연구들은 대부분이 피처를 추출하고, 추출된 피처를 통해서 Regerssion을 수행하는 방향으로 이뤄졌습니다.

이전의 대부분의 연구들은 피처 추출단계에서 더 강인하고 불변한 피처를 얻기위해서 성별, 나이, 자세, 조명 등의 정보들이 포함해 피처 모델링을 수행하였습니다. 따라서 기존의 연구들은 expertise knowledge에 강하게 의존하는 특징이 나타났습니다.

앞선 방법은 ‘피처를 어떻게 추출해야하는가?’에 대한 연구라면 ‘어떻게 모델을 학습해 Regression을 수행해야하는가?’에 대한 연구도 많이 이뤄졌고, Learning-based 연구에서는 sparsity, compactness, nonlinear hierarchy를 통해 더 높은 정확도와 강인한 Regression을 위한 연구가 이뤄졌다고 합니다.

어떻게 피처를 잘 추출할지에 대한 연구(hand-craft based) 혹은 어떻게 잘 Regression을 수행할지에 대한 연구(learning based) 이외에 딥러닝 기반의 연구도 이뤄졌지만, 아주 소수의 연구뿐이였다고 합니다.

본 논문은 딥러닝 기반으로 우울증 정도 예측을 위한 연구를 수행하였고, Facial image를 통해서 우울증 정도를 자동으로 예측하는 DepressNet을 제안하고 있습니다. 특징으로는 Regression 성능이 높을 뿐 아니라 모델이 우울증을 예측하는데 있어 얼굴의 어떤 부분이 활성화 되는지 Activation Map을 나타내 visual-based depression recognition에 새로운 인사이트를 제공했다고 합니다.

DepressNet

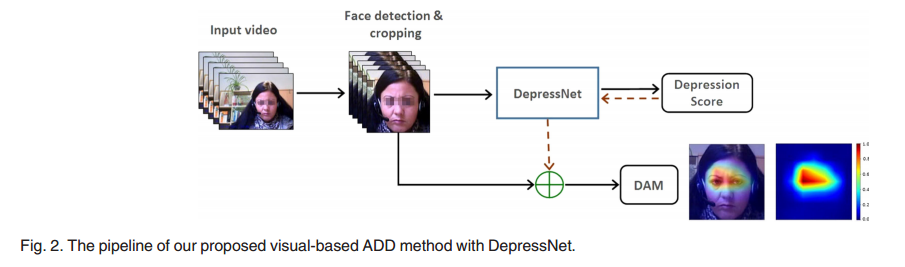

위의 그림은 본 연구에서 제안하는 DepressNet-based ADD(Automated Depression diagnosis) 스키마 입니다. 가장 먼저 비디오 입력이 주어지면 얼굴만 검출하여서 Crop을 수행합니다. 그리고 얼굴을 Crop한 3차원의 얼굴 영상들을 DepressNet에 입력으로 주어 Depression Score를 계산하게 됩니다. 본 연구에서 백본으로는 CASIA-WebFace 데이터셋으로 학습된 ResNet50을 사용하였다고 합니다.

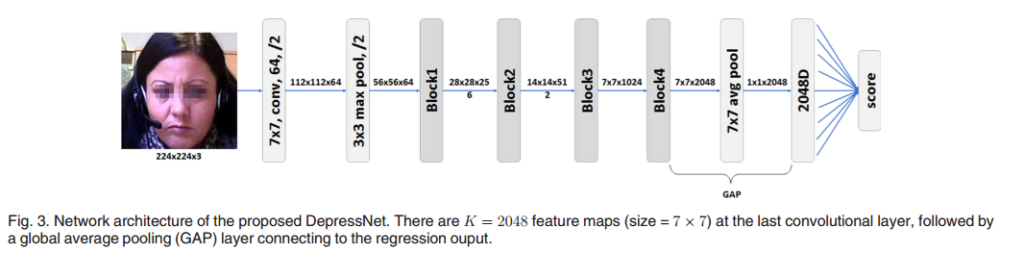

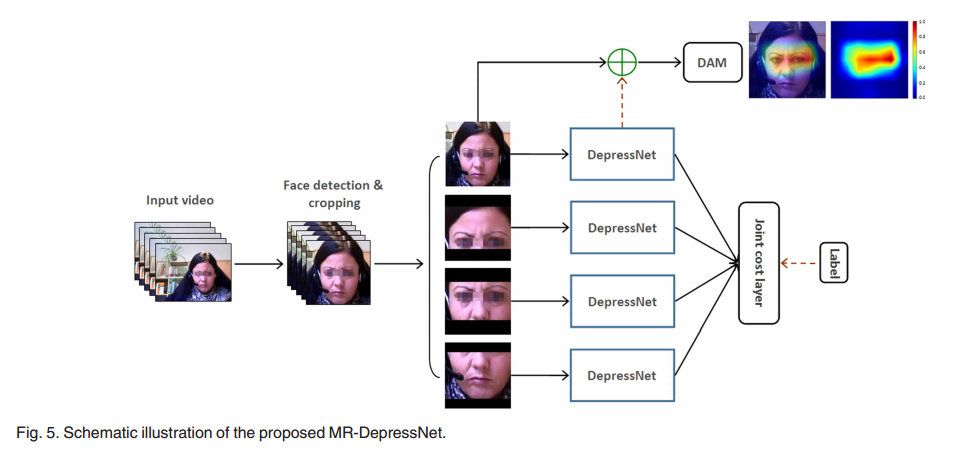

DepressNet 의 아키텍처는 위의 그림과 같으며, GT는 실제 데이터셋에서 제공하는 우울증 점수를 사용했다고 합니다. 이러한 DepressNet에 추가적으로 본 연구에서는 Multi-Region DepressNet을 제안합니다. 이는 얼굴의 여러 구역을 나눠 입력해 좀 더 풍부한 정보를 통해서 우울증 예측이 가능하도록 모델을 변경하였다고 합니다. 구조는 다음과 같습니다.

Experiments

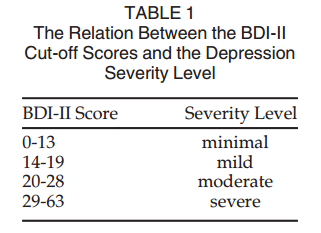

실험에는 AVEC2013,2014 데이터셋이 사용됐습니다. 해당 데이터셋에는 우울증 정도에 대한 점수가 있는데, 각 점수에 따른 우울증 정도는 다음과 같이 나눌 수 있습니다.

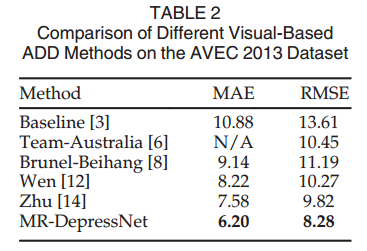

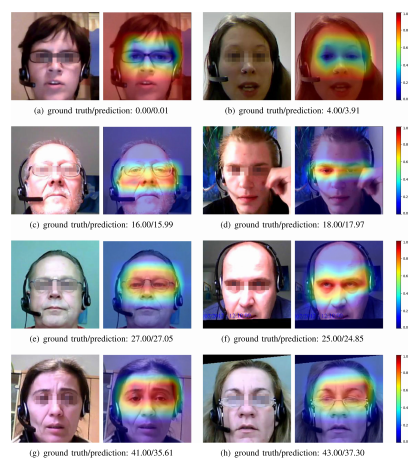

자 그럼 본 논문에서 제안하는 모델은 결국 우울증 점수를 Regression 하는 모델 입니다. 따라서 평가 지표로 MAE와 RMSE를 사용합니다. 일단 해당 평가 지표를 통한 결과는 다음과 같습니다.

표에 나타난 방법들은 실제 Visual based로 예측을 수행했던 논문들의 성능이며, 본 논문에서 제안하는 MR-DepressNet이 가장 높은 성능이 나타남을 확인할 수 있습니다. 여기서 베이스라인은 해당 데이터셋을 공개한 저자가 처음 이야기한 성능을 의미합니다.

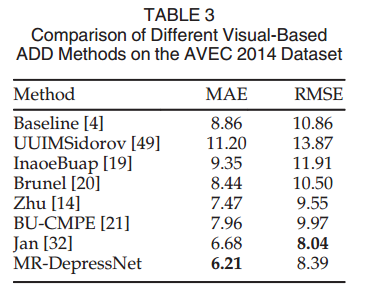

실제 저자는 성능을 높이기 위해서 다양한 실험도 함께 수행하였습니다.

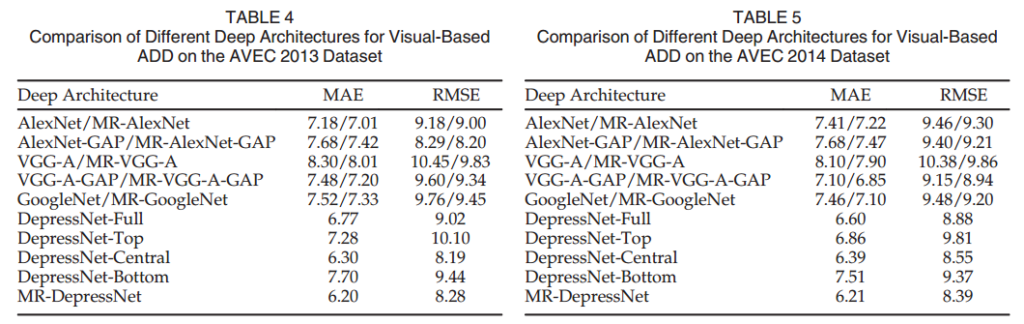

대표적으로는 백본을 다르게 설정하기도 하였고, 얼굴의 어떤 부분을 Crop해서 모델에 입력으로 줄 때(Full,Top,Central,Bottom) 성능이 가장 좋은지도 실험해 결과를 나타내고 있습니다. 그리고 마지막으로 실제 모델이 우울증 점수를 예측하는데 있어서 어떤 부분이 활성화 되는지 CAM으로 확인합니다.

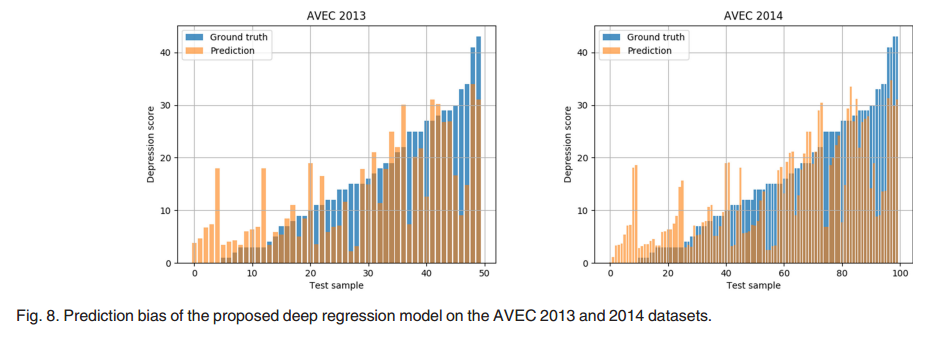

실제 모델의 성능은 앞서 MAE와 RMSE를 통해서도 나타냈지만, 각 test 셋에 대해서 실제 우울증 점수와 모델이 예측한 점수를 그래프로도 나타냈고, 다음과 같습니다.

나만의 결론

Computer Vision이 사용됐지만, 많이 아쉬운(?) 논문입니다. 하지만 해당 논문 이후에 Visual based Depression Regression관련 연구가 많이 이뤄졌고, 실제 그 논문중 하나를 읽다가 해당 논문도 읽어서 리뷰를 진행하였습니다. (이후 나온 논문은 따로 리뷰를 작성하겠습니다.) CAM을 보면 알겠지만, 사람의 눈이나 시선 정보가 우울증에 그래도 어느정도의 상관관계를 나타내는 것 같습니다. (이를 이용해서 설문조사 과정에서의 아이트래킹을 수행해서 새로운 피처를 만들어보면 어떨까 생각을 하게 됐습니다.)

끝.

리뷰 잘 읽었습니다.

질문 드리고 싶은게, 먼저 학습 및 inference 시간에 대해 DepressNet과 MR-DepressNet을 비교한 내용이 있을까요? DepressNet을 4개나 붙였으면 생각보다 모델이 무거울 것으로 보이는데, 성능에 대한 차이는 실험 결과를 통해 보았으니, 속도도 보고 싶네요.

해당 분야에서는 실시간 검출이 필요하지 않으므로 고려대상이 아니라고 생각합니다. 실시간 우울증 검출이 목적이 아닌 ‘정확한’ 우울증 검출이 목표여서 속도는 고려되지 않습니다.

리뷰 감사합니다.

혹시 실험 결과의 분석이 있는지 궁금하네요. (실제로 눈 근처를 보는게 우울증 분석에 도움이 된다 라던가 어떠한 경향 분석이 있나요?) 눈 근처의 CAM이 확실하게 활성화 되는것이 인상적이였습니다.

그런데 그것이 비디오여서 입부분은 인터뷰에 있어 움직임이 있기때문에 feature로 선택되지 못한것이 아닐까 하는생각이 들어 위의 질문을 하게 되었습니다!

또 비디오 입력이 있으니 제스쳐나 움직임같은 데이터도 이용하는 것도 우울증 예측에 좋지 않을까 하는데, 그런 방향의 연구가 있을까요? 아니면 간단한 예측이여서 그렇게 복잡한(?) 모델을 원치 않는 경향일까요?

해당 논문에서는 이미지 기반 우울증 예측에 있어서 CAM을 통해 새로운 인사이트를 제공한다 이외에 다른 분석은 없습니다. 아마도 의학분야이기 때문에 해당 내용에 대한 해석은 의학적인 지식이 기반되 정확한 예측이 필요합니다. (그냥하는 추축은 의학적으로 아무런 의미가 없습니다.) 따라서 해당 논문에서도 의학적으로 어떠한 추측 및 분석을 수행하지 않습니다.

그리고 두번째로 입부분은 Feature로 추출되지 못했다고 이야기하셨는데, 해당 논문의 결론부분에 제가 기술하였듯 실제 얼굴의 다양한 부분을 Crop 해서 사용하고 결과를 리포팅하고 있습니다. 따라서 딥러닝 모델이 그나마 우울증을 예측하기에는 가장 활성화된 부분이 눈인것 같습니다.

비디오 입력이 있으니 제스쳐나 움직임 같은 데이터도 이용한다고 말씀하셨는데, 이번 IITP에서 저희가 아닌 다른 연구소에서 하는 내용이 해당 내용입니다.