RCV연구실에서 두번째 참여하는 KCCV2020 리뷰를 시작하겠습니다. 가장 기억에 남았던 논문들 위주로 작성하였습니다.

1일차

RGBD-Dog : Predicting Canine Pose from RGBD Sensors

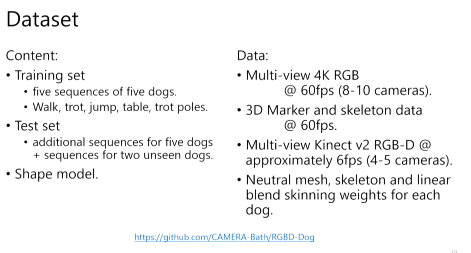

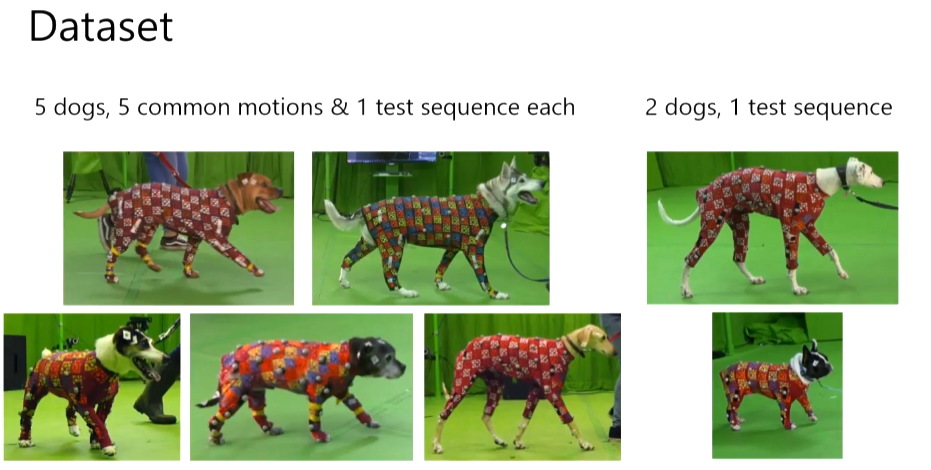

해당 연구는 UNIST 김광인 교수님 연구실에서 진행한 연구이다. 해당 발표에서 김광인 교수님은 개의 Canine Pose를 예측하는 연구의 과정들을 소개하셨다. 해당 연구의 메인 Contribution은 종류도 크기도 다양한 강아지의 POSE를 Prediction하기위한 데이터셋을 구축이다.

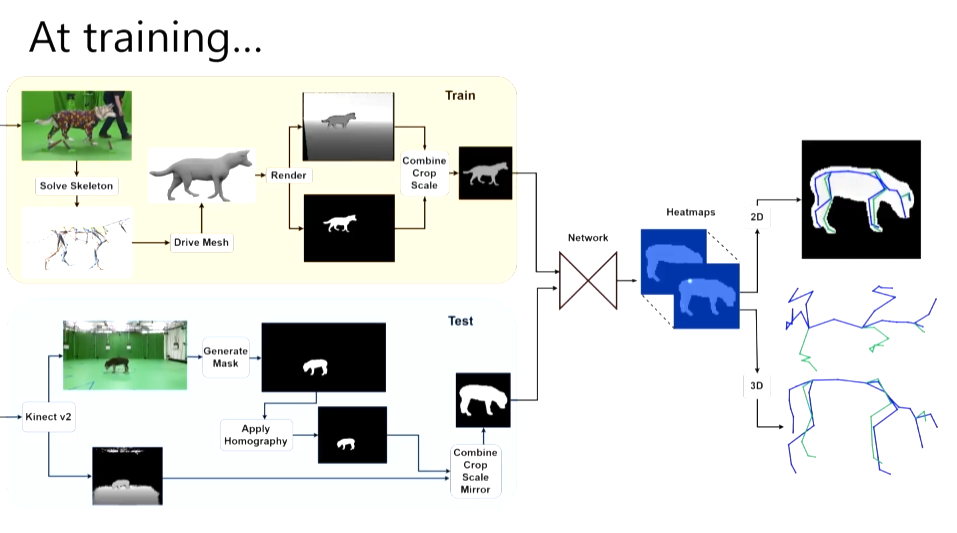

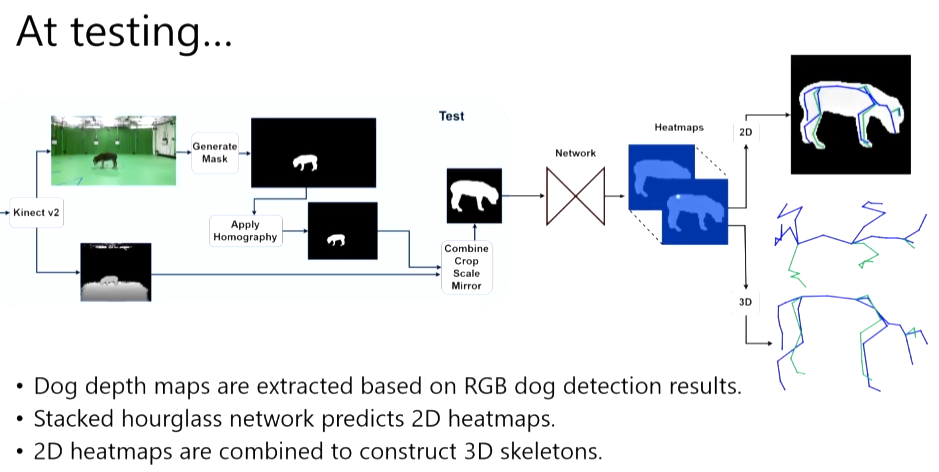

해당 연구실에서 개의 Pose를 Estimation 하기위해서 학습과정에서는 Depth map과 RGB이미지 모두가 사용된다. RGB이미지를 통해서 segmentation을 수행하고 해당 segmentation과 Depth map을 align한 이후에 Depth map을 crop해서 네트워크에 입력으로 사용했다고 한다. 하지만 이러한 네트워크 학습에 사용될 데이터셋은 기존에 존재하지 않았고, 네트워크 학습을 위해 직접 데이터셋을 구축했다고 한다.

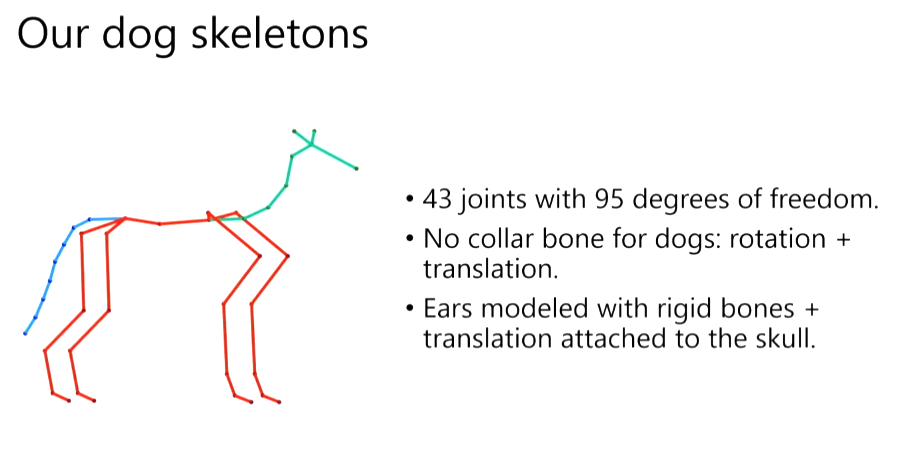

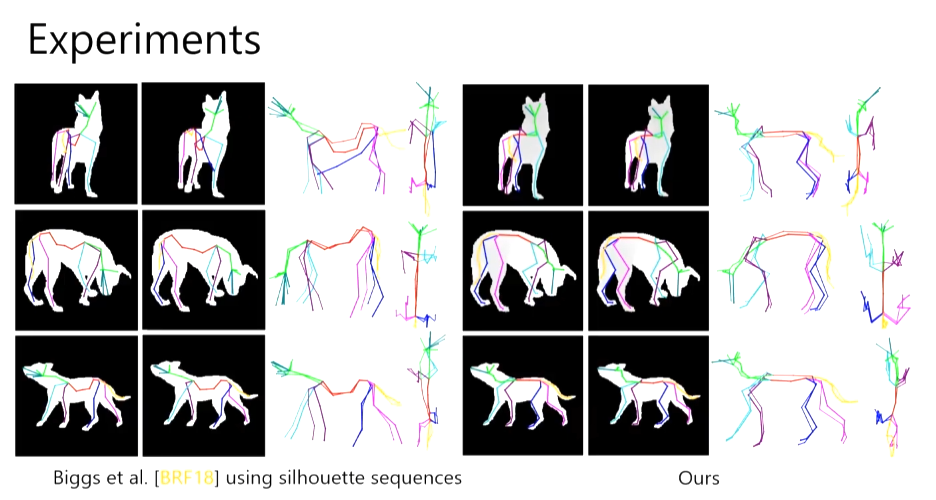

데이터셋 구축 과정에서 기존 사람과 같은 Skeletons 을 설정하고 꼬리만 추가하면 되겠다고 생각했지만, 실제 적용시 전혀 작동하지 않았고, 개에 맞는 skeleton을 설정해야했다고 한다. 따라서 위의 그림같이 새로운 skeleton을 정의했다고 한다.

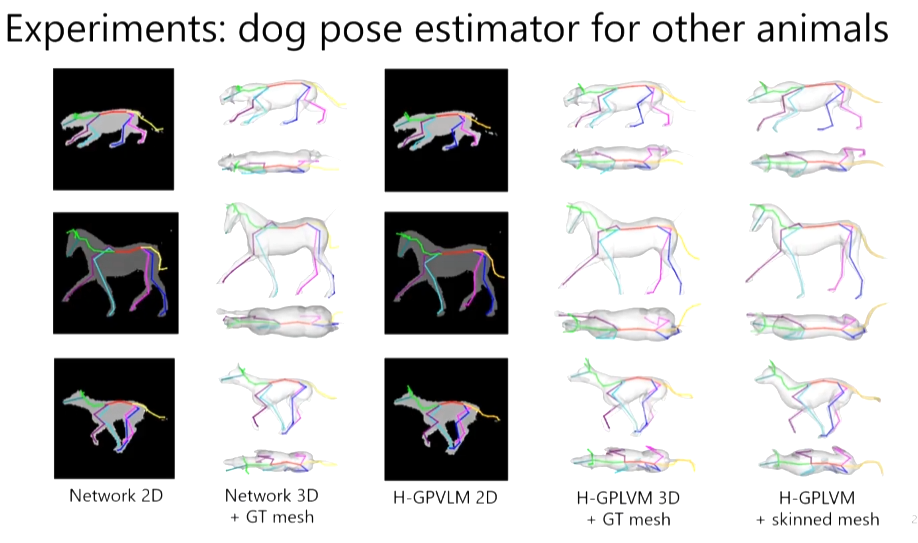

다음과 같이 데이터셋을 구축하고 실제 해당 데이터셋을 기반으로 새로운 방법론도 제안하여 다음과 같은 결과를 얻었고, 이를 개뿐만 아니라 4족 보행의 다른 동물로 확장였을때도 준수한 결과를 얻을 수 있었다고 한다.

정리하면, 해당 발표를 들으면서 실제 기존에 없는 데이터셋을 구축하는데 있어서 많은 메이저 학회들이 얼마나 인정해주는지 다시한번 느낄 수 있었고, 데이터셋을 구축하는 과정의 어려움 그리고 구축된 데이터셋을 사용하는 감사함을 느낄 수 있는 발표였다. 해당 발표가 기억에 남는 이유는 최근 본 영화인 ‘콜오브와일드’라는 영화를 봐서 더욱 기억에 남는것 같다.

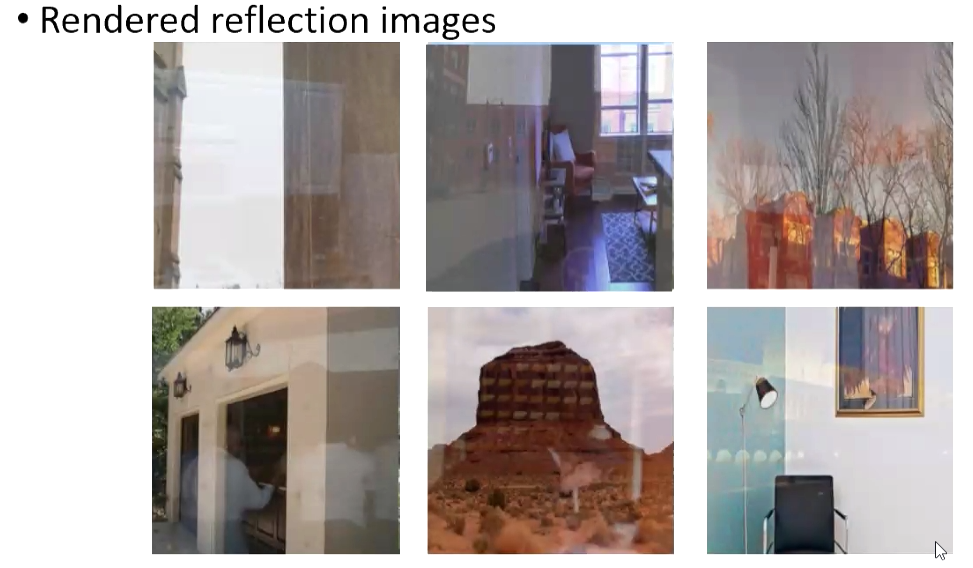

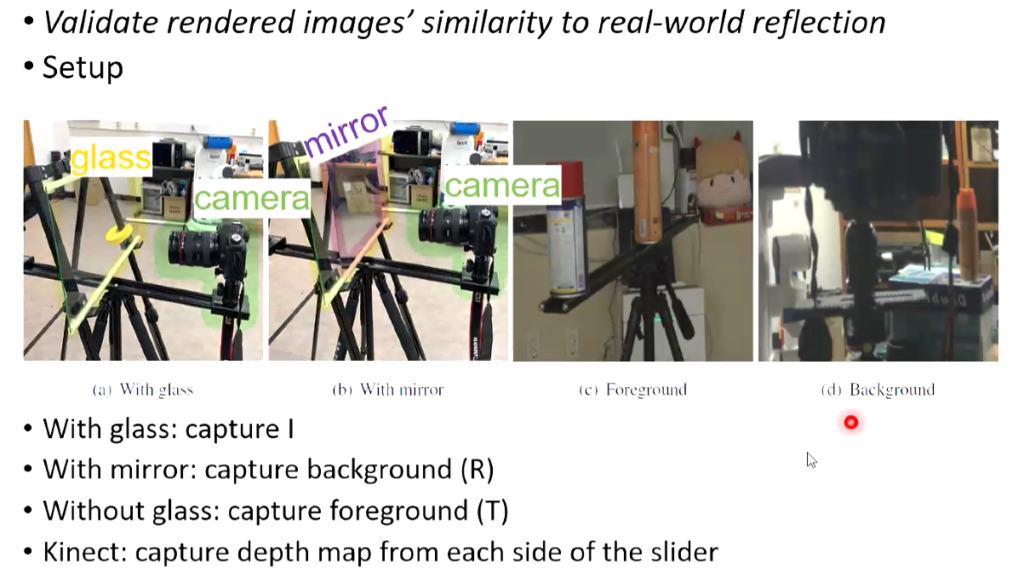

Single Image Reflection Removal with Physically-Based Training Images(CVPR)

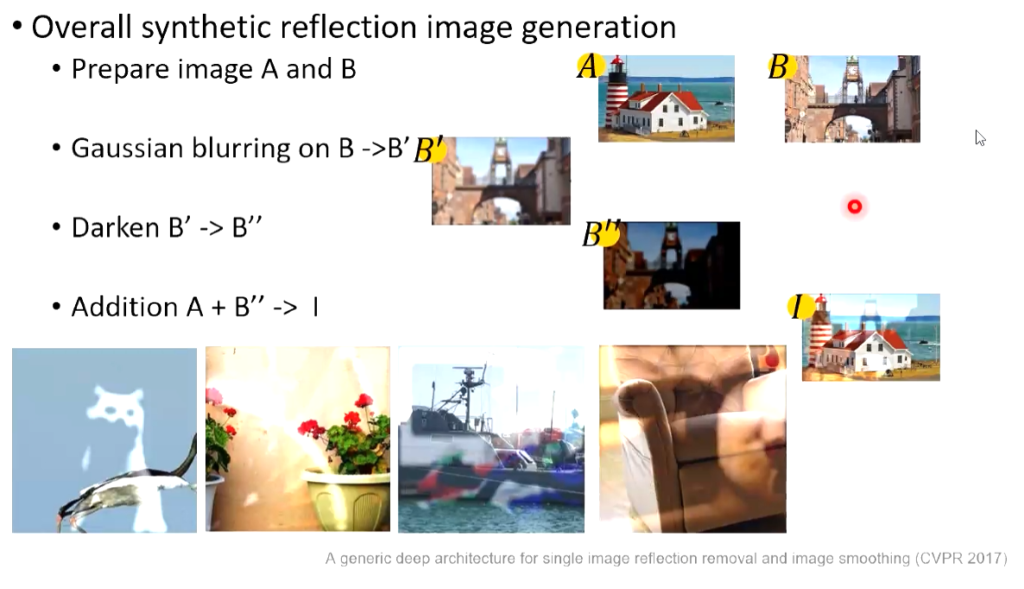

해당 논문은 유리(창) 맞은편 객체를 사진촬영할 때 나타나는 반사효과를 제거하는 방법에 대한 연구이다. 아래그림에서 왼쪽 영상을 오른쪽으로 만드는 연구이다.

이를 딥러닝으로 해결하려면 결국 데이터셋이 필요하다. 따라서 데이터셋 구축을 위해서 기존에 다음과 같은 방법들이 사용됐다고 한다.

하지만 이러한 데이터셋들은 실제 현상을 정확히 반영하는데 한계가 있다고 말하며 이를 해결하기 위해서 물리 기반 (뎁스가 추가된) 의 렌더링을 한 데이터셋을 구축하셨다고 한다.

렌더링을 위해서 실제 전경화 배경을 찍을수 있는 카메라 시스템을 만들고 촬영된 전경과 배경을 가지고 제작했다고 한다.

Better to Follow, Follow to Better: Towards Precise Supervision of Feature Super-Resolution for Small Object Detection

해당 논문은 지난주 리뷰에서 진행하여 추가적으로 설명하진 않는다.

기타 다른 좋은 논문도 많았지만 첫날 가장 인상깊었던 논문들은 위와 같습니다. 첫날 제가 경험한 가장 핵심은 학회에서 새로운 데이터셋을 구축에 대해서 크게 인정 해준다는 점 입니다.

2일차

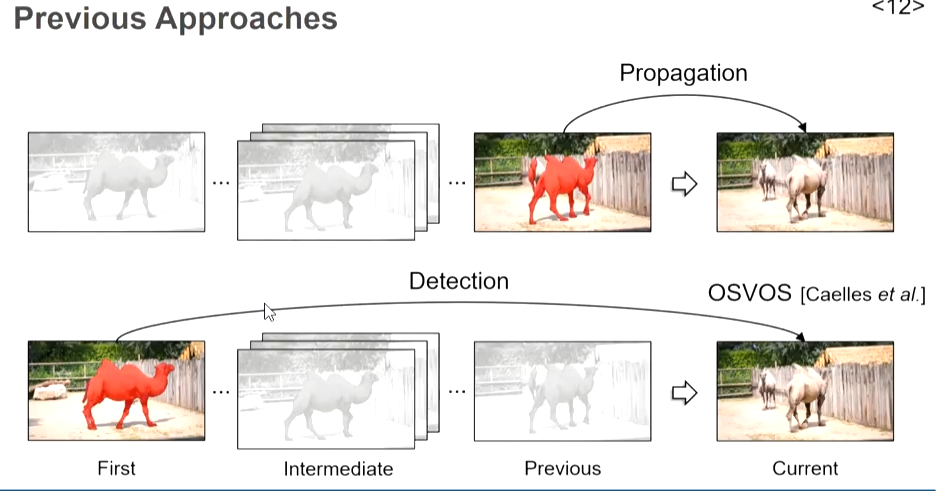

Video Object Segmentation Using Space-Time Memory Networks

일단 동영상을 보고 시작하자.

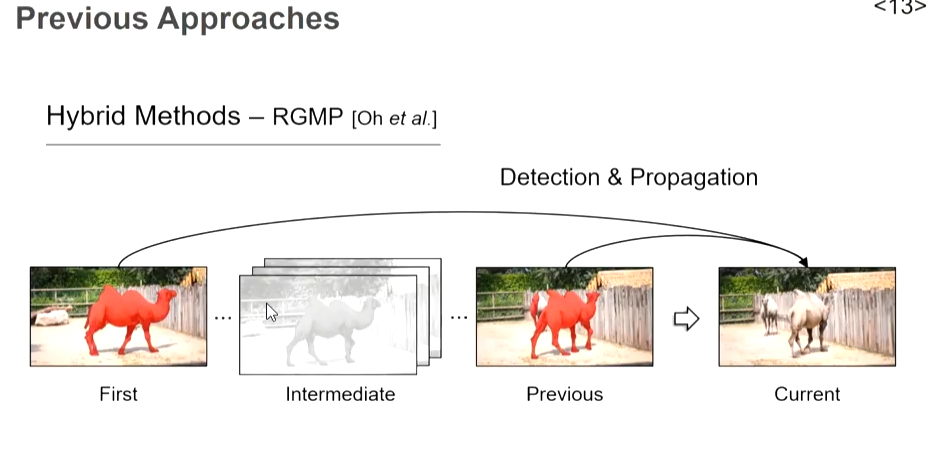

해당 연구는 비디오에서 Object를 segmentation 하는 연구이다. 비디오에서 어떤 Object를 Segmentation할 때, 그리고 Supervision이 있다고 할때 기존 연구들은 전 프레임 혹은 첫 프레임에서 Object를 선택하고 해당 정보를 통해서 이후 동영상의 Object를 연속적으로 Segmentation했다고 한다.

또다른 연구는 전프레임과 첫프레임을 가지고 연구를 수행했다고 한다.

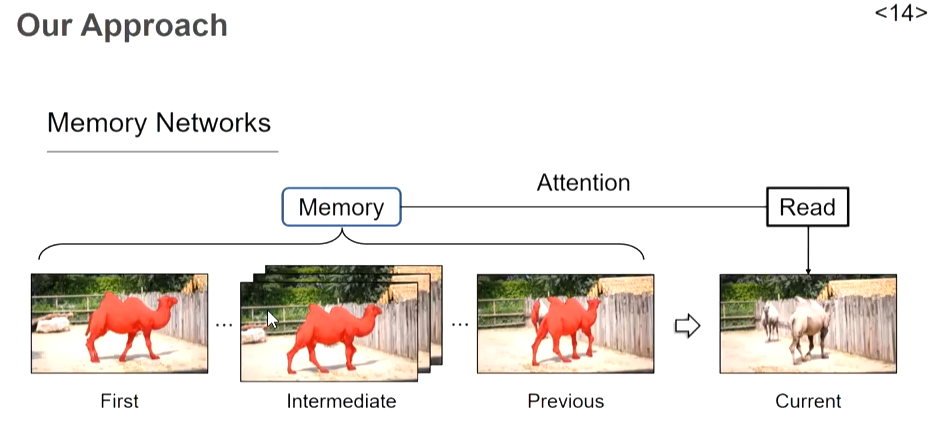

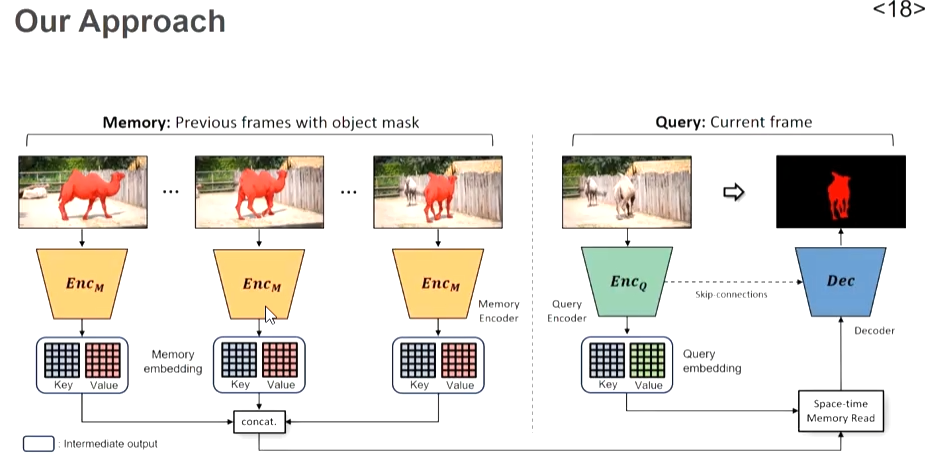

해당 연구는 첫 프레임, 이전 프레임이 아니라 이전에 모든 프레임을 사용할 수 없을까? 라는 아이디어에서 진행하였다고 한다.

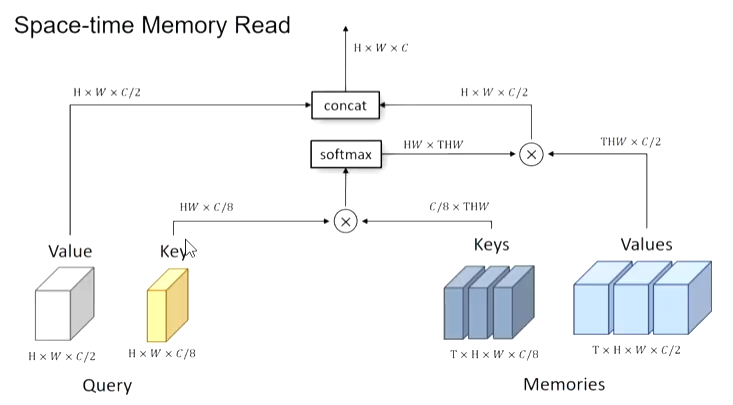

그리고 이 방법에는 Visual Question Answering (VQA)에서 사용되는 Memory라는 것을 적용하였다고 한다. CVPR2018 에서 발표되었던 “non-local neural networks “와 흡사한 네트워크를 설계하여 이전 프레임들을 해당 논문에서의 self-attention과 같은 역할을 하도록 만들었다는 점이다.

결론적으로 해당 분야에서 가장 좋은 성능을 나타냈고, 발표내내 김선주 교수님은 정말 간단한 네트워크임을 강조하시면서 다른 Task에서 사용하던 방법을 Video segmentation 분야에서는 전혀 사용하고 있지 않아 처음으로 적용했다고 이야기하셨다.

이 발표를 들으면서 다른 분야의 논문도 계속적으로 팔로우업 하는 것에 대한 중요성, 그리고 다양한 분야를 경험하는 것이 반드시 도움이 되겠구나라는 생각을 하게 됐다.

OmniSLAM: Omnidirectional Localization and Dense Mapping for Wide-baseline Multi-camera Systems

해당 논문에 대해서도 지난번 리뷰를 진행했던 내용이라 따로 설명하진 않겠다.

3일차

마지막날은 발표 준비로 자세히 다른 발표들을 듣지 못하였다… 다만 기억에 남는 것은 기업소개내용인데..

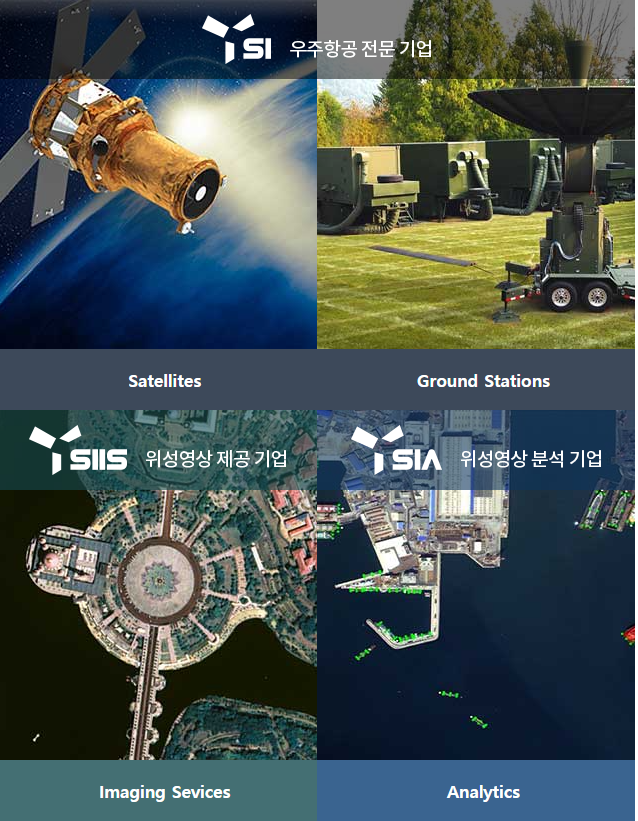

https://www.si-analytics.ai/

SIA라는 기업에 대해서 알게됐다. 해당 업체는 인공위성 사진을 이용해 딥러닝 기술로 부가가치 만들어내는 기업인데, 대학교 1학년 학과에서 항우연 견학과 더불어 쎄트렉아이라는 인공위성 기업에 방문했었는데, 해당 기업의 자회사라고 한다.

항공분야의 대표적인 집합체인 쎄트렉아이라는 회사에서도 SIA라는 자회사를 만들면서 딥러닝 기술을 적용하고자 한다는 내용에 이제는 전공에 상관없이 딥러닝 기술을 모두가 적용하고자 한다는 생각을 하게됐다.

KCCV 최종리뷰

KCCV는 최우수학회에 발표된 한국인들의 논문을 모아놓은 학회이다. 그만큼 다양한 메이저 학회에 통과된 논문들만 발표가 진행됐기에 IPIU와 비교했을 때, 많은 수준차이가 느껴졌다. 그리고 나중에는 메이저 학회 논문 제출자로 KCCV에 참여할 수 있도록 노력해야겠다고 생각했다. KCCV를 통해서 국내에 우수한 많은 연구자들과 각 연구실에서 어떤 연구를 수행하는지 알 수 있었다.