Abstract

이 논문은 Thermal image data가 RGB에 비해 상대적으로 annotation이 부족한 점을 극복하기 위해 Thermal과 비슷한 RGB이미지를 활용하는 연구이다. 해당 논문은 새로운 unsupervised adaptation을 제공하고 있으며, translating을 위해서 RGB-Thermal간의 coreesponding을 필요로 하지 않는다. 궁극적인 목표는 라벨링된 RGB의 이미지만 학습해 Thermal 이미지에서도 높은 성능의 Detection 성능을 나타내는 것이다.

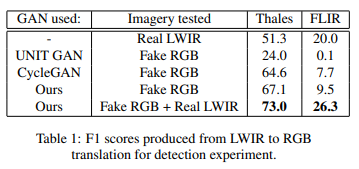

첫번째로 Termal 이미지를 RGB로 변환하고, 이를 RGB로 학습된 알고리즘에 사용하여 Thermal 이미지 라벨링의 필요를 없앨 수 있었다. 논문에서 이처럼 cycleGAN을 이용해 생성한 synthetic RGB 이미지도 높은 검출 성능이 나타남을 두가지 데이터셋(KAIST,FLIR)을 통해 검증한다. 또한 synthetic RGB 이미지와 Thermal 이미지를 결합하면 RGB를 학습한 detection network에서 F1 score를 높일 수 논문은 말한다.

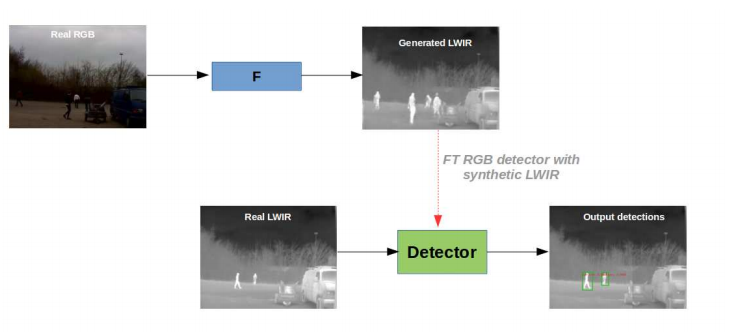

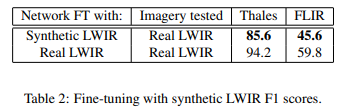

두번째로는 Thermal 이미지에서도 detection이 가능하도록 RGB로 학습한 detection network를 fine-tune하기위해 RGB를 Thermal로 변환해 학습하였고, 이 방법도 85.6%의 F1 socre를 달성했다고 논문은 설명한다.

Contribution

논문에서 저자가 이야기하는 Contribution을 정리하면 다음과 같다.

- Cycle-GAN network를 이용한 unsupervised adaptation을 제안하고 있다. 또한 새로운 loss를 설계하여 real and recovered RGB/LWIR 이미지 속 object ROI의 appearance 차이를 최소화 한다.

- Non corresponding datasets으로도 Thermal 이미지를 RGB 이미지로 변환이 가능함을 보였으며, 이를 통해서 생성한 synthetic RGB 이미지가 RGB로 학습된 detection 모델에서도 사용할 수 있다. 게다가 이 논문은 synthetic RGB와 real LWIR을 합성해 F1 socre를 향상시킨 첫 논문이다.

- RGB를 이용해 sythetic LWIR(Thermal) 이미지를 생성하고, 이를 학습에 사용하면 실제 Thermal 이미지에 대한 모델에 detection 성능을 향상시킬 수 있음을 처음으로 나타냈다.

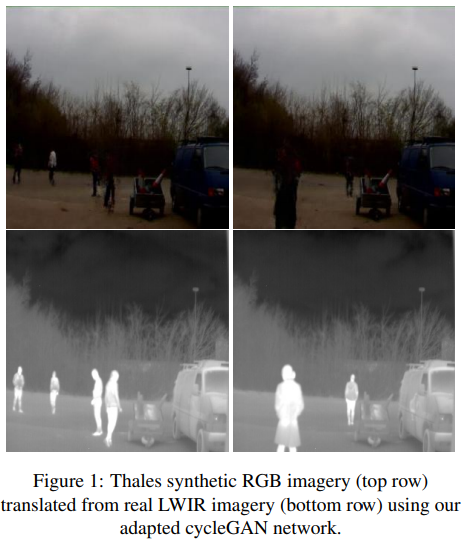

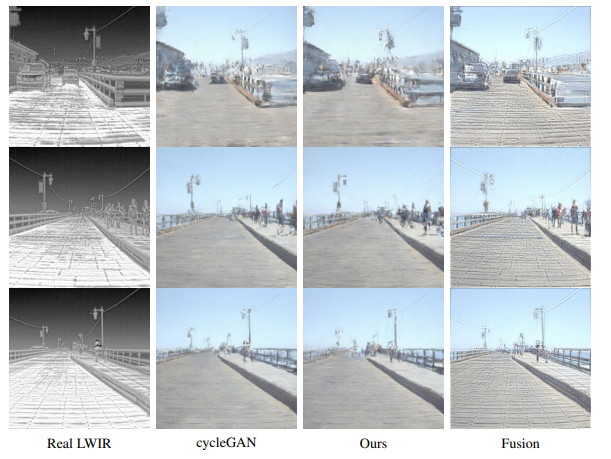

아래 그림은 실제 논문에서 제안하는 cycleGAN network를 통해 생성한 RGB이미지와 실제 이미지 생성에 사용된 Thermal 이미지 이다.

CycleGAN network

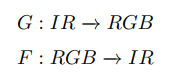

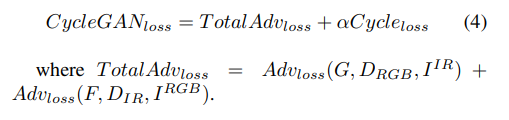

우선 논문에서 베이스로한 CycleGANnetwork에 대한 설명이다. 해당 프레임워크를 설명하고 있는 그림을 이해하기 위해서 몇가지 논문에서 정의한 명명법에 대해서 알아보자. 먼저 G는 Thermal 이미지로 RGB이미지를 생성하는 생성자, F는 RGB이미지로 Thermal 이미지를 생성하는 생성자로 명명한다.

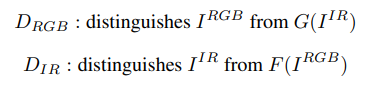

GAN의 구조이기 때문에 생성자가 있다면, 판별자도 필요한데 각 생성자에 따른 판별자는 다음과 같이 명명하고 있다.

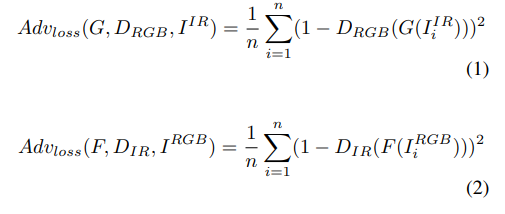

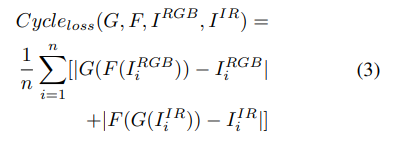

이렇게 GAN의 구조에서 필수적인 생성자와 판별자를 어떻게 논문에서 명명하는지 알아봤고, Loss에 대해서도 다음과 같이 명명한다. 이때 Loss는 기존 Cycle GAN과 동일하다.

Cycle GAN에 대한 자세한 내용을 모르는 사람은 그 누구보다 아래 영상에서 잘 설명하고 있으므로, 시간날때 공부하는것을 추천한다. (저자가 직접 한글로 강의한다.)

아무튼 다시 논문으로 돌아와서 위에서 언급한 기본적인 명명법들을 이해한다면 아래 전체 프레임 워크에서 오른쪽 부분은 충분히 이해할 수 있을 것이다.

Object-specific CycleGAN network

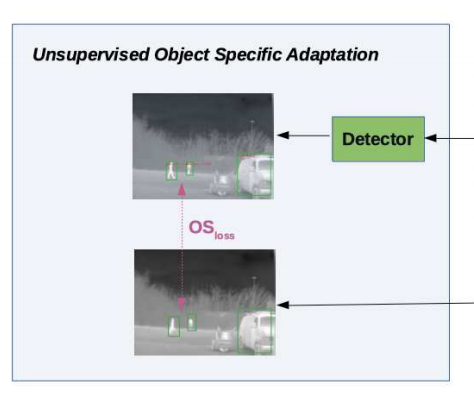

자 앞서서 위 그림에서의 오른쪽 부분을 잘 모르는 분들을 위해서 이야기했다면 이제 본격적으로 본 논문에서 제안하는 위 그림에 왼쪽(박스친 부분)에 나타난 Unsupervised Object Specific Adaptation에 대해서 알아보자.

본 논문에서는 객체검출을 위한 논문이다. 즉 Cycle GAN으로 전체 이미지를 변환할때는 그럴싸 하겠지만, object detection을 수행할만큼 디테일한 변환은 잘 이뤄지지 않는 문제점이 존재한다고 저자는 이야기한다. 즉, 정리하면 기존 CycleGAN 구조를 그대로 사용하여 생성한 이미지는 Object detection을 수행하기에 충분한 이미지를 생성하지 못한다고 가정한다.

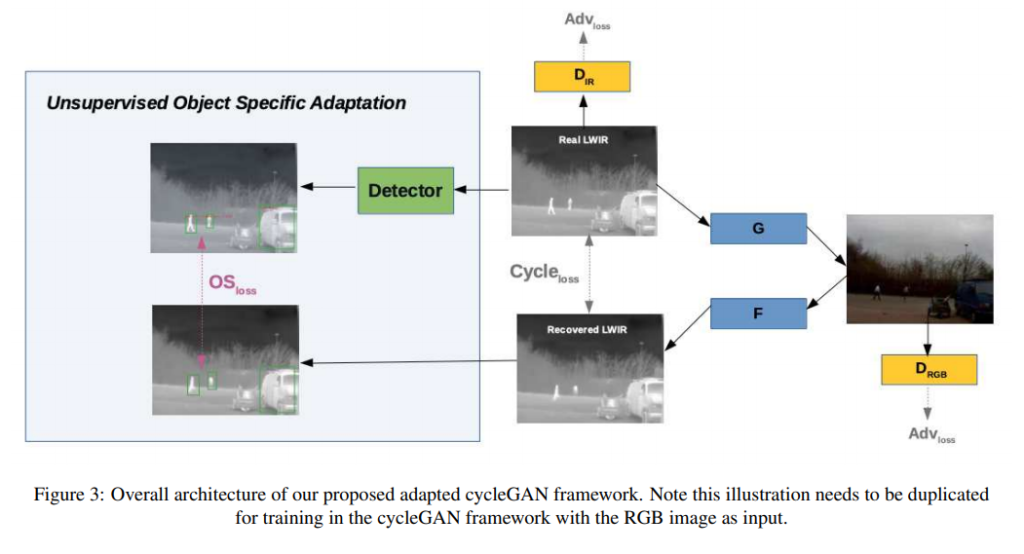

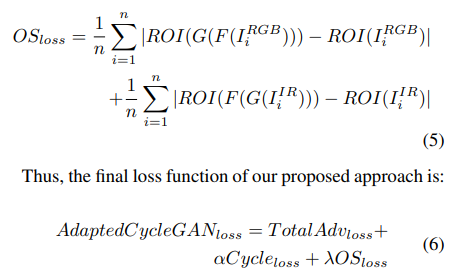

따라서 저자는 Domaion을 변환해 생성한 이미지에서의 object detection이 본 논문에서의 최종 Goal 이므로 도메인 변환시 object에 포커스를 맞춰 변환하는 방법을 제안한다. 일반 Cycle GAN 구조에서 object에 포커스를 맞추도록 해당 논문은 새로운 Loss를 제안하고 있으며 이 Loss를 Object SpecificLoss 즉 OS Loss라고 명명한다. 수식은 아래와 같다.

정리리하면 GAN을 통해서 만든 이미지를 Faster RCNN에 입력해 (이때 Faster RCNN은 RGB로 학습한 모델이다.) ROI를 예측하고, 실제 이미지도 Faster RCNN에 입력해 ROI를 예측한다. 그리고 생성된 이미지를 통해 예측된 ROI와 실제 이미지를 통해 예측된 ROI의 차이를 최소화하도록 Loss를 설계한 것이다.

이러한 OSLoss를 GAN의 Loss에 추가해 ROI를 중심으로(즉 Object를 중심으로) GAN이 잘 이뤄지도록 새롭게 Loss를 설계하였다고 저자는 이야기한다.

Experimetal

본 논문에서는 다양한 실험을 진행했다.

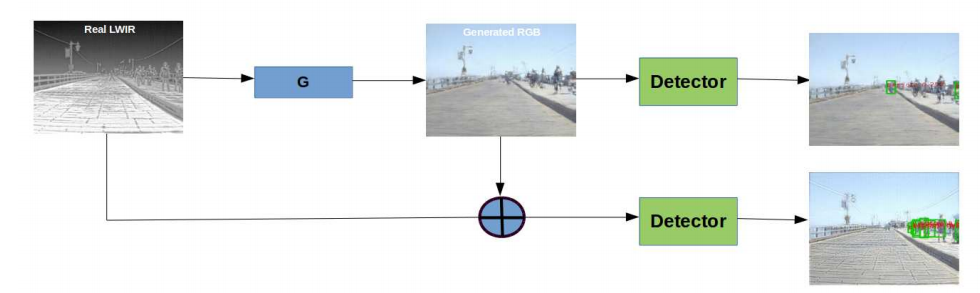

먼저 Thermal를 RGB로 변환해서 자신들이 설계한 Loss가 얼마나 효과적인지 실험하였다. 방법은 아래 그림에서 잘 나타나있다.

결과는 다음과 같다.

정량적으로는

정성적으로는

다음으로는 RGB를 Thermal로 변환하고 이를 이용해 detector를 fine tune하고 fine tune 된 detector를 가지고 실제 Thermal 이미지에 대해서 평가를 진행했다고 한다. 그림은 다음과 같다.

정량적인 결과는 다음과 같다.

.

.

.

.

.

Review

이번 CVPR에 Accept된 논문이다. CycleGAN을 이용해 RGB-Thermal 변환을 하려는 시도가 지난번 리뷰했던 논문도 그렇고 MDII도 그렇고 이번 논문까지 암튼 요즘 RGB-Thermal 쪽에서 이러한 분야의 논문도 많이 연구가 이뤄지는것 같다. 풍부한 RGB 데이터를 상대적으로 부족한 Thermal쪽에서 어떻게 잘 이용할 수 없을까 하는 부분들이 지금 많은 사람들의 관심인것 같다. 특히 이 논문은 ROI를 이용해 Object의 정보를 더 살릴 수 있도록 GAN을 학습하는 방향을 제시하였는데, 이를 AF에도 적용해서 이전에 완성하지 못한 Local Fusion에 어떻게 적용할 수 있을지 생각해봐야겠다. 끝